12 Математическая статистика

12.1 Задачи математической статистики. Основные понятия. Выборочный

метод

Рассмотрим следующую ситуацию. Задана совокупность наблюдений,

объединенных некоторым общим признаком. Предположим, что эта совокупность

бесконечна в том смысле, что в принципе наблюдения можно продолжить в любой

момент времени, как, например, в серии бросаний монеты. Из этой совокупности

"случайным образом" извлекается последовательность наблюдений. Если число этих

наблюдений достаточно велико, то частота появления событий, обладающих указанным

признаком, незначительно отклоняется от некоторой постоянной, называемой

эмпирической вероятностью. На практике ответить на вопрос о том, может ли выбор из

нашей совокупности рассматриваться как случайный, нелегко. Чаще всего этой несколько

расплывчатой формулировкой о случайном выборе пользуются тогда, когда нет

оснований предполагать наличие "привилегированных" наблюдений. В этой связи часто

говорят об "урновой" модели. Содержимое урны, например шары, неразличимые на

ощупь, представляет совокупность, а извлечение шаров, которые мы предполагаем

хорошо перемешанными, - случайный выбор.

Целью такого случайного выбора из совокупности является выяснение ее

структуры, в частности определение эмпирической вероятности. Здесь отчасти

используется то эвристическое соображение, что при бесконечно большом числе

наблюдений можно точно определить значение эмпирической вероятности. Практически

же проведение произвольно большого числа опытов или наблюдений связано с

трудностями различных характеров. Так, проведение большого числа опытов

наталкивается на техническую невыполнимость или на экономические затруднения, что

приводит к ограничению числа наблюдений. Приближение к идеальным условиям,

которое имеет место в случае игр на разорение, в большинстве практически важных

ситуаций не имеет места.

Установилась

следующая

терминология.

Бесконечная

(гипотетическая)

совокупность возможных наблюдений называется генеральной совокупностью, и

результаты наблюдений, из нее извлеченных, называются выборкой из этой совокупности.

Число наблюдений в выборке называют ее объемом. Понятие бесконечной совокупности

представляет идеализацию действительного положения вещей, даже когда под этим

понимается потенциальная возможность неограниченного повторения опытов. Практик

рассматривает всякую совокупность, "достаточно большую" по сравнению с объемом

имеющейся выборки, как бесконечную.

Выборки из конечной совокупности

Пусть задана конечная совокупность из N различных элементов x1, ..., xN. Из нее

извлекается выборка объема n без возвращения, т. е. однажды выбранный

элемент xi удаляется из совокупности. В этом случае мы будем говорить, что задана

выборка из конечной совокупности. Эта выборка является реализацией случайной

величины (ξ1, ..., ξn). Каждой выборке приписывается одинаковая вероятность. Величина

, являющаяся средним арифметическим выборочных случайных величин, имеет

математическое ожидание, совпадающее со средним совокупности. При N → ∞ "конечная

совокупность превращается в бесконечную". Дисперсии выборочного среднего

соответствует тогда дисперсия выборочного среднего для бесконечной совокупности.

Простой выборочный метод

Гипергеометрическое распределение играет важную роль, например, в

статистическом контроле качества. Предположим, что произведенные изделия (например,

лампочки) разбиты на партии вN штук каждая (например, по ящикам вместимостью

в N лампочек). Каждая партия содержит некоторый процент бракованных изделий,

который, возможно равен и нулю (например, лампочки с недостаточным сроком

годности). Обозначим через M = pN число бракованных изделий в партии; здесь

число p может меняться от партии к партии, но не должно превосходить некоторого

заданного числа p0. Для проверки этого условия можно пытаться исследовать

все N изделий, что, однако невыгодно с экономической точки зрения, а часто просто

невозможно, как в примере с лампочками, когда изделие после проверки разрушается.

Можно, однако, ограничиться выборочной проверкой. Таким образом, возникает вопрос о

проверке условия p ≤ p0 по данным некоторой выборки.

Предположим несколько более общим образом, что нам задана конечная

совокупность, состоящая из N элементов, M = Np из которых обладают некоторым

свойством. Из совокупности извлекается выборка объема n без возвращения. При

заданном p0, 0 ≤ p0 ≤ 1, подлежит проверке гипотеза p ≤ p0. При этом, конечно, следует

рассматривать лишь те значения p и p0, для которых Np и Np0 - целые числа. Выберем по

заданному уровню значимости α, 0 < α < 1, наименьшее число kα, для которого

.

(1)

Отметим, что знак равенства в (1) достижим не всегда, так как последняя сумма

принимает лишь конечное число значений, а выбор α возможен бесконечным числом

способов. Гипотеза p ≤ p0принимается, если число r элементов, обладающим указанным

свойством, не превосходит kα, и отвергается в противоположном случае.

Так, в примере с контролем качества число бракованных изделий не должно

превосходить kα. Этот критерий становится совсем понятным, если заметить, что

вероятность того, что число исключительных элементов превзойдет kα, задается для

всякого p такого, что 0 < p < 1 и Np - целое, формулой

. (2)

Это выражение, рассматриваемое как функция от p не убывает. Таким образом, чем

меньше p, тем меньше вероятность отвержения гипотезы.

Эти соображения являются основой простого выборочного метода, предложенного

Доджем и Ромигом для нужд статистического контроля качества. Как и раньше, при

фиксированном p0найдем по заданным значениям α и n число kα согласно (1). p0 называют

гарантированным условием качества. Если число исключительных изделий в партии

удовлетворяет неравенству r ≤kα, то считаем, что p ≤ p0, причем r бракованных изделий

заменяются исправными. Если же r >kα, то контролю подвергаются все N изделий из

партии и все бракованные изделия заменяются на исправные. (Этот метод предполагает,

что контроль не разрушает изделия.)

Расслоенные выборки

Пусть (ξ, η) обозначает двумерную случайную величину, причем распределение

величины ηдискретно:

.

(1)

Для вещественных x обозначим условную вероятность события {ξ ≤ x | η = i}

через Fi(x), 1 ≤ i ≤ k. Таким образом, Fi является ф. р. при фиксированном η. Для ф. р.

величины ξ имеем

. (2)

Если ξ имеет математическое ожидание

(3)

и

, (4)

то как следствие (2), (3) и (4) получаем

. (5)

В случае существования вторых моментов в понятных обозначениях имеем

.

Отсюда получаем соотношения для дисперсий

. (6)

Полученные соотношения, в частности (2), допускают следующую интерпретацию.

Пусть имеется генеральная совокупность с ф. р. F, распадающаяся на k непересекающихся

подсовокупностей.

Вероятность

того,

что

"наблюдение

принадлежит i-й

подсовокупности", равнаpi, причем i-я подсовокупность имеет ф. р. Fi. В этом контексте

соотношение (2) приобретает следующий смысл. Вероятность наблюдать ξ ≤ x задается

функцией F(x). С другой стороны, это наблюдение изъято из l-й совокупности с

вероятностью pl (l = 1, ..., k). Если, например, оно принадлежит i-й подсовокупности, то

вероятность события ξ ≤ x равна ф. р. Fi(x). Вероятность совмещения таких событий

равна piFi. Отсюда выводится соотношение

называют слоями генеральной совокупности.

(2).

Указанные

подсовокупности

Пропорциональный выбор

Во многих практически важных случаях выбор чисел ni, удовлетворяющих

соотношению

естественным

, в значительной степени произволен. Представляется

пытаться

выбратьni таким

образом,

чтобы

минимизировать

соотношение

.

Обсудим сначала так называемый пропорциональный выбор. Предположим для

простоты, чтоnpi, i = 1, ..., k, - целые числа, и положим

. (1)

Термин "пропорциональный выбор" объясняется частотным соотношением,

согласно которому числа pi приближенно равны отношению числа элементов в Ui к числу

элементов в совокупности; так же соотносятся объем выборки, извлеченной из Ui, и объем

всей выборки. Возьмем в определении ξr значения ni из (1) и обозначим полученную

величину через

. Тогда

,

где

определены согласно

соотношением (1). В силу

, а ni, 1 ≤ i ≤ k, задаются

:

,

и согласно

:

.

(2)

Оптимальный выбор

Выбор чисел ni согласно

но не

предполагает известными значения pi,

.

Покажем, что значения ni можно выбрать зависящими от pi и

при заданном n справедливо

которую мы обозначим через

таким образом, что

и для соответствующей случайной величины

, выполняется неравенство

.

(1)

,

Так

место

как

имеет

вид

,

то

в

силу

соотношения

имеет

.

Нам потребуется следующая лемма:

Лемма 1.

Пусть

.

(2)

Тогда

, (3)

причем знак равенства достигается лишь при βi = αi, i = 1, ..., k.

Доказательство основывается на применении неравенства Коши. Имеем

.

Знак равенства здесь имеет место тогда и только тогда, когда при всех 1 ≤ i ≤ k и

некотором λвыполнено

Положим теперь

, или

. Из (2) видно, что λ = 1.

(4)

и

,

(5)

и заметим, что выполнено соотношение

0 ≤ ni ≤ n. (6)

Если обозначить

условия леммы 1, которая показывает, что

и

, то в силу (4) и (6) будут выполнены

,

или

.

Согласно

значением дисперсии

выражение

.

является

минимальным

Из леммы 1 следует, что в последнем неравенстве реализуется знак неравенства

лишь для

, где

упомянутая величина

определены в (5). Если предположить, что

получается из

при выборе

- целые числа, то

. Приведенные соображения

показывают, что дисперсия равна

. Доказательство неравенства (1) совсем

просто.

Действительно, в силу неравенства Коши имеем

.

Знак равенства здесь достигается лишь при σ1 = σ2 = ... = σk. Тем самым (1) является

следствием

название оптимального.

. В силу (1) выбор при значениях выборок

носит

Расслоение выборки в случае конечных совокупностей

Рассмотренные выше понятия относительно расслоенных выборок, оптимального и

пропорционального выбора переносятся на случай конечной генеральной совокупности

практически без изменения. Укажем вкратце, как это нужно сделать. Предположим, что

основная

совокупность G содержит N элементов,

т.е.

рассмотрим

равномерное

распределение на точкахx1, ..., xN. Пусть подсовокупность Ui (i = 1, ..., k; k ≥ 2)

содержит Ni ≥ 2 элементов и

. (1)

В силу наших предположений

является

(2)

вероятностью

"извлечения

элемента

из Ui".

Среднее

основной

совокупности G равно

. Если обозначить через

точки, на которых

сосредоточены распределения из Ui, то среднее ai совокупности Ui будет равно

,

(3)

т.е. по-прежнему имеет место соотношение

естественных обозначениях соотношение

и, как легко видеть, при

для дисперсий.

Извлечем из G выборку объема n. Для среднего арифметического

..., ξn имеем

(4)

и

величин ξ1,

.

(5)

Произведем теперь расслоение выборки. Для этого из совокупности Ui извлечем

выборку объемаni (0 < ni ≤ Ni, i = 1, ..., k).

По

случайным

выборочное среднее

величинам

из

этих

согласно

совокупностей

построим

и затем величину

.

Многоступенчатый выбор

Рассмотрим двумерный случайный вектор (ξ, η) с дискретным распределением.

Пусть частное распределение ξ равномерно:

. (1)

Для условного распределения η при ξ = i имеем

. (2)

Предположим, что равенство xij = xkl эквивалентно тому, что i = k и i = l. Из (1) и (2)

получаем

.

Распределение величины η имеет, таким образом, следующий вид

. (3)

Используя (1) рассмотрим случайную величину

,

(4)

тогда

, (5)

где i1, ..., im - m различных чисел из множества {1, ..., M}.

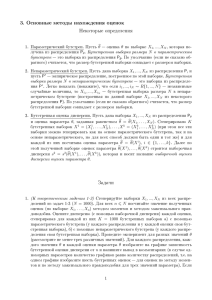

12.51 Статистические оценки параметров распределения

Точечные оценки параметров распределения. Сущность задачи точечного

оценивания параметров

Точечная оценка предполагает нахождение единственной числовой величины,

которая и принимается за значение параметра. Такую оценку целесообразно определять в

тех случаях, когда объем ЭД достаточно велик. Причем не существует единого понятия о

достаточном объеме ЭД, его значение зависит от вида оцениваемого параметра (к этому

вопросу предстоит вернуться при изучении методов интервальной оценки параметров, а

предварительно будем считать достаточной выборку, содержащую не менее чем 10

значений). При малом объеме ЭД точечные оценки могут значительно отличаться от

истинных значений параметров, что делает их непригодными для использования.

Задача точечной оценки параметров в типовом варианте постановки состоит в

следующем.

Имеется: выборка наблюдений (x1, x2, …, xn) за случайной величиной Х. Объем

выборки n фиксирован.

Известен вид закона распределения величины Х, например, в форме плотности

распределения f(T, x), где T – неизвестный (в общем случае векторный) параметр

распределения. Параметр является неслучайной величиной.

Требуется найти оценку параметра T закона распределения.

Ограничения: выборка представительная.

Существует несколько методов решения задачи точечной оценки параметров,

наиболее употребительными из них являются методы максимального (наибольшего)

правдоподобия, моментов и квантилей.

Метод максимального правдоподобия

Метод предложен Р. Фишером в 1912 г. Метод основан на исследовании

вероятности получения выборки наблюдений (x 1, x2, …, xn). Эта вероятность

равнаf(х1, T) f(х2, T) … f(хп, T) dx1 dx2 … dxn.

Совместная плотность вероятности

L(х1, х2 …, хn ; T) = f(х1, T) f(х2, T) … f(хn, T),

(4.1)

рассматриваемая как функция параметра T, называется функцией правдоподобия.

В качестве оценки параметра T следует взять то значение, которое обращает

функцию правдоподобия в максимум. Для нахождения оценки необходимо заменить в

функции правдоподобия Т на и решить уравнение L/ = 0. В целях упрощения

вычислений переходят от функции правдоподобия к ее логарифму ln L. Такое

преобразование допустимо, так как функция правдоподобия – положительная функция, и

она достигает максимума в той же точке, что и ее логарифм. Если параметр распределения

векторная величина =( 1, 2, …, n), то оценки максимального правдоподобия находят

из системы уравнений

ln L( 1, 2, …, n) / 1 = 0;

ln L( 1, 2, …, n) / 2 = 0;

.........

ln L( 1, 2, …, n) / n = 0.

(4.2)

Для проверки того, что точка оптимума соответствует максимуму функции

правдоподобия, необходимо найти вторую производную от этой функции. И если вторая

производная в точке оптимума отрицательна, то найденные значения параметров

максимизируют функцию.

Итак, нахождение оценок максимального правдоподобия включает следующие

этапы: построение функции правдоподобия (ее натурального логарифма);

дифференцирование функции по искомым параметрам и составление системы уравнений;

решение системы уравнений для нахождения оценок; определение второй производной

функции, проверку ее знака в точке оптимума первой производной и формирование

выводов.

Пример. Будем считать, что случайная величина Х, выборка значений которой

представлена в табл. 2.3, имеет нормальное распределение. Необходимо найти оценки

максимального правдоподобия параметров и этого распределения.

Решение. Функция правдоподобия для выборки ЭД объемом n

.

Логарифм функции правдоподобия

Система уравнений для нахождения оценок параметров

Из первого уравнения следует:

т.е. среднее

арифметическое является оценкой максимального правдоподобия для математического

ожидания. Из второго уравнения можно найти

. Эмпирическая

дисперсия является смещенной. После устранения смещения

.

Фактические значения оценок параметров: =27,51, 2 = 0,91.

Для проверки того, что полученные оценки максимизируют значение функции

правдоподобия, возьмем вторые производные

Вторые производные от функции ln L( , ) независимо от значений параметров

меньше нуля, следовательно, найденные значения параметров являются оценками

максимального правдоподобия.

Метод максимального правдоподобия позволяет получить состоятельные,

эффективные (если таковые существуют, то полученное решение даст эффективные

оценки), достаточные, асимптотически нормально распределенные оценки. Этот метод

может давать как смещенные, так и несмещенные оценки. Смещение удается устранить

введением поправок. Метод особенно полезен при малых выборках. Оценка инвариантна

относительно преобразования параметра, т.е. оценка некоторой функции (Т) от

параметра Т является эта же функция от оценки ( ). Если функция максимального

правдоподобия имеет несколько максимумов, то из них выбирают глобальный.

Метод моментов

Метод предложен К. Пирсоном в 1894 г. Сущность метода:

выбирается столько эмпирических моментов, сколько требуется оценить

неизвестных параметров распределения. Желательно применять моменты младших

порядков, так как погрешности вычисления оценок резко возрастают с увеличением

порядка момента;

вычисленные по ЭД оценки моментов приравниваются к теоретическим моментам;

параметры распределения определяются через моменты, и составляются уравнения,

выражающие зависимость параметров от моментов, в результате получается система

уравнений. Решение этой системы дает оценки параметров распределения генеральной

совокупности.

Пример. Предположим, что случайная величина Х, выборка значений которой

представлена в табл. 2.3, имеет гамма-распределение. Необходимо найти оценки

параметров этого распределения (можно отметить, что нормальное распределение

является частным случаем гамма-распределения).

Решение. Функция плотности гамма-распределения имеет вид

Распределение характеризуется двумя параметрами и , поэтому следует

выразить один параметр через оценку математического ожидания, а другой – через оценку

дисперсии.

Математическое

ожидание

и

дисперсия

этого

распределения

2

равны / и / соответственно. Их оценки определены в примере 2.3: 1= 27,51, 2 =

0,91;. Тогда получим систему уравнений для оцениваемых параметров

Разделив оценку математического ожидания на оценку дисперсии,

получим = 1/ 2 =30,12, следовательно, = 1 = 828,61.

Метод моментов позволяет получить состоятельные, достаточные оценки, они при

довольно общих условиях распределены асимптотически нормально. Смещение удается

устранить введением поправок. Эффективность оценок невысокая, т.е. даже при больших

объемах выборок дисперсия оценок относительно велика (за исключением нормального

распределения, для которого метод моментов дает эффективные оценки). В реализации

метод моментов проще метода максимального правдоподобия. Напомним, что метод

целесообразно применять для оценки не более чем четырех параметров, так как точность

выборочных моментов резко падает с увеличением их порядка.

Метод квантилей

Сущность метода квантилей схожа с методом моментов: выбирается столько

квантилей, сколько требуется оценить параметров; неизвестные теоретические квантили,

выраженные через параметры распределения, приравниваются к эмпирическим

квантилям. Решение полученной системы уравнений дает искомые оценки параметров.

Дисперсия D(x ) выборочной квантили обратно пропорциональна квадрату

плотности распределения D(x )=[ (1– )]/[nf 2(x )] в окрестностях точки x . Поэтому

следует выбирать квантили вблизи тех значений х, в которых плотность вероятности

максимальна.

Пример. Оценить методом квантилей параметры нормального распределения

случайной величины, выборочные значения которой представлены в табл. 2.3.

Решение. Так как требуется определить два параметра распределения и , то

выберем из вариационного ряда две эмпирические квантили. Например, можно взять

1 =5/44 =0,114;

х 1 = 26,13;

2 =31/44=0,705;

х 2 = 28,01

Используя стандартные функции математических пакетов, для выбранных

значений 1 и 2 определим значения аргументов теоретической функции

распределения для стандартизованной переменной u 1 = – 1, 207; u 2 = 0,538.

Составим систему из двух уравнений

u 1 =( х 1 – )/ ;

u 1 =( х 2 – )/ .

Решение системы позволит найти искомые оценки параметров

=( u 2 х 1 – u 1 х 2)/( u 2 – u 1) = 27,42; = (х 1 – )/u 1 = 1,07.

Метод квантилей позволяет получить асимптотически нормальные оценки, однако

они несут в себе некоторый субъективизм, связанный с относительно произвольным

выбором квантилей. Эффективность оценок не выше метода моментов. Определение

оценок может приводить к необходимости численного решения достаточно сложных

систем уравнений.

Оценки, вычисленные на основе различных методов, различаются. Универсального

ответа на вопрос, какой из рассмотренных методов лучше или следует ли положиться на

данный метод при решении любой задачи, нет. Значение оценки в каждом конкретном

случае (для разных выборок) отличается от истинного значения параметра на неизвестную

величину, иначе говоря, существует некоторая доля неопределенности в знании

действительного значения параметра. Качество оценок можно определить косвенно путем

проверки согласованности эмпирических данных и теоретического закона распределения.

Интервальные оценки параметров распределения

Сущность задачи интервального оценивания параметров

Интервальный метод оценивания параметров распределения случайных величин

заключается в определении интервала (а не единичного значения), в котором с заданной

степенью

достоверности

будет

заключено

значение

оцениваемого

параметра. Интервальная оценка характеризуется двумя числами – концами интервала,

внутри которого предположительно находится истинное значение параметра. Иначе

говоря, вместо отдельной точки для оцениваемого параметра можно установить интервал

значений, одна из точек которого является своего рода "лучшей" оценкой. Интервальные

оценки являются более полными и надежными по сравнению с точечными, они

применяются как для больших, так и для малых выборок. Совокупность методов

определения промежутка, в котором лежит значение параметра Т, получила название

методов интервального оценивания. К их числу принадлежит метод Неймана.

Постановка задачи интервальной оценки параметров заключается в следующем.

Имеется: выборка наблюдений (x1, x2, …, xn) за случайной величиной Х. Объем

выборки n фиксирован.

Необходимо с доверительной вероятностью = 1– определить интервал t0 –

t1 (t0 < t1), который накрывает истинное значение неизвестного скалярного

параметра Т (здесь, как и ранее, величина Т является постоянной, поэтому некорректно

говорить, что значение Т попадает в заданный интервал).

Ограничения: выборка представительная, ее объем достаточен для оценки границ

интервала.

Эта задача решается путем построения доверительного утверждения, которое

состоит в том, что интервал от t0 до t1 накрывает истинное значение параметра Тс

доверительной вероятностью не менее . Величины t0 и t1 называются нижней и верхней

доверительными границами (НДГ и ВДГ соответственно). Доверительные границы

интервала выбирают так, чтобы выполнялось условие P(t0 t1) = . В инженерных

задачах доверительную вероятность назначают в пределах от 0,95 до 0,99. В

доверительном утверждении считается, что статистики t0 и t1 являются случайными

величинами и изменяются от выборки к выборке. Это означает, что доверительные

границы определяются неоднозначно, существует бесконечное количество вариантов их

установления.

На практике применяют два варианта задания доверительных границ:

устанавливают симметрично относительно оценки параметра, т.е. t0 = –

Е , t1 = + Е , где Е выбирают так, чтобы выполнялось доверительное утверждение.

Следовательно, величина абсолютной погрешности оценивания Е равна половине

доверительного интервала;

устанавливают из условия равенства вероятностей выхода за верхнюю и нижнюю

границу Р(Т > + Е1, )=Р(Т < – Е2, )= /2. В общем случае величинаЕ1, не равна Е2, .

Для симметричных распределений случайного параметра в целях минимизации

величины интервала значения Е1, и Е2, выбирают одинаковыми, следовательно, в таких

случаях оба варианта эквивалентны.

Нахождение доверительных интервалов требует знания вида и параметров закона

распределения случайной величины . Для ряда практически важных случаев этот закон

можно определить из теоретических соображений.

Общий метод построения доверительных интервалов

Метод позволяет по имеющейся случайной выборке построить функцию и(Т, ),

распределенную асимптотически нормально с нулевым математическим ожиданием и

единичной дисперсией. В основе метода лежат следующие положения. Пусть:

f(х, ) – плотность распределения случайной величины Х;

ln [L(x, )] – логарифм функции правдоподобия;

;

А =М(у) – дисперсия у.

Если математическое ожидание М(у) = 0 и дисперсия у конечна, то распределение

2

2

случайной величины w =

асимптотически нормально с параметрами

0 и 1 при п .

Доверительный интервал для математического ожидания

Пусть по выборке достаточно большого объема, n > 30, и при заданной

доверительной вероятности 1– необходимо определить доверительный интервал для

математического ожидания m1, в качестве оценки которого используется среднее

арифметическое

.

Закон распределения оценки математического ожидания близок к нормальному

(распределение суммы независимых случайных величин с конечной дисперсией

асимптотически нормально). Если потребовать абсолютную надежность оценки

математического ожидания, то границы доверительного интервала будут бесконечными [–

, ]. Выбор любых более узких границ связан с риском ошибки, вероятность которой

определяется уровнем значимости . Интерес представляет максимальная точность

оценки, т.е. наименьшее значение интервала. Для симметричных функций минимальный

интервал тоже будет симметричным относительно оценки 1. В этом случае выражение

для доверительной вероятности имеет вид P(| 1 – m1 | Е) = 1– , где Е – абсолютная

погрешность оценивания.

Нормальный закон полностью определяется двумя параметрами – математическим

ожиданием и дисперсией. Величина 1 является несмещенной, состоятельной и

эффективной оценкой математического ожидания, поэтому ее значение принимаем за

значение математического ожидания. Определим оценку дисперсии случайного

параметра 1, учитывая, что этот параметр равен среднему арифметическому одинаково

распределенных случайных величин xi(следовательно, их дисперсии D(xi) одинаковы и

равны 2)

.

Итак, случайная величина 1 распределена по нормальному закону с

параметрами 1 и 2 / n. Для установления необходимых соотношений целесообразно

перейти к центрированным и нормированным величинам. Выражение 1 – m1 можно

трактовать как центрирование случайной величины 1. Нормирование осуществляется

делением на величину среднеквадратического отклонения оценки 1

.

Для стандартизованной величины

вероятность соблюдения

неравенства определяется по функции нормального распределения

= Ф( ) – Ф(– ) = –1+ 2Ф( )=1– ,

где

. Значение равно квантили u1– /2 стандартного нормального

распределения уровня 1– /2. В частности, уровням надежности 0,9, 0,95 и 0,99

соответствуют значения допустимого отклонения u1– /2 величины z, равные 1,64, 1,96 и

2,58 соответственно. Окончательно можно записать

u 21– /2 = nЕ2/ 2 .

(4.3)

Нетрудно заметить, что это выражение аналогично по своему содержанию

формуле, полученной с использованием общего метода построения доверительного

интервала.

При фиксированном объеме выборки из (4.3) следует, что чем больше

доверительная вероятность 1– , тем шире границы доверительного интервала (тем

больше ошибка в оценке математического ожидания). Это равенство позволяет

определить необходимый объем выборки для получения оценки математического

ожидания с заданной надежностью и требуемой точностью (погрешностью): n= 2 u21–

2

/2/Е . Если перейти к относительной погрешности = Е/ 1, то

n = 2 u21– /2 /( 2 12).

(4.4)

Таким образом, чтобы снизить относительную погрешность на порядок,

необходимо увеличить объем выборки на два порядка. Приведенная формула часто

используется в статистическом моделировании для определения необходимого количества

испытаний модели.

Во многих случаях предположение о нормальном распределении случайной

величины 1 становится приемлемым при n > 4 и вполне хорошо оправдывается

при n >10. Оценка 1 вполне пригодна для применения вместо m1. Но не так обстоит дело

с дисперсией, правомочность ее замены на 2 не обоснована даже в указанных случаях.

При

небольшом

объеме

выборки, n <

30,

закон

распределения

оценки

дисперсии 2 принимать за нормальный неоправданно. Ее распределение следует

аппроксимировать распределением хи-квадрат как суммы квадратов центрированных

величин (хи-квадрат распределение сходится к нормальному при количестве слагаемых,

превышающем 30). Но это утверждение обосновано только для случая, когда случайная

величина Х распределена нормально.

С учетом сделанных допущений величина z будет подчиняться закону

распределения Стьюдента с n–1 степенями свободы (одна степень свободы использована

для определения оценки дисперсии). Распределение Стьюдента симметричное, поэтому

полученное соотношение между точностью, надежностью оценки и объемом выборки

сохраняется, меняются только значения квантилей. Вместо квантили нормального

распределения u1– /2 следует взять квантиль t1– /2(n–1) распределения Стьюдента с (n–1)

степенями свободы. Значения критических точек распределения Стьюдента для

некоторых вероятностей и различных степеней свободы, представлены в табл. П.4. Как

можно видеть из табл. П.4, квантили распределения Стьюдента больше квантилей

нормального распределения того же уровня надежности при малом n. Иначе говоря,

применение нормального распределения при небольшом объеме выборки ЭД приводит к

неоправданному завышению точности оценки.

Доверительный интервал для дисперсии

По выборке достаточно большого объема (n>30) и при заданной надежности 1–

необходимо определить доверительный интервал для дисперсии m2 , оценка

которой

.

Если стандартизовать оценку дисперсии, то величина (n–1) 2/m2 имеет

распределение хи-квадрат с (n–1) степенями свободы. Из этого вытекает вероятностное

утверждение относительно выборочной дисперсии

P[(n–1) 2 /m2 > 2 (n–1)] = .

(4.5)

Функция хи-квадрат несимметричная, поэтому границы интервала 21(n–1)

и 22(n–1) выбирают из условия равной вероятности выхода за их пределы P[(n–

1) 2/m2 < 21(n–1)] = P[(n–1) 2/m2 > 22(n–1)] = /2 или

P[(n–1) 2/ 21(n–1) < m2] = P[(n–1) 2/ 22(n–1) > m2] = /2.

(4.6)

Значения границ соответствуют квантилям распределения хи-квадрат уровня /2 и

1– /2 с количеством степеней свободы n–1. Нижняя граница 21(n–1) равна

квантили 2 /2(n–1), а верхняя – квантили 21– /2(n–1). Если воспользоваться

критическими точками распределения, то следует записать 21(n–1) = 2(1– /2; n–1)

и 22(n–1) = 2( /2; n–1).

Доверительный интервал для вероятности

Пусть случайная величина Х имеет только два возможных значения: 0 и 1. В

результате проведения достаточно большого количества наблюдений эта случайная

величина приняла единичное значение т раз. Необходимо при заданной надежности 1–

определить доверительный интервал для вероятности р, оценка которой соответствует

частоте h = т/п.

Оценка h вероятности р является состоятельной, эффективной и несмещенной.

Если оцениваемая вероятность не слишком мала и не слишком велика (0,05< p<0,95), то

можно считать, что распределение случайной величины h близко к нормальному. Этим

допущением можно пользоваться, если пр и п(1–р) больше четырех. Параметры

нормального распределения частоты т1 = р, т2 = р(1–р)/п (дисперсия 2 (m) количества

успехов т составляет величину пр(1–р), а дисперсия частоты 2(m)/п2). Тогда по аналогии

с определением доверительного интервала для математического ожидания нормально

распределенной величины h можно записать

Е = |h– p| = u 1– /2( 2(т) )0,5 = u1– /2(р(1–р)/п)0,5,

где u 1– /2 – квантиль стандартизованного нормального распределения.

Чтобы связать доверительный интервал с исходными параметрами n, h и u1– /2,

возведем выражение для Е в квадрат, т. е. преобразуем равенство к виду (h–p)2=u21– /2(1–

p)p/п. Доверительные границы можно получить, решив это уравнение второй степени

p 2, 1 ={nh + 0,5u21– /2

u1– /2 [nh(1–h) + 0,25u21– /2]0,5}/(п + u21– /2).

(4.7)

С увеличением объема выборки (пh >200, nh(1–h)>200) такими слагаемыми как u21–

2

2

/2, 0,5u 1– /2 и 0,25u 1– /2 можно пренебречь, тогда приближенно

p 1 =h– u1– /2 [h(1–h)/n]0,5,

p 2 =h + u1– /2 [h(1–h)/n]0,5.

(4.8)

Более общие результаты получены с учетом

величина h распределена по биномиальному закону [11]

того,

что

случайная

,

(4.9)

где

– число сочетаний из n по k.

Исходя из этого положения, для практического применения получены значения

нижней р1 и верхней р2 доверительных границ

;

(4.10)

,

(4.11)

где

– квантиль распределения хи-квадрат уровня с числом степеней

свободы k.

Формулы (4.10) и (4.11) можно применять и в тех случаях, когда

частость h события близка (равна) нулю или близка (равна) количеству

экспериментов псоответственно. В первом случае НДГ р1 принимается равной нулю и

рассчитывается только ВДГ р2. Во втором случае рассчитывается НДГ р1, а верхняя

граница р2 =1.

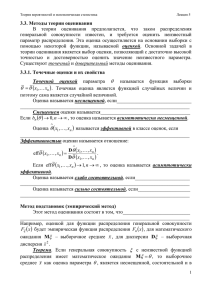

12.52 Статистическая проверка гипотез

Статистическая проверка статистических гипотез

Определение. Статистической гипотезой называют гипотезу о виде неизвестного

распределения генеральной совокупности или о параметрах известных распределений.

Определение. Нулевой

(основной) называют

выдвинутую

гипотезу Н0. Конкурирую-щей

(альтернативной) называют

гипотезу Н1,

которая

противоречит нулевой.

Пример. Пусть Н0 заключается в том, что математическое ожидание генеральной

совокупности а = 3. Тогда возможные варианты Н1: а) а ≠ 3; б) а > 3; в) а < 3.

Определение. Простой называют

гипотезу,

содержащую

только

одно

предположение,сложной – гипотезу, состоящую из конечного или бесконечного числа

простых гипотез.

Пример. Для показательного распределения гипотеза Н0: λ = 2 – простая, Н0: λ > 2 –

сложная, состоящая из бесконечного числа простых ( вида λ = с, где с – любое число,

большее 2).

В результате проверки правильности выдвинутой нулевой гипотезы ( такая

проверка называется статистической, так как производится с применением методов

математичес-кой статистики) возможны ошибки двух видов: ошибка первого рода,

состоящая в том, что будет отвергнута правильная нулевая гипотеза, и ошибка второго

рода, заключаю-щаяся в том, что будет принята неверная гипотеза.

Замечание. Какая из ошибок является на практике более опасной, зависит от

конкретной задачи. Например, если проверяется правильность выбора метода лечения

больного, то ошибка первого рода означает отказ от правильной методики, что может

замедлить лече-ние, а ошибка второго рода (применение неправильной методики) чревата

ухудшением состояния больного и является более опасной.

Определение. Вероятность ошибки первого рода называется уровнем значимости α.

Основной прием проверки статистических гипотез заключается в том, что по

имеющейся выборке вычисляется значение некоторой случайной величины, имеющей

известный закон распределения.

Определение. Статистическим критерием называется случайная величина К с

известным законом распределения, служащая для проверки нулевой гипотезы.

Определение. Критической областью называют область значений критерия, при

которых нулевую гипотезу отвергают, областью принятия гипотезы – область значений

критерия, при которых гипотезу принимают.

Итак, процесс проверки гипотезы состоит из следующих этапов:

1) выбирается статистический критерий К;

2) вычисляется его наблюдаемое значение Кнабл по имеющейся выборке;

3) поскольку закон распределения К известен, определяется (по известному

уровню значимости α) критическое значение kкр, разделяющее критическую область и

область принятия гипотезы (например, если р(К > kкр) = α, то справа от kкр распо-лагается

критическая область, а слева – область принятия гипотезы);

4) если вычисленное значение Кнабл попадает в область принятия гипотезы, то

нулевая гипотеза принимается, если в критическую область – нулевая гипотеза

отвергается.

Различают разные виды критических областей:

- правостороннюю критическую

область,

определяемую

неравенством K > kкр ( kкр > 0);

- левостороннюю критическую

область,

определяемую

неравенством K < kкр ( kкр < 0);

- двустороннюю критическую

область,

определяемую

неравенствами K < k1, K > k2

(k2> k1).

Определение. Мощностью критерия называют вероятность попадания критерия в

критическую область при условии, что верна конкурирующая гипотеза.

Если обозначить вероятность ошибки второго рода (принятия неправильной

нулевой гипотезы) β, то мощность критерия равна 1 – β. Следовательно, чем больше

мощность критерия, тем меньше вероятность совершить ошибку второго рода. Поэтому

после выбора уровня значимости следует строить критическую область так, чтобы

мощность критерия была максимальной.

Критерий для проверки гипотезы о вероятности события.

Пусть проведено п независимых испытаний (п – достаточно большое число), в

каждом из которых некоторое событие А появляется с одной и той же, но неизвестной

вероятностью р, и найдена относительная частота

появлений А в этой серии

испытаний. Проверим при заданном уровне значимости α нулевую гипотезу Н0,

состоящую в том, что вероятность р равна некоторому значению р0.

Примем в качестве статистического критерия случайную величину

,

(19.1)

имеющую нормальное распределение с параметрами M(U) = 0, σ(U) = 1 (то есть

нормиро-ванную). Здесь q0 = 1 – p0. Вывод о нормальном распределении критерия следует

из теоремы Лапласа (при достаточно большом п относительную частоту можно

приближенно считать нормально распределенной с математическим ожиданием р и

средним квадрати-ческим отклонением

).

Критическая область строится в зависимости от вида конкурирующей гипотезы.

1)

Если Н0: р = р0, а Н1: р ≠ р0, то критическую область нужно построить так,

чтобы вероятность попадания критерия в эту область равнялась заданному уровню

значимости α. При этом наибольшая мощность критерия достигается тогда, когда

критическая область состоит из двух интервалов, вероятность попадания в каждый из

которых равна . Поскольку Uсимметрична относительно оси Оу, вероятность ее

попадания в интервалы (-∞; 0) и (0; +∞) равна 0,5, следовательно, критическая область

тоже должна быть симметрична относительно Оу. Поэтому икр определяется по таблице

значений функции Лапласа из условия

вид

, а критическая область имеет

.

Замечание. Предполагается, что используется таблица значений функции Лапласа,

заданной в виде

, где нижний предел интегрирования равен 0, а не -∞.

Функция Лапласа, заданная таким образом, является нечетной, а ее значения на 0,5

меньше, чем значения стандартной функции Ф(х) (см. лекцию 6).

Далее нужно вычислить наблюдаемое значение критерия:

.

(19.2)

Если |Uнабл| < uкр, то нулевая гипотеза принимается.

Если |Uнабл| > uкр, то нулевая гипотеза отвергается.

2) Если конкурирующая гипотеза Н1: р > p0, то критическая область определяется

неравенством U > uкр, то есть является правосторонней, причем р(U > uкр) = α.

Тогда

.

Следовательно, икр можно

найти

по

таблице

значений функции Лапласа из условия, что

. Вычислим наблюдаемое

значение критерия по формуле (19.2).

Если Uнабл < uкр, то нулевая гипотеза принимается.

Если Uнабл > uкр, то нулевая гипотеза отвергается.

3) Для конкурирующей гипотезы Н1: р < p0 критическая область является

левосторонней и задается неравенством U <- uкр, где икр вычисляется так же, как в

предыдущем случае.

Если Uнабл > - uкр, то нулевая гипотеза принимается.

Если Uнабл < - uкр, то нулевая гипотеза отвергается.

Пример. Пусть проведено 50 независимых испытаний, и относительная частота

появления события А оказалась равной 0,12. Проверим при уровне значимости α = 0,01

нулевую

гипотезуН0: р =

0,1

при

конкурирующей

гипотезе Н1: р

> 0,1.

Найдем

Критическая область является правосторонней,

а икр нахо-дим из равенства Ф(икр) =

Из таблицы значений функции

Лапласа определяем икр = 2,33. Итак, Uнабл< uкр, и гипотеза о том, что р = 0,1,

принимается.

Критерий для проверки гипотезы о математическом ожидании.

Пусть генеральная совокупность Х имеет нормальное распределение, и требуется

проверить предположение о том, что ее математическое ожидание равно некоторому

числу а0. Рассмотрим две возможности.

1) Известна дисперсия σ2 генеральной совокупности. Тогда по выборке

объема п найдем выборочное среднее

и проверим нулевую гипотезу Н0: М(Х) = а0.

Учитывая, что выборочное среднее

является несмещенной оценкой М(Х), то

есть М( ) = М(Х), можно записать нулевую гипотезу так: М( ) = а0. Для ее проверки

выберем критерий

.

(19.3)

Это случайная величина, имеющая нормальное распределение, причем, если

нулевая гипотеза справедлива, то М(U) = 0, σ(U) = 1.

Выберем критическую область в зависимости от вида конкурирующей гипотезы:

-

если Н1: М(

)

≠ а0,

то икр:

,

критическая

область

двусторонняя,

, и, если |Uнабл| < uкр, то нулевая гипотеза принимается;

если |Uнабл| >uкр, то нулевая гипотеза отвергается.

- если Н1: М( ) > а0, то икр:

, критическая область правосторонняя,

и, если Uнабл < uкр, то нулевая гипотеза принимается; если Uнабл > uкр, то нулевая гипотеза

отвергается.

- если Н1: М( ) < а0, то икр:

, критическая область левосторонняя,

и, если Uнабл > - uкр, то нулевая гипотеза принимается; если Uнабл < - uкр, то нулевая

гипотеза отвергается.

2) Дисперсия генеральной совокупности неизвестна.

В этом случае выберем в качестве критерия случайную величину

,

(19.4)

где S – исправленное среднее квадратическое отклонение. Такая случайная

величина имеет распределение Стьюдента с k = n – 1 степенями свободы. Рассмотрим те

же, что и в предыдущем случае, конкурирующие гипотезы и соответствующие им

критические области. Предварительно вычислим наблюдаемое значение критерия:

.

(19.5)

- если Н1: М( ) ≠ а0, то критическая точка tдвуст.кр. находится по таблице

критических точек распределения Стьюдента по известным α и k = n – 1.

Если | Tнабл | < tдвуст.кр., то нулевая гипотеза принимается.

Если | Tнабл | > tдвуст.кр., то нулевая гипотеза отвергается.

- если Н1: М( ) > а0, то по соответствующей таблице находят tправост.кр.(α, k) –

критичес-кую точку правосторонней критической области. Нулевая гипотеза

принимается, если Tнабл < tправост.кр..

- при конкурирующей гипотезе Н1: М( ) < а0 критическая область является

левосторон-ней, и нулевая гипотеза принимается при условии Tнабл > - tправост.кр.. Если

Tнабл < - tправост.кр.., нулевую гипотезу отвергают.

Критерий для проверки гипотезы о сравнении двух дисперсий.

Пусть имеются две нормально распределенные генеральные совокупности Х и Y.

Из них извлечены независимые выборки объемов соответственно п1 и п2, по которым

вычислены исправленные выборочные дисперсии

и . Требуется при заданном

уровне значимос-ти α проверить нулевую гипотезу Н0: D(X) = D(Y) о равенстве дисперсий

рассматривае-мых генеральных совокупностей. Учитывая несмещенность исправленных

выборочных дисперсий, можно записать нулевую гипотезу так:

Н0: М ( ) = М ( ).

(19.6)

Замечание. Конечно, исправленные дисперсии, вычисленные по выборкам, обычно

оказываются различными. При проверке гипотезы выясняется, является ли это различие

незначимым и обусловленным случайными причинами (в случае принятия нулевой

гипотезы) или оно является следствием того, что сами генеральные дисперсии различны.

В качестве критерия примем случайную величину

(19.6)

- отношение большей выборочной дисперсии к меньшей. Она имеет распределение

Фишера-Снедекора со степенями свободы k1 = n1 – 1 и k2 = n2 – 1, где п1 – объем выборки,

по которой вычислена большая исправленная дисперсия, а п2 – объем второй выборки.

Рассмотрим два вида конкурирующих гипотез:

- пусть Н1: D(X) > D(Y). Наблюдаемым значением критерия будет отношение

большей из исправленных дисперсий к меньшей:

. По таблице критических

точек распреде-ления Фишера-Снедекора можно найти критическую точку Fнабл(α; k1; k2).

При

Fнабл < Fкр нулевая гипотеза принимается, при Fнабл > Fкр отвергается.

- если Н1: D(X) ≠ D(Y), то критическая область является двусторонней и

определяется неравенствами F < F1, F > F2, где р(F < F1) = р( F > F2) = α/2. При этом

достаточно

найти

правую

критическую

точку F2 = Fкр ( , k1, k2).

при Fнабл < Fкр нулевая гипотеза принимается, при Fнабл > Fкр отвергается.

Тогда