Введение в байесовские сети

реклама

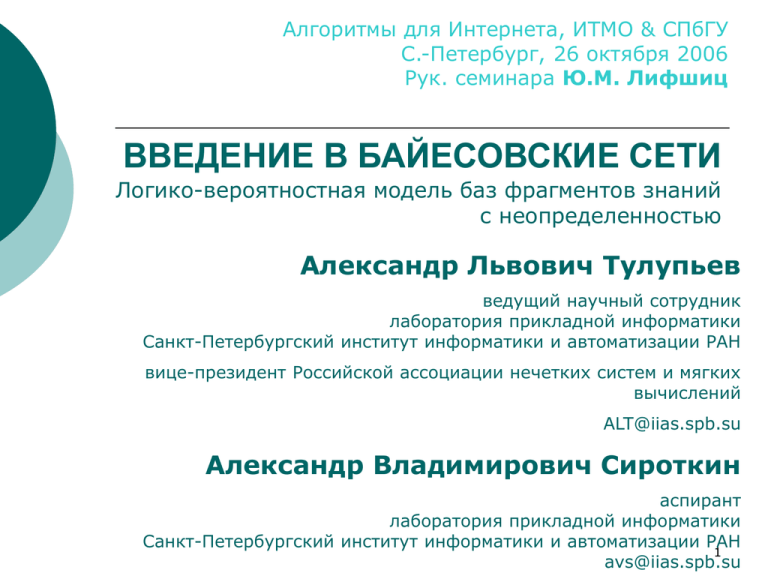

Алгоритмы для Интернета, ИТМО & СПбГУ

С.-Петербург, 26 октября 2006

Рук. семинара Ю.М. Лифшиц

ВВЕДЕНИЕ В БАЙЕСОВСКИЕ СЕТИ

Логико-вероятностная модель баз фрагментов знаний

с неопределенностью

Александр Львович Тулупьев

ведущий научный сотрудник

лаборатория прикладной информатики

Санкт-Петербургский институт информатики и автоматизации РАН

вице-президент Российской ассоциации нечетких систем и мягких

вычислений

ALT@iias.spb.su

Александр Владимирович Сироткин

аспирант

лаборатория прикладной информатики

Санкт-Петербургский институт информатики и автоматизации РАН

1

avs@iias.spb.su

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

2

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

3

Идеологическое определение

Байесовские сети --- это

графические структуры для

представления вероятностных

отношений между большим

количеством переменных и для

осуществления вероятностного

вывода на основе этих

переменных.

Learning Bayesian Networks

Neapolitan R.E., 2004

4

Уточнение-1

Предположение, лежащее в

основе любой вероятностной сети,

заключается в том, что, в то время

как общая проблема чересчур

сложна для применения наивных

методов вычисления и обновления

вероятностей…, отдельные клики…

имеют приемлемый, разумный

размер…

Probabilistic Networks and Expert Systems

Cowell R.G. et al., 2004

5

Уточнение-2

…В частности, мы предполагаем,

что можем производить

(пользуясь, например, «грубой

силой», т.е. подходом по

определению) любые желаемые

операции, такие, как

маргинализацию или нормировку,

внутри любой клики, но

необязательно непосредственно

для всей сети сразу…

Probabilistic Networks and Expert Systems

Cowell R.G. et al., 2004

6

Уточнение-3

Наша цель --- использовать

структуру сети для того, чтобы

распространить такие вычисления

на полный набор переменных.

Probabilistic Networks and Expert Systems

Cowell R.G. et al., 2004

7

Цель --

представить распределение

вероятностей (или их семейство) над

(большим числом) переменных, в

общем виде выглядящее как

~

~

~

p( x1 x2 xn )

~

~

~

P p( x1 x2 xn ) |

8

И допускающее декомпозицию

~

~

~

p( x1x2 xn )

~

p( xi )

~

~

p( x i x j )

~

~

~

p( x i x j x k )

~

p( xi )

~

~

p( x i | x j )

~

~

~

p( x i | x j x k )

9

Байесовские сети доверия

p(t ) 0.01

1

p(u | t ) 0.16

t

Компьютер упал

со стола

u

На жестком

диске появились

дефектные

секторы

p(w | uv ) 0.95

p(w | uv ) 0.25

p(w | u v ) 0.9

p(w | u v ) 0.02

3

p(v | t ) 0.1

p(v | t ) 0.001

p(u | t ) 0.05

2

v

Нарушен один

из контактов

блока питания

2

1

1

3

3

2

w

Компьютер

не загружается

p( x | u ) 0.2

p( x | u ) 0.025

x

При диагностике

логический диск

недоступен

p( y | w ) 0.4

p( y | w ) 0.001

y

На экране

монитора нет

изображения

p( z | v ) 0.99

p( z | v ) 0.001

z

Индикатор

питания

не горит

10

Алгебраические байесовские сети

tuv

uvw

x1x2x3

tv

tu

uv

wv

tv

wy

x1 x 2

u

t

v

x2x3x4

x2x3

x1x3

x2x4

x3x4

y

w

vz

ux

x

z

t

x1

x4

x3

x2

x1x2x3

tu

u

x

tv

w

z

v

x1 x 2

ux

uv

wu

wuv

y

x1x3

x2x3

x3x4

vz

wv

wy

x1

x2

x3

11 x4

АБС (графы и деревья смежности)

<x1, x2>

<x1, x2>

<x1, x2, x3>

<x2>

<x1>

<x2, x3>

<x2, x3>

<x1, x3>

<x1, x2, x3>

<x1>

<x2, x3, x4>

<x2, x3, x4>

<x1, x4>

<x3, x4>

<x2>

<x1, x2>

<x2, x3>

<x1>

<x3, x4, x5>

<x4, x5>

<x4, x5, x6>

<x2, x3>

<x3>

<x1, x3>

12

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

13

Почему БС востребованы

ИИ (МВ): знания с неопределенностью,

фрагменты знаний, базы фрагментов

знаний

Статистика: много переменных, связи

всех со всеми неописуемые и

неоцениваемые, зато отдельные

скопления можно неплохо

охарактеризовать

Техника: декомпозируемость систем,

знание свойств элементов и связей

между ними

14

Что предшествовало

Анализ родословных для поиска

источника и путей передачи

генетических аномалий.

Представление результатов

статистических наблюдений, когда

наблюдаемых переменных очень

много, но их удается разбить на

условно независимые наборы.

15

БС применяются в медицине

Для быстрой постановки диагноза,

чтобы выбрать правильное

учреждение для госпитализации

Для дифференциальной

диагностики заболеваний,

симптоматические проявления

которых сходны [но не совпадают

полностью]

16

БС применяются в технологических

процессах

Для диагностики отказов и

дефектов

В драйверах принтеров

Для анализа результатов

тестирования ПО

Для оптимизации запросов в БД

Для представления результатов

data mining

17

БС применяются в научных

исследованиях

Диагностика концентрации уровня

кислорода в озере (PhD Thesis!)

Геномика и биоинформатика

Все то же представление

результатов статистической

обработки

18

Потенциальная применимость БС

Теория надежности структурно сложных систем

(ЛВМ --- адм. И.А. Рябинин)

x1

x1

b

x2

x3

x4

x2

x3

x1

x3

b

e

b

e

x5

s3

x4

x1

x2

x3

s2

x2

e

x3

x1

x1x3

x4

s1

x2

x1x2

x2x3

x1x2x3

19

БС в учебном процессе

Подробнее --- немного позже.

Основное

Комбинирование и актуализация

знаний из нескольких дисциплин;

Все объекты и предметы

исследования «под рукой»;

Полигон для применения

программных технологий.

20

Немного об истории

Логика (от Аристотеля и раньше);

Вероятностная логика (от Дж. Буля

и позже); в ИИ удачно ввел Н.

Нильссон в 1986; различные

формализации, мы пользуемся

Хальперном, Фагином и Меггиддо;

Байесовские сети (БСД – Дж. Пиэрл,

АБС – В.И. Городецкий), еще и

марковские сети (???);

история этим не исчерпывается;

смежные дисциплины...

21

Немного об особенностях

Очень большой упор на графическое

представление отношений независимости и

условной независимости.

Стремление избежать обсуждения тех проблем,

решения которых они не знают (подмена

циклов последовательностью фрагментов

знаний, …)

А нам бы о представлении данных хотелось бы

поговорить побольше, непротиворечивость

посмотреть, алгоритмы вывода выписать и

сделать понятными, на доступные программные

технологии опереться.

22

БСД: литература

Статьи

Pearl J. (1985). How to Do with Probabilities what People Say You Can't. Artificial Intelligence

Applications. Ed. Weisbin C.R., IEEE, North Holland, pp. 6--12.

Pearl J. (1986). Fusion, Propagation, and Structuring in Belief Networks. Artificial Intelligence,

vol. 29. Elsevier Science Publishers B.V., North Holland, pp. 241--288.

Pearl J. (1986a). Constraint-Propagation Approach to Probabilistic Reasoning. Machine

Intelligence & Pattern Recognition (Uncertainty in Artificial Intelligence). Eds. Kanal L.N.,

Lemmer J.F. Vol. 4, Elsevier Science Publishers B.V., North Holland, pp. 357--369.

Pearl J. (1986b). On Evidentional Reasoning in Hierarchy of Hypotheses. Artificial Intelligence,

vol. 28. Elsevier Science Publishers B.V., North Holland, pp. 9--15.

Pearl J. (1986c). Distributed Revision of Composite Beliefs. Artificial Intelligence, vol. 33.

Elsevier Science Publishers B.V., North Holland, pp. 173--215.

Монографии

Pearl J. (1988). Probabilistic Reasoning in Intelligent Systems. Morgan Kaufmann Publishers,

552 pp.

Pearl J. (2000). Causality: Models, Reasoning, and Inference. Cambridge University Press, 386

pp.

Jensen F.V.(2001). Bayesian Networks and Decision Graphs. Springer-Verlag, NY. 268 pp.

Korb K.B., Nicholson A.E. (2004). Bayesian Artificial Intelligence. Chapman and Hall/CRC, 364

pp.

Kyburg H.E. Jr. (2001). Uncertain Inference. Cambridge University Press, 298 pp.

Lauritzen, S. L. (1996). Graphical Models, Oxford University Press, Oxford, 1996.

Neapolitan R.E. (2004). Learning Bayesian Networks. Pearson Prentice Hall, 674 pp.

Nilsson N.J. (1998). Artificial Intelligence: A New Synthesis. Morgan Kaufmann Publishers, 514

pp.

23

АБС: литература

Gorodetsky V.I., Drozdgin V.V., Jusupov R.M. Application of Attributed Grammar

and Algorithmic Sensitivity Model for Knowledge Representation and Estimation

// Artificial Intelligence and Information, Control Systems of ROBOTSA. North

Holland, Elsevier Science Publ., 1984. pp. 232--237.

Городецкий В.И. Байесовский вывод. АН СССР, ЛИИАН, Препринт № 149. Л.,

1991.

Городецкий В.И. Алгебраические байесовские сети --- новая парадигма

экспертных систем // Юбилейный сборник трудов институтов Отделения

информатики, вычислительной техники и автоматизации Российской

Академии наук, т. 2. М., РАН, 1993. с. 120--141.

Городецкий В.И., Тулупьев А.Л. Формирование непротиворечивых баз

знаний с неопределенностью // Известия РАН. Серия "Теория и системы

управления». 1997. №5.

Тулупьев А.Л. Алгебраические байесовские сети. Теоретические основы и

непротиворечивость. СПб.: СПИИРАН, 1995. 76 с.

Тулупьев А.Л. Алгебраические байесовские сети. Логико-вероятностный

подход к моделированию баз знаний с неопределенностью. СПб.: СПИИРАН,

2000. 292 с.

Тулупьев А.Л., Николенко С.И., Сироткин А.В. Байесовские сети: логиковероятностный подход. СПб.: Наука, 2006. 607 с.

24

Веб-сайты

БСД: стоит начинать с

www.auai.org

АБС: сайт в разработке, можно

периодически проверять

www.spiiras.nw.ru

(а пока пользоваться Зеленой

книгой)

25

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

26

БА пропозициональных формул

A t1 , t2 ,, tn

F A

Универсум, множество атомов,

множество булевских переменных,

Множество атомарных

пропозиций…

Алгебра пропозициональных формул, построенных над

заданным универсумом.

F A F A /

Фактор-алгебра классов тождественных

пропозициональных формул. Как

правило, далее эквивалентные формулы

не различаются. В частности,

вероятности истинности эквивалентных

формул будут совпадать.

true или 1 --- тождественная истина, константа

false или 0 --- тождественная ложь, константа,

(f) --- истинностное означивание пропозициональной формулы f.

27

Аргументное место (литерал)

~

x x, x

Аргументное место или литерал.

Используется как обозначение означивания

атомарной формулы x или как скользящий

индекс.

~x ~x x1 x2 , x1 x2 ,

1

2

x1 x2 , x1 x2

~

~

h

x

1 x2 hx1 x2 hx1 x2 hx1 x2 hx1 x2

~

x1 ~

x2

Внутри одной и той же формулы означивания одного и того же

аргументного места совпадают. Возможные несовпадения оговариваются

отдельно.

28

Логические операции

отрицан

ие

конъюнк

ция

дизъюнкция

эквивале

нтность

импликация

исключающ

ее или

x y x

xy

xy

xy

xy

xy

0 0 1

0

0

1

1

0

0 1 1

1 0 0

0

0

1

1

0

0

1

0

1

1

1 1 0

1

1

1

1

0

Знак конъюнкции, как правило, опускают:

вместо xy пишут xy.

29

Кванты

Пусть нам задан набор атомов

S x1, x2 ,, xm .

Квантом называется конъюнкция, в которую входят все атомы из набора.

Каждый атом входит с одним из означиваний: либо положительным либо

отрицательным.

~ ~~ ~

X x1x2 ...xm

Пример записи кванта, краткой и полной.

Обозначение множества квантов:

~

~

~

~

QS x1x2 ...xm : xi xi , xi , i 1(1)m

Пример:

Qx, z xz , xz , x z, x z .

30

Конъюнкты

Пусть нам задан набор атомов

S x1, x2 ,, xm .

Конъюнктом называется конъюнкция положительно означенных

атомов из набора. В эту конъюнкцию атом либо входит, либо вообще

не входит.

Один положительно означенный атом тоже является конъюнктом.

Пустая конъюнкция (пустой конъюнкт) эквивалентен тождественной

истине.

x, y, xy , x1 x2 x3 ,...

X x1x2 ...xm

--- примеры конъюнктов.

--- краткая запись конъюнкта.

31

Теорема о СДНФ

( f F ) !(S f Q) : f

q

qS f

S:F 2

S( f ) S f

Q

32

Идеал конъюнктов

C C ( A) ~

xi1 ~

xi2 ~

xik : (i1 , i2 ,, ik ) 2{1(1) m} , k 1(1)m .

x1x2x3

x1

x1x2

x1x2

x1

x1x3

x2x3

x2

x1

x2

x3

Также можно рассматривать идеал с пустым конъюнктом.

33

Особенности идеала

Множество всех непустых

конъюнктов над заданным

набором атомов --- идеал;

Множество всех (все непустые и

один пустой) конъюнктов над

заданным набором атомов --идеал;

Непустое пересечение идеалов --идеал.

34

Идеал конъюнктов 4-го порядка

x1x2x3x4

x1x2x3

x1 x 2

x1x2x4

x1x3

x1x4

x1

x2

x1x3x4

x2x3

x2x3x4

x2x4

x3

x3x4

x4

35

ПРИМЕР (1)

A x1 , x2

.

Q ~

x1 ~

x2 x1 x2 , x1 x2 , x1 x2 , x1 x2

,

C x1 , x2 , x1 x2

~ ~~

X x1x2

X x1 x2

,

,

.

36

ПРИМЕР (2)

A x1 , x2 , x3

Q ~

x1~

x2 ~

x3

x1x2 x3 , x1x2 x3 , x1x2 x3 , x1x2 x3 , x1x2 x3 , x1x2 x3 , x1x2 x3 , x1x2 x3

.

,

C x1 , x2 , x3 , x1 x2 , x1 x3 , x2 x3, , x1 x2 x3

X ~

x1 ~

x2 ~

x3

,

X x1 x2 x3

37

Вероятность истинности

Подход по Н. Нильссону (1986 г.)

Более глубокая формализация

дана в работах коллектива

Фагина, Хальперна, Миггидо

(пригодна для рассуждений об

оценках сложности)

Другие глубокие формализации

Спор о приоритетах (de Finetti…)

Дж. Буль --- тоже писал о

вероятности пропозиции

38

НАБОР ПРОПОЗИЦИЙ

x, y, xy

39

Возможные миры

Формула

Логическое означивание

x

true

true

true

true

false

false

false

false

y

xy

true

true

false

false

true

true

false

false

true

false

true

false

true

false

true

false

40

Допустимые миры

Формула

Допустимое логическое

означивание

(допустимый мир)

Вероятност

ь

истинности

формулы

x

true

true

false

false

0,5

y

xy

true

false

true

false

0,6

true

false

false

false

0,2

0,2

0,3

0,4

0,1

Вероятност

ь

допустимог

о мира

41

Вероятность пропозиции

В

рамках подхода Н.

Нильссона мы рассуждаем о

вероятности истинности

пропозиции;

Для краткости говорят

вероятность пропозиции

42

Теорема о СДНФ

( f F ) !(S f Q) : f

q

qS f

S : F 2Q

S( f ) S f

43

КВАНТЫ:

Множество элементарных событий

p : Q [0;1]

(q Q) p (q) 0;

p (q) 1.

qQ

44

ВЕРОЯТНОСТЬ ПРОПОЗИЦИИ

Q

p :2

[0;1]

(S Q ) p(S ) :

p (q )

qS

Q

Q,2 , p

(f F ) p(f ) : p(S(f ))

Q, F, p

45

Индексация конъюнктов

(дизъюнктов) и квантов

Нумерация

A = {x1}

A = {x1, x2}

A = {x1, x2, x3}

№10

№2

[№]1

Q

A

[№]2

Q

A

[№]3

Q

A

0

02

02

x1

e

002

x 2 x1

e

0002

x3 x2 x1

e

1

12

12

x1

x1

012

x2x1

x1

0012

x3x2x1

x1

2

102

102

x 2 x1

x2

0102

x3 x2 x1

x2

3

112

112

x 2 x1

x2 x1

0112

x3 x2 x1

x2 x1

4

1002

1002

x3 x2 x1

x3

5

1012

1012

x3 x2 x1

x3 x1

6

1102

1102

x3 x2 x1

x3 x2

7

1112

1112

x3 x2 x1

x3 x2 x1

46

Случайные бинарные

последовательности

~

x, x , xˆ.

~

~

x1x2 , x1 x2 , xˆ1 xˆ2 .

~

~

~

~

x1x2 ...xm1 xm , x1 x2 ...xm1xm , xˆ1 xˆ2 ...xˆm1 xˆm .

~ ˆ

X, X, X.

~

~

ˆ

p X : p X X .

47

Базовые понятия ТВ на языке

СБП

~

~

p

(

x

y)

~

~

~

~

~

~

~

p( x | y )

;

p

(

x

|

y

)

p

(

y

)

p

(

x

y ).

~

p( y )

~~

p( XY )

~ ~

~ ~

~

~~

p( X | Y )

~ ; p( X | Y ) p(Y ) p( XY ).

p (Y )

~~

~

~

p ( XY ) p( X ) p(Y ).

Xˆ , Zˆ Zˆ :

~ ~~ ~

~ ~ ~~

p XY Z p Y p XY p Y Z ;

~~ ~

~ ~ ~ ~

~

p XZ | Y p X | Y p Z | Y , p Y 0.

48

Кванты и вероятность

истинности

p( x y ) p( xy ) p( xy ) p( x y ),

p( x y ) p( xy ) p( x y ),

p( x y ) p( xy ) p( x y ),

p( x y ) p( xy ) p( x y ) p( x y ).

49

Конъюнкты и вероятность

истинности

p( x y ) p( x) p( y ) p( xy ),

p( x y ) p( x) p( y ) 2 p( xy ),

p( x y ) 1 p( x) p( y ) 2 p( xy ),

p( x y ) 1 p( x) p( xy ).

50

Вероятности квантов и

конъюнктов

p( xy ) p( xy ),

p( xy ) p( x) p( xy ),

p( x y ) p( y ) p( xy ),

p( x y ) 1 p( x) p( y ) p( xy ).

Связи между наборами квантов и конъюнктов будет обсуждаться ещё

неоднократно, поскольку кванты формируют множество элементарных

событий, а конъюнкты --- идеал, образующий одну из моделей

фрагмента знаний.

51

Интервальная вероятность

конъюнкции

p( x), p( y )

p( xy ) ?

--- дано.

p( xy ) max0, p( x) p( y ) 1, min p( x), p( y );

max0, p( x) p( y ) 1 p( xy ) min p( x), p( y ).

Оценки вероятностей не могут быть произвольно назначены.

Вероятности истинности пропозициональных формул находятся в

определенных отношениях.

Вместе с тем, по точечным оценкам вероятностей одних формул даже

в простейших случаях не всегда удается восстановить точечные оценки

вероятностей других формул (без привлечения дополнительных

52

предположений).

Modus ponens

x, x y

(modus ponens)

y

p ( x), p ( x y )

(" probabilis tic " modus ponens)

p( y) ?

И в этом случае даже из точечных оценок вероятностей в антецеденте

будут получаться, как правило, интервальные оценки вероятностей в

консеквенте. Кроме того, некоторые сочетания оценок в антецеденте

будут противоречить аксиоматике вероятностной логики.

53

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

54

Фрагмент знаний (определение)

xy, p(xy)

Математическая

модель

Идеал

конъюнктов

Оценки

вероятностей

элементов идеала

(точечные и

интервальные)

<x, y>

x, p(x)

y, p(y)

xyz, p(xyz)

xy, p(xy)

yz, p(yz)

xz, p(xz)

<x, y, z>

x, p(x) y, p(y) z, p(z)

55

ФЗ: Brute Force Calculations

Поддержание непротиворечивости

Априорный вывод

Апостериорный вывод

Вывод оценок чувствительности

Объемлющая непротиворечивость

Линейные комбинации ФЗ

...

56

«Точечная» непротиворечивость

p(x)=0.4

p(x)=0.6

непротиворечиво

(согласовано,

совместно)

p(x)=0.7

p(x)=0.6

противоречиво

(несовместно)

57

«Интервальная» непротиворечивость

p(x)=[0.4;0.5]

p(x)=[0.5;0.6]

непротиворечиво

(согласовано,

совместно)

p(x)=[0.7;0.8]

p(x)=[0.5;0.6]

противоречиво

(несовместно)

p(x)=[0.3;0.5]

p(x)=[0.4;0.6]

непротиворечиво

(не согласовано,

совместно)

58

Непротиворечивость ФЗ (.)

Преобразовать вероятности на

конъюнктах в вероятности на квантах;

Проверить соответствие вероятностной

аксиоматике получившихся оценок на

квантах

1

p(e )

p

(

x

)

p

(

x

)

1

1

P ( 2)

p( x 2 ) p( x 2 )

p( x x ) p( x x )

2 1

1 2

1 p( x1 ) p( x 2 ) p( x1x 2 ) 0

p( x1 ) p( x1x 2 ) 0

p( x 2 ) p( x1x 2 ) 0

p( x1x 2 ) 0

I n P( n ) Q ( n )

p( x 2 x1 ) p( x1x 2 )

p

(

x

x

)

p

(

x

x

)

2 1

1 2

Q ( 2)

;

p( x 2 x1 )

p( x1x 2 )

p( x x ) p( x x )

2 1

1 2

1 1 1 1 1

p

(

x

)

0

1

0

1

1

0

0 0

1 1 p( x 2 )

0 0 0

1 p( x1x 2 )

Q ( n ) 0 n ,

Q ( n ) 1n 1.

59

Матрицы In и Jn

1 1

I1

0

1

In 1 In 1

In

0

I

n 1

1 1

J1

0

1

Jn 1 Jn 1

Jn

0

J

n 1

I n P( n ) Q ( n )

Jn Q ( n ) P( n )

Матрицы преобразования

вектора вероятностей конъюнктов в

вектор вероятностей квантов

и наоборот строятся как

прямое произведение матриц Кронекера.

60

Матрицы I (2, 3, 4, 5)

61

Множество ограничений E(n)

Обозначим множество ограничений,

вытекающих из вероятностной

аксиоматики, как E(n).

В матрично-векторном виде они

записываются как

In P

(n )

n

0

62

ФЗ с [,]-ми оценками

Задан набор интервальных

оценок, который мы обозначим

как D(n).

,( n )

P

P

(n )

,( n )

P

63

Непротиворечивость ФЗ ([])

Пусть задан набор

интервальных оценок.

Этот набор

непротиворечив

(согласован), если для

произвольного

элемента при выборе

произвольной точки из

интервальной оценки в

остальных интервалах

можно выбрать точки

так, что получившийся

набор точечных оценок

непротиворечив.

64

Поддержание непротиворечивости

ФЗ в [,]-ом случае

R

(n )

D

(n )

E

(n )

p (f ) min p(f )

p (f ) maxp(f )

P maxP

P minP

R (n )

R

R (n )

R

65

Априорный вывод

f F ( A) ! L

(n )

: p(f ) L P

p (f ) min p(f )

R (n )

(n ) (n )

p (f ) maxp(f )

(

n

)

R

Можно как выводить оценку истинности пропозиции, не

вошедшей в ФЗ, так и учитывать эту оценку в процессе

поддержания непротиворечивости или априорного вывода

оценок вероятности истинности других формул.

66

Апостериорный вывод в ФЗ АБС

Мы что-то узнали: поступило свидетельство;

Как оно повлияет на наши оценки вероятностей

утверждений из нашей базы знаний;

[Как распространить влияние свидетельства]

Несколько вычислительно разных ситуаций...

<VX>

~

<V>

~~ ~

~~ ~

pa(VX|<V>)=p(VX|V)

~ ~

~ ~

pa(X|<V>)=p(X|V)

<VX>

~

<p[a](V)>

~~

~

~~ ~

~

pa(VX|<p[a](V)>)=p(VX|V)p[a](V)

~

~

pa(X|<p[a](V)>)=...

67

Детерминированное свидетельство

Атомарные <x> или <x> и кортежи

<x1x8>, <x1x2>, <x1x2x3>... Кратко

~

~

~

~

X x1x2 ...xm

68

Недетерминированное свидетельство

Атомарные <p[a](x)> и < p[a]( x)>

Кортежи < p[a](x1x8), p[a](x1x8),

p[a](x1x8), p[a](x1x8)>

В краткой записи:

~

p[a ] ( x )

~

~

~

~

p[a ] ( X ) p[a ] ( x1x2 ...xm )

Апостериорное распределение вероятностей (задающее свидетельство)

подчиняется аксиомам вероятностной логики. В нашей теории кортеж

недетерминированных свидетельств также представляется в виде

фрагмента знаний.

69

Свидетельство с неопределенностью

~

~

p[ a ] ( x ) Pr[ a ] ( x )

~

~

p[ a ] ( X ) Pr[ a ] ( X )

p[ a ] ( ~

x1~

x2 ...~

xm ) Pr[ a ] ( ~

x1~

x2 ...~

xm )

Кортеж недетерминированных свидетельств с неопределенностью

представляется в виде фрагмента знаний с интервальными оценками

истинности.

70

Апостериорный вывод: (.) и [,]

Вид оценок в ФЗ, куда поступает

свидетельство, также создают особый

вычислительный аспект:

точечные оценки --- «прямые»

вычисления по определению условной

вероятности;

интервальные оценки --- задачи

гиперболического программирования.

71

Апостериорный вывод

«по определению»

условной вероятности («+»)

p ( xZ )

pa ( Z | x ) : p( Z | x)

;

p( x)

p ( x | C ) : p( x);

Z x2 , x3 , x2 x3 ;

x1x2x3

x1x2

pa ( xZ | x ) pa ( Z | x ).

x2x3

x2x3

x1x3

x1

<x1>

x2

x3

x2

x3

72

Апостериорный вывод

«по определению»

условной вероятности («-»)

p ( x Z ) p ( Z ) p ( xZ )

pa ( Z | x ) : p( Z | x )

;

p( x )

1 p( x)

p ( x | C ) : p ( x ) 1 p( x);

Z x2 , x3 , x2 x3 ;

x1x2x3 pa ( x Z | x ) pa ( Z | x ).

x1x2

x2x3

x2x3

x1x3

x1

<x1>

x2

x3

x2

x3

За счет процедуры

переозначивания

атомов и пересчета

вероятностей,

можно считать, что

поступают лишь

свидетельства,

означенные

положительно

73

Апостериорный вывод, ФЗ с [,]

Сведение:

p( x x ) 0,

1 2

p( x1) p( x1x 2 ) 0,

p( x ) p( x x ) 0,

1 2

2

1 p( x1) p( x 2 ) p( x1x 2 ) 0,

p

p

(

x

)

p

,

1

1

1

p2 p( x 2 ) p2 ,

p12 p( x1x 2 ) p12

px1x 2

p ( x 2 | x1 ) min

R,2

px1

px1x 2

p ( x 2 | x1 ) max

R,2

px1

74

Апостериорный вывод, ФЗ с [,]

Сведение:

p( x x ) 0,

1 2

p( x1) p( x1x 2 ) 0,

p( x ) p( x x ) 0,

1 2

2

1 p( x1) p( x 2 ) p( x1x 2 ) 0,

p

p

(

x

)

p

,

1

1

1

p2 p( x 2 ) p2 ,

p12 p( x1x 2 ) p12

1

p( x 1 )

px1x 2

p ( x 2 | x1 ) min

R,2

px1

px1x 2

p ( x 2 | x1 ) max

R,2

px1

75

Апостериорный вывод, ФЗ с [,]

Сведение:

p( x x ) 0,

1 2

p( x1) p( x1x 2 ) 0,

p( x ) p( x x ) 0,

1 2

2

1 p( x1) p( x 2 ) p( x1x 2 ) 0,

p

p

(

x

)

p

,

1

1

1

p2 p( x 2 ) p2 ,

p12 p( x1x 2 ) p12

px1x 2

p ( x 2 | x1 ) min

R,2

px1

px1x 2

p ( x 2 | x1 ) max

R,2

px1

1

p( x 1 )

p( x x ) 0,

1 2

p( x1) p( x1x 2 ) 0,

p( x ) p( x x ) 0,

2

1 2

1 p( x1) p( x 2 ) p( x1x 2 ) 0,

p

p

(

x

)

p

,

1

1

1

p2 p( x 2 ) p2 ,

p12 p( x1x 2 ) p12

p(x1x 2 )

p ( x 2 | x1 ) min

,2

Rd

p(x1x 2 )

p ( x 2 | x1 ) max

,2

Rd

76

Апостериорный вывод, ФЗ с [,]

Сведение:

p( x x ) 0,

1 2

p

(

x

)

p

(

x

x

)

0

,

1

1 2

p( x ) p( x x ) 0,

2

1

2

1 p( x1) p( x 2 ) p( x1x 2 ) 0,

p

p

(

x

)

p

,

1

1

1

p2 p( x 2 ) p2 ,

p12

p( x1x 2 ) p12

p(x1x 2 )

p ( x 2 | x1 ) min

,2

Rd

p(x1x 2 )

p ( x 2 | x1 ) max

,2

Rd

77

Апостериорный вывод, ФЗ с [,]

Сведение:

p( x x ) 0,

1 2

p

(

x

)

p

(

x

x

)

0

,

1

1 2

p( x ) p( x x ) 0,

2

1

2

d(f ) p(f )

1 p( x1) p( x 2 ) p( x1x 2 ) 0,

p

p

(

x

)

p

,

1

1

1

p2 p( x 2 ) p2 ,

p12

p( x1x 2 ) p12

p(x1x 2 )

p ( x 2 | x1 ) min

,2

Rd

p(x1x 2 )

p ( x 2 | x1 ) max

,2

Rd

1,

d( x x ) 0,

1

2

1 d( x1x 2 ) 0,

d

(

x

)

d

(

x

x

)

0

,

1 2

2

1 d( x 2 ) d( x1x 2 ) 0,

p1 1, 1 p1 ,

p

d

(

x

),

d

(

x

)

p

,

2

2

2

2

p12 d( x1x 2 ), d( x1x 2 ) p12

d( x1x 2 )

p ( x 2 | x1 ) min

,2

Rd

d( x1x 2 )

p ( x 2 | x1 ) max

,2

Rd

78

Несовместимость со свидетельством

p000

p001

p010

p011

p100

p101

p110

p111

~

x1

~

x2

~

x3

<x1>

~

x1

~

x2

~

x3

p001

p011

p101

p001+p011+p101+p111

p111

79

Апостериорный вывод при недетермом свидетельстве

<p[a](x1x2)>

<x1x2>

C

<x1x2>

C

p(Z|<x1x2>)

p(Z|<x1x2>)

×p[a](x1x2)

×p[a](x1x2)

S

<x1x2>

C

<x1x2>

C

p(Z|<x1x2>)

p(Z|<x1x2>)

p(Z|<p[a](x1x2)>)

×p[a](x1x2)

×p[a](x1x2)

80

Примеры формул для рассчетов

p p[a] x~ | C p x~ | C p[a] x~ ;

x~

pa ZY |

pa ZY |

p p[a] x~ | C Epˆ p[a] x~ | C ;

a Y

~

p[a] x~ Epˆ a ZY | p[a] x~

p x~

p Z | x~ p

[a ]

;

[a] x~ .

x

p p[a] x~ | C Epˆ p[a] x~ | C ;

~

~

~

~

~

p p[a] x | C p x | C p[a] x ;

p x | C p[a] x ;

x~

x~

p a ZY | p[a] x~ Epˆ a ZY | p[a] x~ ;

~

~

~

~

~

p a ZY | p[a] x pa ZY | x p[a] x ;

pa ZY | x p[a] x .

x~

x~

81

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

82

Алгебраическая байесовская сеть

Это множество фрагментов знаний,

как правило, связанных между собой

(имеющих общие конъюнкты),

которые рассматриваются как единое

целое.

83

Граф и дерево смежности - веса

Узлу графа смежности ставится в

соответствие фрагмент знаний;

весом же узла является идеал

конъюнктов, лежащий в основе

этого ФЗ.

84

Граф смежности --- определение

Графом смежности называется

ненаправленный граф, в котором

между каждой парой узлов, веса

которых содержат общие элементы,

существует путь;

в веса каждого из узлов любого пути

(в графе) входят все элементы,

общие для начального и конечного

узлов этого пути;

вес одного узла не входит полностью

в вес никакого другого узла.

85

Сепараторы

Каждому ребру в графе смежности

также удобно приписать вес –

пересечение весов, приписанных тем

двум узлам, которые соединяются

рассматриваемым ребром.

Вес на ребре --- сепаратор (или

разделитель).

Непустое пересечение идеалов

конъюнктов --- идеал конъюнктов.

86

Дерево смежности

Деревом смежности называется

ациклический граф смежности --–

такой граф, что в нем нет ни

одного цикла, то есть пути (без

повторяющихся узлов), начало и

конец которого бы совпали.

87

АБС --- определение

Алгебраическая байесовская сеть (АБС)

определяется как граф смежности с

фрагментами знаний в узлах.

АБС, представимая в виде дерева

смежности, называется ациклической

(ААБС).

АБС является одной из логиковероятностных моделей БФЗ с

неопределенностью.

88

АБС --- графическое представление

<x1, x2>

<x2>

<x2, x3>

<x2>

<x1, x2>

<x2, x3>

а

<x1>

<x1>

<x1, x2>

<x1, x3>

<x1>

<x3>

<x1, x3>

б

<x1>

<x1, x2>

<x1, x4>

<x1, x3>

<x1>

<x1>

<x1>

в

<x1>

<x1, x2>

<x1>

<x1, x3>

<x1>

<x1, x4>

<x1, x4>

г

д

<x1, x2, x3>

<x2, x3>

<x2, x3, x4>

<x3, x4>

е

<x3, x4, x5>

<x4, x5>

<x4, x5, x6>

89

Ациклические АБС

~

<p[a](V0)>

<V0X1V1>

~

<p[a](V1)>

<V1>

<V1X2V2>

~

<p[a](V2)>

<V2>

<V2X3V3>

<V3>

~

<p[a](V3)>

<Vi>

~

<p[a](Vi)>

<ViXi+1Vi+1>

<Vi+1>

~

<p[a](Vi+1)>

<Vn-1>

~

<p[a](Vn-1)>

<Vn-1XnVn>

~

<p[a](Vn)>

<Vn>

<VnXn+1Vn+1>

<p[a](...)>

а

б

90

Степени непротиворечивости АБС

Локальная,

Экстернальная,

Интернальная,

Глобальная

91

Степени непротиворечивости АБС

Локальная: непротиворечив

каждый фрагмент знаний по

отдельности.

Каждый фрагмент

знаний

непротиворечив

92

Степени непротиворечивости АБС

Экстернальная: совпадают

оценки пересекающихся

фрагментов.

Здесь оценки

совпадают

93

Степени непротиворечивости АБС

Интернальная: распределения

вероятностей совпадают на

конъюнктах, общих для двух или

более ФЗ.

Решаем общую ЗЛП, где

пересекающиеся переменные

совпадают

94

Степени непротиворечивости АБС

Глобальная: непротиворечив

объемлющий фрагмент знаний.

95

АБС: интернальная и глобальная

непротиворечивость

x1x2

x1x3

x2x3

<x2>

<x1, x2>

<x1>

x1

x2

x3

<x2, x3>

<x3>

<x1, x3>

p( x1 ) p( x2 ) p( x3 ) 0.5;

p( x1x2 ) p( x2 x3 ) 0.5;

p( x1x3 ) 0.

p( x1x2 x3 ) 0;

p( x1x2 x3 ) p( x2 ) p( x1x2 ) p( x2 x3 ) p( x1x2 x3 )

0.5 0.5 0.5 0 0.5 (???)

96

ААБС: интернальная и глобальная

непротиворечивость

Ациклическая АБС, непротиворечивая

интернально, глобально

непротиворечива.

pW

~

W pW

0,

~ ~~

~~

~~

XYZ pV ( XY )pU (YZ )

~

p

(

Y

)

V

~

pV (Y ) 0,

~

pV (Y ) 0,

97

ААБС: интернальная и

экстернальная непротиворечивость

Экстернально непротиворечивая

ациклическая АБС может быть

интернально противоречивой.

Есть класс ациклических сетей, у

которых из экстернальной

непротиворечивости следует

интернальная.

98

Апостериорный вывод:

свидетельства

Детерминированное

свидетельство (и кортеж ДС);

Недетерминированное

свидетельство (и кортеж НДС);

Недетерминированное

свидетельство (и кортеж НДСН).

99

Апостериорный вывод: два ФЗ

~ ~

<XnVn>, p(XnVn)

~

<Vn>, p(Vn)

~ ~

<VnXn+1>, p(VnXn+1)

~ ~~

<XnVnXn+1>, p(XnVnXn+1)

~

<p[a](Vn-1)>

<p[a](...)>

100

Передача виртуального

свидетельства между ФЗ

<XnVn>

~

<p[a](Vn-1)>

<Vn>

~

~

~

<p[a](Vn) = pa(Vn|<p[a](Vn-1)>)>

<VnXn+1>

<p[a](...)>

101

Апостериорный вывод в ААБС

~

<p[a](V0)>

<V0X1V1>

~

<p[a](V1)>

<V1>

<V1X2V2>

~

<p[a](V2)>

<V2>

<V2X3V3>

<V3>

~

<p[a](V3)>

<Vi>

~

<p[a](Vi)>

<ViXi+1Vi+1>

<Vi+1>

~

<p[a](Vi+1)>

<Vn-1>

~

<p[a](Vn-1)>

<Vn-1XnVn>

~

<p[a](Vn)>

<Vn>

<VnXn+1Vn+1>

<p[a](...)>

а

б

102

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

103

Байесовские сети доверия

Основная цель байесовских сетей доверия, как и

в случае АБС,— представление распределения

вероятностей над переменными (возможно

многозначными) в удобном для обработки и

компактном виде.

В качестве такого представления выбран

ациклический направленный граф с тензорами

условных вероятностей.

104

Простейшие БСД

x

z

p(x )

u

p(z )

p(y )

p( y | x )

p( y | x )

y

w

p(w | zu )

p(w | zu )

p(w | zu )

p(w | zu )

105

БСД односвязная

x

p(x)

p(z)

p(u | y )

p(u | y )

z

u

y

p( y | x )

p( y | x )

v

p( w | z u )

p( w | zu)

p( v | y )

p( v | y )

p( w | z u )

w

p( w | zu)

106

БСД с допустимыми циклами

x

p(x)

p(u | y )

p(u | y )

y

p( y | x )

p( y | x )

p( v | y )

p( v | y )

u

v

p( w | u v )

p( w | u v )

w

p( w | u v )

p( w | uv )

107

БСД с недопустимым циклом

x

p(x)

p( y | xv )

p( y | xv )

y

p(u | y )

p(u | y )

p( y | xv )

p( y | xv)

p( v | w )

p( v | w )

u

v

p( w | u )

p( w | u)

w

108

Пример БСД

p(t ) 0.01

p(u | t ) 0.16

t

Компьютер упал

со стола

p(v | t ) 0.001

p(u | t ) 0.05

u

На жестком

диске появились

дефектные

секторы

p(v | t ) 0.1

p(w

p(w

p(w

p(w

| uv ) 0.95

| uv ) 0.25

| u v ) 0. 9

| u v ) 0.02

v

Нарушен один

из контактов

блока питания

w

Компьютер

не загружается

p( x | u ) 0.2

p( x | u ) 0.025

x

При диагностике

логический диск

недоступен

p( y | w ) 0.4

p( y | w ) 0.001

y

На экране

монитора нет

изображения

p( z | v ) 0.99

p( z | v ) 0.001

z

Индикатор

питания

не горит

109

Типы связей в БСД

1

1

2

б

2

а

3

3

1

2

3

в

а – последовательная связь;

б – расходящаяся связь; в – сходящаяся связь.

110

Понятие d-разделимости

Два узла называются

d-разделимыми, если любой путь

между ними содержит

последовательную или

сходящуюся связь, в центральный

узел которой поступило

свидетельство, или расходящуюся

связь, в центральный узел (и его

потомки) которой не поступило

свидетельство.

111

Основное предположение

d-разделенные узлы независимы.

Это предположение позволяет

однозначно восстановить

распределение вероятностей над

всеми переменными.

112

Несколько условий формально на

примере нашей сети

p(u|t) × p(v|t) = p(uv|t)

p(t|uv) × p(w|uv) = p(tw|uv)

…

В такой форме эти предположения

уже не кажутся столь очевидными

113

Что нам дают такие предположения

Независимость d-разделимых

[переменных в узлах] позволяет

выделить единственное распределение из

всех, для которых подходят заданные

условные вероятности.

Это единственное распределение -произведение всех вероятностей,

заданных в БСД (chain rule).

114

Chain rule для нашего примера

~

~

~

~

~

~

~

~

~

~

p( t u v wx y z ) p( t ) p(u | t )

~

~

~

~

~

~

~

p (v | t ) p ( w | u v ) p ( x | u )

~

~

~

~

p( y | w) p( z | v )

115

Но все же…

Несмотря на указанную выше

формализацию, методы работы с

БСД позволяют использовать chain

rule неявно.

116

Первичная пропагация

Вычисление вероятностей всех

переменных (по отдельности),

входящих в нашу сеть.

117

Простейший (в лоб) алгоритм

первичной пропагации

По определению условной

вероятности:

p(u ) p(u | t ) p(t ) p(u | t ) p(t )

Аналогично хочется поступить с

остальными вероятностями.

118

Алгоритм первичной пропагации для

ациклических направленных графов

Очевидно, что в описанном выше

примере нам в ходе вычисления p(w)

потребуются вероятности

p(uv), p(uv ), p(u v), p(u v ).

именно в такой ситуации и требуется

chain rule и понятие d-разделимости.

В частности получаем, что

p(uv|t) = p(u|t) × p(v|t),

аналогично для отрицания t и

суммируем.

119

Первичная пропагация, обобщенный

алгоритм «на пальцах»

Если мы хотим вычислить вероятность

какого либо узла, то мы должны

просуммировать совместное

распределение по означиванию всех

остальных переменных

(маргинализовать).

Но, так как все наше распределение

разбивается на произведение

достаточно простых, можно проводить

суммирование по очереди по одной

(иногда по нескольким) переменным за

раз, при этом большая часть

сомножителей не будет от них зависеть.

120

Первичная пропагация связь

простого и обобщенного алгоритмов

Простой алгоритм — это всего лишь

удачный порядок суммирования для

обобщенного алгоритма.

Обобщенный алгоритм понадобится при

появлении свидетельств.

Для обобщенного алгоритма удобно

определить на БСД структуру дерева

смежности.

121

Моральный граф

Моральным графом для БСД

называется ненаправленный

граф, в котором вершины те же, и

две вершины соединены ребром,

если они либо соседствуют, либо

имеют общего сына в исходной

БСД.

122

Пример морального графа

t

u

v

w

x

y

z

123

Если моральный граф триангулярен

То его можно разбить на клики,

которые затем можно объединить

в дерево смежностей (разными

вариантами).

Каждая максимальная клика

попадает в отдельный

[соответствующий ей] узел дерева

смежности.

124

Если не триангулярен

То придется его триангулировать.

Это требуется сделать, добавив,

по возможности, «минимум»

ребер.

125

Дерево сочленений

t, u, v

~~

p(u|t), p(v|t),

~

p(t)

~~

u

u, x

~ ~

p(x|u)

u, v

v

u, v, w

v, z

~ ~~

p(w|uv)

~~

p(z|v)

w

w, y

~ ~

p(y|w)

126

Пропагация свидетельств

Но главная задача БСД — это всетаки пропагация свидетельств

(апостериорный вывод).

Иными словами, мы знаем

апостериорные означивания

нескольких узлов и хотим

получить условную вероятность

остальных.

127

Переход к пропагации свидетельств

Мы умеем вычислять маргинальные

вероятности.

Давайте в процессе вычисления в

нужном месте «заменим» «настоящую»

вероятность единицей или нулем в

зависимости от свидетельства.

Это гарантирует, что мы получим

правильные вероятности в тех узлах,

что ниже.

Как же учесть влияние на

предшествующие узлы?

128

Алгоритм пропагации свидетельств,

«на пальцах»

Мы поступим как в обобщенном

алгоритме первичной пропагации

Для переменной, условную

вероятность которой мы хотим

получить, нам придется придумать

хороший порядок маргинализации

из совместного распределения.

129

Дерево сочленений обеспечивает

хороший порядок обхода

(суммирования)

u

v, z

v, z

v

v

t, u, v

t, u, v

u, v

~|u

~)

~ p( x

x

u, x

u

~|u

~)

~ p( x

x

u, v, w

w

u, x

u, v

~|u

~v

~)

~ p(w

w

u, v, w

w

~|w

~)

y~ p( y

w, y

w, y

130

Для нашего примера

v, z

v, z

v

~

p(u v~ | tw )

v

~

p(u | t ), p(v~ | t )

t, u, v

t, u, v

u

u, v

u

1

1

1

u, v

~

p(u v~ | w )

u, x

u, v, w

u, x

u, v, w

w

w

1

1

w, y

w, y

131

Выгода считать все сразу

Двукратный проход по дереву

смежности дает нам все искомые

вероятности.

Для вычисления одной

вероятности можно пройти один

раз (искомая помещается в

вершину).

132

Проблема направленного цикла

Наличие направленного цикла в

байесовской сети доверия

приводит к тому, что chain rule не

работает.

Но часто можно построить

распределение, удовлетворяющее

заданным условным вероятностям.

Такое распределение может быть

не единственным: исходным

данным может отвечать семейство

распределений.

133

Изолированный цикл с бинарными

переременными

Условные

вероятности

задают

ограничения на

маргинальные

вероятности.

Эти ограничения

можно

представить в

виде системы

линейных

уравнений.

x2

_

p(x2|x1)

p(x2|x1)

_

p(x3|x2)

p(x3|x2)

x1

x3

_

p(x1|xn)

p(x1|xn)

_

p(xn|xn-1)

p(xn|xn-1)

x0=xn

xn-1

134

Линейные уравнения, задаваемые

изолированным циклом

,

p ( x1 ) p ( x1 | xn ) p ( xn ) p ( x1 | xn )(1 p ( xn )),

p ( x2 ) p ( x2 | x1 ) p ( x1 ) p ( x2 | x1 )(1 p ( x1 )),

p ( xn ) p ( xn | xn 1 ) p ( xn 1 ) p ( xn | xn 1 )(1 p ( xn 1 )).

135

Линейные уравнения, задаваемые

изолированным циклом,

в матричном представлении

ij p( xi | x j ) p( xi | x j )

A

1

21

0

0

0

1

32

0

0

0

1

0

0

0

0

n,n 1

1n

0

0

1

p ( x1 )

p( x2 )

p p ( x3 )

p

(

x

)

n

p( x1 | xn )

p( x2 | x1 )

B p( x3 | x2 )

p

(

x

|

x

)

n

n 1

det A 1 ( 1)n 1n 2132. n,n 1

136

Погружение во фрагмент знаний

алгебраической байесовской сети

x1x2...xn-1xn

x1x3

x2x3

x3xn-2

x1x2

x2

x1

x1xn

x3

xn-2xn-1

xn-1xn

xn-2

x1xn-1

xn-2xn

xn

xn-1

137

Результат погружения

Мы можем получить оценки (возможно

интервальные) на всевозможные

конъюнкции положительно означенных

элементов.

Мы можем выяснить, что имеющиеся

оценки не соответствуют аксиоматике

вероятностной логики.

138

Направленный цикл с потомками

Потомок имеет одного родителя из

цикла;

Потомок является сыном двух соседних

узлов;

Потомок является сыном двух не

соседних узлов;

Потомок является сыном трех и более

узлов.

139

Потомок имеет одного родителя

из цикла

Мы уже получили точечные

значения маргинальных

вероятностей всех элементов

цикла.

Маргинальная вероятность

родителя, может быть

рассмотрена как заданная

изначально и

обрабатываться

традиционным для БСД

способом.

140

Потомок является сыном двух

соседних узлов

Для двух соседних

узлов нам полностью

известно совместное

распределение.

Данное распределение

можно использовать

для дальнейшей

пропагации

традиционным

образом.

141

Потомок является сыном двух

несоседних узлов

Распределение над

родительскими узлами

можно найти с

точностью до одного

параметра.

Если зафиксировать этот

параметр, то можно

проводить обычную

пропагацию.

142

Потомок является сыном трех и

более узлов

Сложности связаны с

большим количеством

параметров.

Параметры связаны друг

с другом и не все их

сочетания возможны.

Пропагация проводится с

учетом этих параметров.

Может требовать

решения ЗЛП.

143

Учет влияния предков

Главная проблема – нельзя

выписать систему линейных

уравнений.

Причина – нельзя зная условную

вероятность относительно двух

узлов, редуцировать ее до

условной вероятности одного из

них.

144

Путь решения

Можно зафиксировать все

возможные означивания

родителей.

Для каждого означивания мы

получаем изолированный цикл.

Проводим обработку цикла и

производим суммирование с

учетом вероятности каждого

конкретного означивания

родителей.

145

Проблема

Возможна ситуация, когда при

одних означиваниях цикл

непротиворечив, а при других

противоречив.

146

Возможное решение

Исключить «плохие» означивания

родителей.

Пересчитать байесовскую сеть

доверия с учетом «невозможных»

состояний.

147

Погружение БСД в АБС

3

{x,u}

{x}

t

Компьютер упал

со стола

{t,u}

t

2

4

u

v

{t,u,v}

5

{u,v,w}

w

u

На жестком

диске появились

дефектные

секторы

v

Нарушен один

из контактов

блока питания

1

6

x

7

y

tu

u

x

w

Компьютер

не загружается

ux

w

uv

wu

z

v

vz

wv

wy

tuv

y

tv

tu

y

На экране

монитора нет

изображения

z

Индикатор

питания

не горит

{v,z}

tv

wuv

x

При диагностике

логический диск

не доступен

{w,y}

z

t

u

t

uvw

uv

wv

tv

v

wy

y

w

vz

ux

x

z

148

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

149

Базовые дисциплины

Математические

Информатика

Математическая логика

Теория вероятностей

Экстремальные задачи

Теория графов

Представление данных

Базы данных

Искусственный интеллект

Представление неопределенности

Логико-вероятностный вывод

Мягкие вычисления

150

Особенности материала

Части материала «масштабируются»

под нужды конкретного курса и

конкретной аудитории;

В возникающих экстремальных задачах

используются объекты, знакомые

математикам (а не насильно

заимствованные из экономики);

Много задач для программирования,

удобно для организации семинаров и

практикумов;

«Неисчерпаемая тематика» для

курсовых и дипломных работ

151

Полезные навыки

Для изучения математической

статистики (и способов ее

применения на практике);

Для дальнейшего овладения

теорией надежности (структурно

сложных систем в рамках ЛВМ и

родственных ему)

Для освоения аппаратов

небайесовских мер истинности

152

ПЛАН

БС — что это

БС — праксис и генезис

Вероятностная логика

Фрагменты знаний (ФЗ)

Алгебраические байесовские сети

Байесовские сети доверия

БС — дидактическое применение

БС — монография

153

Монография

Тулупьев А.Л., Николенко С.И.,

Сироткин А.В.

Байесовские сети: логиковероятностный подход

СПб.: Наука, 2006

607 стр.

ISBN 5-02-025107-0

Изд. грант РФФИ 06-01-14108

154

Обложка

155

Разворот обложки

156

Дополнительный материал

157

Мягкие вычисления (SC)

Консорциум вычислительных

методологий, которые

коллективно обеспечивают

основы для понимания,

конструирования и развития

интеллектуальных систем

Заде Л.А. Роль мягких вычислений в понимании, конструировании

и развитии информационных/интеллектуальных систем // Новости

искусственного интеллекта. 2001. 2—3 (44—45).

158

Мягкие вычисления: отрасли

Нечеткая логика (FL)

Нейровычисления (NC)

Генетические вычисления (GC)

Вероятностные вычисления (PC)

Рассуждения на базе свидетельств (ER)

[Байесовские сети] (BN)

Хаотические системы (ChS)

Машинное обучение (ML)

Заде Л.А. Роль мягких вычислений в понимании, конструировании

и развитии информационных/интеллектуальных систем // Новости

искусственного интеллекта. 2001. 2—3 (44—45).

159

Цель и задачи исследования

160

Декомпозируемость знаний

Эксперт не мыслит о закономерностях

предметной области как о «связи всего

со всеми»

Выделяются фрагменты знаний

(Knowledge patterns), которые содержат

достаточно подробные сведения о

небольшом числе объектов (или

утверждений) о предметной области, а

также о связях между ними

161

Модель утверждения

Атомарная пропозициональная

формула (булевская переменная,

пропозициональная переменная,

атомарная пропозиция) --- модель

«атомарного» утверждения о

предметной области

Пропозициональные формулы --модели утверждений, возможно

сложных, о предметной области

162

Неопределенность

Почему возникает

Пропущенные наблюдения

Неточность средств измерения

Экспертные высказывания

Неудачные регистрационные формы

Частично незаполненное поле (только год в

дате рождения)

…

Как проявляется

Нужно ли обрабатывать

163

Виды неопределенности

Существует много видов,

например

неоднозначность и многозначность

слов;

возможность двух или более

интерпретаций записи даже на

формальном языке;

недетерминированность;

нечёткость (в т.ч. лингвистическая);

неточность (интервальные оценки);

недоопределённость...

164

Неопределенность утверждения

Истинностное означивание и мера

истинности

Мера истинности как степень доверия к

утверждению

Мера истинности как степень тесноты

связи между частями составной

пропозициональной формулы

Возможные значения и оценки меры

истинности

165

Объект исследования

Высказывания, суждения, утверждения,

представимые пропозициональными

формулами над булевскими

переменными;

Мера истинности которых

характеризуется количественно с

помощью вероятностных и/или

небайесовских оценок;

Которые могут быть как точечные, так и

интервальные [а в перспективе –

твинные].

166

Предмет исследования

Базы фрагментов знаний с

неопределённостью;

Фрагмент знаний – некоторая

[математическая] структура, состоящая из

небольшого набора «тесно связанных»

пропозициональных формул;

Мера истинности которых и теснота связи

охарактеризована:

тензором условных вероятностей – БСД;

представлением тензора совместных вероятностей,

допускающим точечные и интервальные оценки --АБС;

[обобщение последнего на небайесовские меры

истинности: нечёткую, доверия-правдоподобия,

необходимости-возможности...]

167

Логико-вероятностный подход

(ЛВП)

Вероятностная мера как мера

истинности

Точечные оценки значений

вероятностной меры

Интервальные оценки значений

вероятностной меры (как следствие

неопределенности)

«Интервальная вероятность» и

интервальная оценка вероятности

Единственность распределения и

семейство распределений вероятности

168

ЛВП --- богатая история

G. Boole, “An Investigation of the Laws of

Thought, on Which Are Founded the

Mathematical Theories of Logic and

Probabilities” (1854)

N. Nilsson, Probabilistic Logic (AI, 1986)

N. Nilsson, Probabilistic Logic Revisited

(AI, 1993)

De Finetti, Whaley, Ramsay, …

Школа логико-вероятностных методов в

теории надежности (рук. адм. И. А.

Рябинин) --- важнейшие приложения

169

ЛВП.

Непротиворечивость

Согласованность, согласуемость,

программный код

170

Пример ограничений:

E

2

C(x1, x2 ) x1, x2, x1x2

1 1 1 1 1

1 0 1 p( x1 )

0

0

0 0

1 1 p( x 2 )

0 0 0

p

(

x

x

)

1

1 2

1 p( x1 ) p( x 2 ) p( x1x 2 ) 0

p( x1 ) p( x1x 2 ) 0

p( x 2 ) p( x1x 2 ) 0

p( x1x 2 ) 0

171

Программный код на C++

for (i = 0; i < pow2(N); i++)

{

c.add(IloRange(env, 0.0, IloInfinity ));

for(j = 0; j < pow2(N); j++)

if (i & j = i)

{

//Проверка на четность количества 1 в i xor

j.

if (parity(i ^ j)) {c[i].setCoef(x[j], 1)};

else {c[i].setCoef(x[j], -1)};

}

}

172

Непротиворечивое распределение

Мы будем говорить, что набор оценок

p : C [0;1]

непротиворечив,

(является

. распределением вероятностей)

если он удовлетворяет условиям типаE

173

Фрагмент знаний

Идеал конъюнктов:

C( A ' ) x i1 x ik | 1 i1,, ik n

Ограничения на вероятность истинности:

p ( X) p( X) p ( X)

n

D

Эти ограничения будем обозначать

.

174

Графическое представление ФЗ

x1x2x3

x1x2

x1 x2

x1

x2

x1

x1x3

x2x3

x3

x2

175

Непротиворечивость

(согласованность) ФЗ

Фрагмент знаний

C непротиворечив, если

X C t [p ( X); p ( X)]

существует непротиворечивое распределение

Y C \ { X}

p:

p ( Y ) p( Y ) p ( Y )

p( X) t

176

Согласуемость ФЗ

ФЗ называется согласуемым, если существует

хотя бы одно непротиворечивое распределение

p

такое, что

Y C

p ( Y) p( Y) p ( Y)

177

Поддержание непротиворечивости

Для того чтобы получить из согласуемого

ФЗ согласованный, требуется решить ряд задач

линейного программирования.

Для каждого

X C

по две:

p ( X) min(p( X))

DE

p ( X) max(p( X))

DE

178

Байесовские сети доверия

Дополнительные сведения

179

Фрагменты знаний

первого порядка

x1

x1

x1

x1

180

Фрагменты знаний

второго порядка

x1x2

x1

x2

x1

x2

x2

x1

181

Фрагменты знаний

третьего порядка

x1x2x3

x1

x1x2

x1x3

x2

x2x3

x3

x1

x2

x3

182

Линейная цепь ФЗ (1)

x1x2

x2x3

x1

x2

x3

x1

x2

x3

x1

x2

x3

183

Линейная цепь ФЗ (2)

x3x4

x2x3

x1x2

x4

x3

x2

x1

x1

x2

x3

x4

x1

x2

x3

x4

184