46. МЕТОДЫ ОДНОМЕРНОГО ПОИСКА. ПРЯМЫЕ АЛГОРИТМ РОЗЕНБРОКА.

реклама

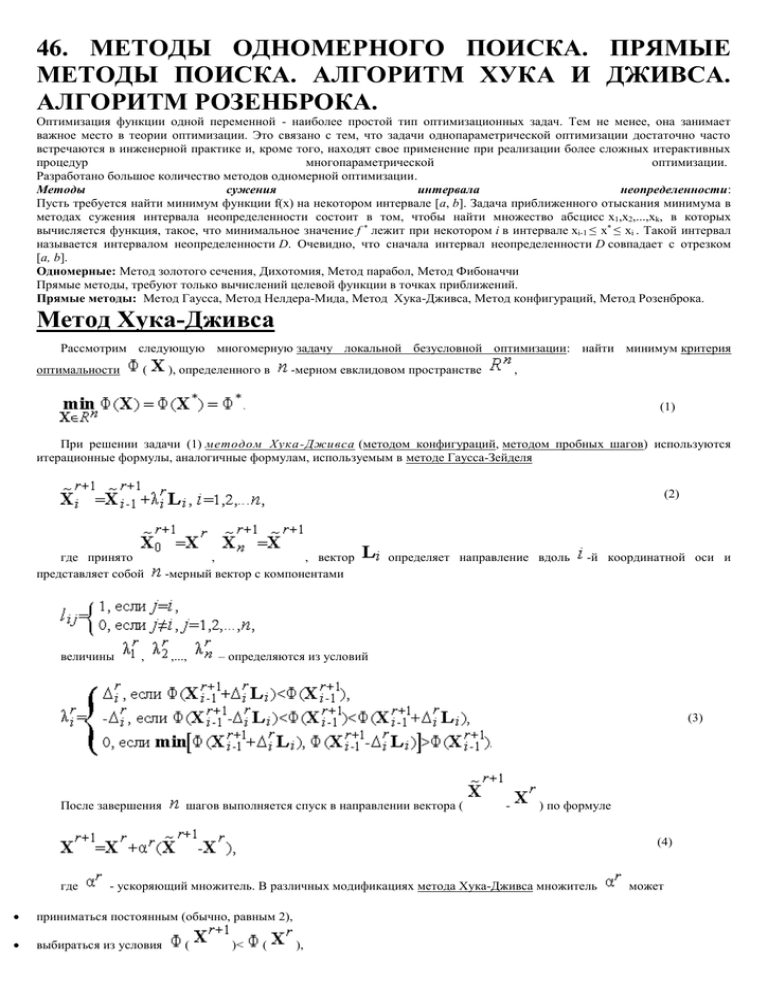

46. МЕТОДЫ ОДНОМЕРНОГО ПОИСКА. ПРЯМЫЕ МЕТОДЫ ПОИСКА. АЛГОРИТМ ХУКА И ДЖИВСА. АЛГОРИТМ РОЗЕНБРОКА. Оптимизация функции одной переменной - наиболее простой тип оптимизационных задач. Тем не менее, она занимает важное место в теории оптимизации. Это связано с тем, что задачи однопараметрической оптимизации достаточно часто встречаются в инженерной практике и, кроме того, находят свое применение при реализации более сложных итерактивных процедур многопараметрической оптимизации. Разработано большое количество методов одномерной оптимизации. Методы сужения интервала неопределенности: Пусть требуется найти минимум функции f(x) на некотором интервале [a, b]. Задача приближенного отыскания минимума в методах сужения интервала неопределенности состоит в том, чтобы найти множество абсцисс x1,x2,...,xk, в которых вычисляется функция, такое, что минимальное значение f * лежит при некотором i в интервале xi-1 ≤ x* ≤ xi . Такой интервал называется интервалом неопределенности D. Очевидно, что сначала интервал неопределенности D совпадает с отрезком [a, b]. Одномерные: Метод золотого сечения, Дихотомия, Метод парабол, Метод Фибоначчи Прямые методы, требуют только вычислений целевой функции в точках приближений. Прямые методы: Метод Гаусса, Метод Нелдера-Мида, Метод Хука-Дживса, Метод конфигураций, Метод Розенброка. Метод Хука-Дживса Рассмотрим следующую многомерную задачу локальной безусловной оптимизации: найти минимум критерия оптимальности ( ), определенного в -мерном евклидовом пространстве , (1) При решении задачи (1) методом Хука-Дживса (методом конфигураций, методом пробных шагов) используются итерационные формулы, аналогичные формулам, используемым в методе Гаусса-Зейделя (2) где принято представляет собой величины , , , вектор -мерный вектор с компонентами ,..., определяет направление вдоль -й координатной оси и – определяются из условий (3) После завершения шагов выполняется спуск в направлении вектора ( - ) по формуле (4) где - ускоряющий множитель. В различных модификациях метода Хука-Дживса множитель приниматься постоянным (обычно, равным 2), выбираться из условия ( )< ( ), может находиться из условия локального минимума функции вектора ( ) при движении из точки в направлении : (5) Заметим, что задачи (5) даже в случае одноэкстремальной функции ( ) могут быть многоэкстремальными задачами оптимизации и могут быть решены рассмотренными в главе 4 методами решения задач одномерной оптимизации. Итерации заканчиваются при выполнении одного из стандартных условий окончания итераций: (6) Вектор всем координатным осям. является вектором свободных параметров метода - вектором «пробных шагов» по Известна модификация метода Хука-Дживса, в которой точка Гаусса-Зейделя. Схема метода Хука-Дживса: 1. Задаем начальную точку , вектор «пробных» шагов 2. Последовательно для 3. Если переходим к п.2). 4. Если условие окончания поиска (6) или (6') выполнено, то полагаем =1,2,... определяется не процедурами (2), (3), а методом и полагаем по формулам (2), (3) находим точки =0. . , то переходим к п. 4). Иначе уменьшаем длины «пробных» шагов выполняем спуск в направлении вектора например, из условия (5). Полагаем , например, вдвое и и заканчиваем вычисления. Иначе по формуле (4), в которой ускоряющий множитель находится, и переходим к п. 2 Метод Хука-Дживса иллюстрирует рис. 1, на котором показаны линии уровня функции Химмельблау ( Ускоряющий множитель в направлении вектора находиться из условия локального минимума функции ( ) при движении из точки . Рис. 1. Траектория поиска минимума не овражной функции Химмельблау методом Хука-Дживса. =2). Метод Хука-Дживса имеет высокую эффективность в случае, если функция ( ) имеет прямолинейный овраг (не обязательно ориентированный вдоль одного из координатных направлений, как в методе Гаусса-Зейделя). При минимизации "овражных" функций, имеющих не прямолинейный овраг, процесс поиска может сильно замедлиться и закончиться далеко от точки истинного минимума (см. рис. 2). На рисунке показаны линии уровня функции Розенброка ( =2). Рис. 2. Траектория поиска минимума овражной функции Розенброка методом Хука-Дживса. Ускоряющий множитель αr принят равным двум. Метод Розенброка Рассмотрим следующую задачу локальной безусловной оптимизации: найти минимум критерия оптимальности ), определенного в -мерном евклидовом пространстве ( , (1) Ортогонализация Грамма-Шмидта. При решении задачи (1) методом Розенброка (методом вращающихся координат) используется преобразование на каждой итерации системы координат таким образом, чтобы в новой системе координат одна из осей совпадала с направлением предыдущего шага. Остальные оси новой системы координат обычно находят с помощью процедуры ортогонализации Грамма-Шмидта. Рассмотрим произвольный набор векторов пространства этих векторов ортонормированный набор векторов Напомним, что набор векторов набора выполняется условие . Поставим задачу построить на основе того же пространства . называется ортонормированным, если для любых двух векторов из этого (2) Или, другими словами, набор векторов скалярное произведение любых двух из них равно единице. Для построения векторов ортонормирован, если эти векторы линейно независимы и применим индуктивный подход. Положим, что (3) где виде - символ евклидовой нормы. Полагая векторы уже построенными будем искать вектор (4) Для отыскания неизвестных множителей умножим (4) скалярно на вектор : в Поскольку , имеем (5) Множитель найдем из условия : (6) Определение 1. Процесс перехода от векторов к векторам согласно формулам (3) – (6) называется ортогонализацией Грамма-Шмидта Схема метода Розенброка. Каждая итерация метода Розенброка состоит из двух этапов. В зависимости от модификации метода первый этап может выполняться с использованием различных методов. Рассмотрим применение на первом этапе итерационной формулы метода Гаусса-Зейделя. Приведем формулировку этой формулы, несколько отличную от формулировки, рассмотренной в параграфе 6.1. Положим , и пусть - орты системы координат, используемой на итерации. Тогда итерационную формулу метода Гаусса-Зейделя можно записать в виде -ой (7) где коэффициенты находятся из условий (8) На втором этапе каждой из итераций система векторов Шмидта заменяется новой системой линейно независимых векторов Схема метода Розенброка: 1. Задаем начальную точку , полагаем 2. Исходя из точки 3. совокупность векторов , ,..., . Если одно из стандартных условий окончания итераций , с использованием ортогонализации Грамма. , и орты исходной системы координат обозначаем . по формулам (7), (8) выполняем одну итерацию по методу Гаусса-Зейделя – получаем точку (9) 4. и выполнено, то полагаем 5. На основе векторов , и заканчиваем вычисления. Иначе переходим к п.4). находим векторы : (10) С помощью процедуры ортогонализации Грамма-Шмидта (3) –(6) выполняем переход от системы векторов к системе векторов , полагаем = +1 и переходим к п. 2 Заметим, что из формулы (10) следует равенство . По сравнению с методом Гаусса-Зейделя и методом Хука-Дживса метод Розенброка имеет, как правило, более высокую эффективность на овражных функциях с не прямолинейным оврагом. Метод Розенброка иллюстрирует рис. 1, на котором показаны линии уровня функции Химмельблау ( =2), Рис. 1. Траектория поиска минимума функции Химмельблау методом Розенброка.