Лекции по математическому анализу (3 семестр) - А-13-08

реклама

МОСКОВСКИЙ ЭНЕРГЕТИЧЕСКИЙ ИНСТИТУТ

(ТЕХНИЧЕСКИЙ УНИВЕРСИТЕТ)

Лекции

ЧИСЛЕННЫЕ МЕТОДЫ

4 семестр

Лектор Амосова Ольга Алексеевна

Москва, 2009/2010

Лекция № 1.

ОСНОВНЫЕ ТИПЫ ПОГРЕШНОСТЕЙ.

Классификация погрешностей.

Целые ответы – огромная редкость.

Основные типы погрешностей:

1. Неустранимые погрешности (погрешность модели, входных данных).

2. Погрешность метода (использование алгоритмов для решения задачи).

3. Вычислительная погрешность (при вычислениях на компьютерах).

Пример.

h

mgh

m 2

2 gh

2

1. Неточности: не учитывается сопротивление воздуха и т. п.

2. Метод (извлечение корня) – алгоритм Ньютона.

Определение 1.

Пусть а – точное значение, a n – приближенное значение той же величины, тогда:

Абсолютной погрешностью называется величина

(1)

an a an

Относительной погрешностью называется величина

1 a an an

2 a an 1 an

an

an

a

(2)

формы записи числа.

Пример.

e 2.718281828

en 2.72

en 2.718281828 2.72 0.003

en граница погрешности

en

en en 0.003

0.0011 en 0.11%

e

en

2.72

Определение 2.

Значащей цифрой числа называются все цифры в его записи, начиная с первой

ненулевой слева.

an 0.0385

bn 0.0012060

1|Страница

Определение 3.

Значащая цифра называется верной, если абсолютная погрешность числа не

превышает единицы разряда, соответствующего этой цифре.

Пример.

an 1.638

an 0.02

bn 1.638

bn 0.01

cn 12.486

cn 0.1

d n 0.0001921

d n 0.00008

en 0.012 катастрофическая потеря точности

en 0.1

Правила округления.

Правила округления:

1. Округление усечением.

n n1...1 0 .1 2 ... k k 1... m n n1...1 0 .1 2 ... k

Округлим до k-ого разряда вне зависимости от k 1 .

10 k

2. Округление по дополнению.

n n1...1 0 .1 2 ... k k 1... m n n1...1 0 .1 2 ... k*

k* k , k 1 5

*

k k 1. k 1 5

1

10 k 5 10 k 1

2

Договоримся, что, если число задано без погрешности, то абсолютная

погрешность числа равна половине оставленного разряда.

an 2.523

an 5 10 4

a 2.523 0.0005

Определение 4.

Нормальная форма записи числа

x n n1...1 0 .1 2 ... m 0. n n1...1 0 1 2 ... m 10 n1 .

x 10 p

0.1 1 – мантисса числа, p – порядок числа.

an 10 p

an 10 p

10 p

an

10

0.1

10 p

2|Страница

Пример.

106.38 0.10638 103

0.00354 0.354 10 2

Оценка погрешностей арифметических операций и функций.

Утверждение 1.

Абсолютная погрешность an bn не превышает абсолютных погрешностей

аргументов.

an bn a b an bn a an b bn a an b bn an bn

Утверждение 2.

Относительная погрешность произведения и частного не превышает суммы

относительных погрешностей аргументов.

anbn

ab anb anb an bn

b a an an b bn

an bn ab anbn

an bn

an bn

an bn

an bn

an bn

Оценка погрешности функции одной переменной.

Дана функция y f x .

x xn xn

f ?

f f x f xn f x xn M 1x

M1 max f x на отрезке, содержащем x и x n .

Пример.

f x x

x x n x

f x

1

2 x

f M 1x

1

x

f

x

1

2

x

f

x

f

2 x 2

x

Основная задача теории погрешностей:

Дана функция m переменных

f f x1 , x2 ,..., xm

xi xi* xi , xi* приближенное значение

3|Страница

Требуется найти f , f .

Теорема 1.

Если функция непрерывно дифференцируема по любому аргументу, то верна

общая формула погрешностей:

f

x j

x , x x

j 1

j

m

f max*

j

(3)

j

Запишем следующую формулу (2 члена приближения формулы Тейлора):

df ~

x ~

f x f x

, x внутренняя точка отрезка x, x* .

1!

m

f *

df x*

x x j x*j

j 1 x j

*

f x f x

*

m

f

~

df x max*

x*j

x j , x j x

j 1

j

Пример.

y y x, z x z , x, z

y ?

y

1

x

y 1 x 1 z

y

1

z

Определение 5.

Будем

называть

абсолютным

числом

обусловленности

число

,

удовлетворяющее y x и относительным числом обусловленности число ,

удовлетворяющее y x , где

x, x – абсолютная и относительная погрешности входного данного;

y, y – абсолютная и относительная погрешности результата.

Определение 6.

Будем называть задачу хорошо обусловленной, если относительное число

обусловленности 10 и плохо обусловленной – в противном случае.

4|Страница

Лекция № 2.

ОСОБЕННОСТИ МАШИННОЙ АРИФМЕТИКИ.

Корректность вычислительной задачи.

Определение 1.

Будем называть вычислительную задачу корректной по Адамару, если:

1. Решение существует для всех допустимых входных данных.

2. Решение задачи устойчиво, т. е. непрерывным образом зависит от входных

данных (малой погрешности входных данных соответствует малая

погрешность результата).

3. Решение задачи единственно.

Пример.

Ax B

По правилу Крамера det A 0 решение существует и единственно xi

i

.

1) 0 !

2) 0 неопределенность задача некорректна.

rank A

0

o~

0 0

r 1

0 0

o

0 0

r 0

Задача не является корректной.

Задача вычисления интеграла непрерывной функции f x a, b .

b

I f x dx

a

f x приближение f x .

*

f * x f * x f x

b

I f * x dx

*

a

b

I *

a

b

b

b

a

a

a

f * x dx f x dx f * x f x dx f * x dx f x b a

I b a

*

max f –погрешность входных данных.

I *

0

0

Пусть x X – множество входных данных, y Y – множество решений.

, – числа обусловленности задачи.

5|Страница

y x

y x

В задаче вычисления интеграла получили I * f *

b a .

Найдём относительное число обусловленности задачи

b

b

I * f * x f x dx f * x f x dx

a

a

b

f x dx

f

x

f

x

dx

a

I * a

*

I *

f

x

b

b

I

f x dx

a f x dx

a

b

*

Если f x 0 на a, b 1 , то задача хорошо обусловлена.

Если f x – осциллирующая (например, sin с малым периодом), то 10 .

Найдём оценку числа обусловленности вычисления функции одной переменной.

y f x

y * f * x

x, x

y y y * f x f * x* f x x* M 1 x x* M 1x*

M 1 max

f – абсолютное число обусловленности.

*

x , x

y

y M 1 x x M 1 x

x

y

yx

y

Пример.

При каких значениях x задача вычисления функции y e x является хорошо

обусловленной задачей?

y x

10

ex

x x x

e

плохо

-10

обусловлена

хорошо

обусловлена

10

плохо

обусловлена

Принцип равных влияний.

Рассмотрим задачу

6|Страница

y f x1 , x2 ,..., xm

xi y

f *

x x j общая формула погрешностей

x j

m

y

j 1

(1)

Обратная задача теории погрешностей:

Каковы должны быть погрешности аргументов, чтобы погрешность функции не

превышала заданной точности .

Будем считать, что каждое входное данное имеет одну и туже погрешность

f *

x x j x j

x j

m

f *

m

x

x j

, j 1,2,...m

Представление данных в ЭВМ.

x 0.1 2 ... m 10 p 10 p , 0.1 1

Гипотетическая ЭВМ будет содержать t разрядов мантиссы.

t разрядов мантиссы

знак

числа

порядок числа

знак

порядка

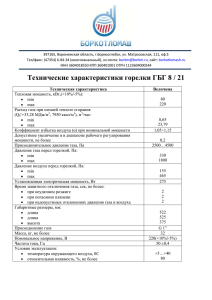

Рис 1. Структура ячейки памяти ЭВМ.

В двоичной форме i 0,1, p 0 1... L , i 0,1 .

1 1 всегда для того, чтобы не хранить не значащих разрядов в ячейках памяти.

Пример.

x

1

2 3 0.0012 0.12 2 2

8

Проблемы:

1. Диапазон представления чисел в ЭВМ ограничен:

a. Только рациональные числа, т. е. степени числа 2.

b. Из-за ограниченности разряда мантиссы и порядка числа существует

так называемая машинная бесконечность. Кроме того существует

машинный нуль и машинное .

2. Погрешность арифметических операций.

7|Страница

a b a b M a b M

a b

a b

ab

Определение 2.

Машинная бесконечность x – максимально большое представимое в ЭВМ число.

Машинный нуль x0 – минимальное положительное представимое в ЭВМ число.

Машинное эпсилон M – относительная погрешность представления числа в

ЭВМ.

Пример.

Рассмотрим пятиразрядную гипотетическую ЭВМ.

1

1010.012 0.1010012 2 4

4

Представлено число: 0.101012 2 4 10.5

0.25

0.025 2.5%

10

10.25 2 8

Рассмотрим двоичную запись нормализованного числа:

x 0.1 2 ... m 2 p 2 p , i 0,1

x 2 p

1

1

2

x 2 t 1 2 p

x

2 t

p

x

2

2 t 1 2 p ,

M 2 t при условии, что округление по дополнению в ЭВМ.

Нелинейные уравнения.

kx b 0 – линейное уравнение.

ax 2 bx c 0

Pn x a0 a1 x a2 x 2 ... an x n 0 –

алгебраическое уравнение (при n 5 не

существует аналитического решения).

sin 3x 1 0 – трансцендентное уравнение, содержит трансцендентные функции

(тригонометрические, логарифмические, экспоненциальные).

Алгоритм половинного деления.

f x 0

x – корень уравнения.

Определение 3.

Будем называть корень уравнения x корнем кратности k, если:

8|Страница

f x 0

f x 0

f x 0

...

f k 1 x 0

f k x 0

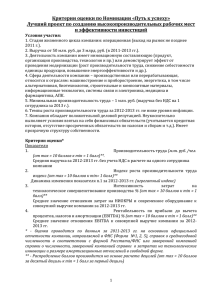

Метод половинного деления:

1. f a f b 0

2. c

ab

2

a. Если f a f с 0 , то a, b a, c.

b. Иначе a, b c, b .

b a 2

aB

3. Критерий окончания x

2

заданная точность

a

c

x

b

Рис. 2. Метод половинного деления.

9|Страница

Лекция № 3.

РЕШЕНИЕ НЕЛИНЕЙНЫХ УРАВНЕНИЙ.

Постановка задачи о приближенном решении уравнения f x 0 .

Найти xn : xn x , – заданная точность.

x xn

Этапы нахождения xn :

1. Локализация корней – выделение отрезков, в которых содержится корень

уравнения. Способы локализации:

a. Табличный.

b. Графический.

2. Уточнение корня – вычисление корня с заданной точностью.

Определение 1.

Отрезок a, b будем называть отрезком локализации корня, если внутри a, b

только один корень уравнения.

Рис. 1. Отрезки локализации корней.

Определение 2.

Будем называть методы прямыми, если за конечное число шагов метод позволяет

найти точное решение, при условии отсутствия погрешности.

Пример.

x 2 px q 0

2

p

p

x q

2

2

Определение 3.

Под итерационными методами будем понимать методы,

бесконечную последовательность приближений к решению.

получающие

Определение 4.

xn x .

Будем называть итерационный метод сходящимся, если lim

n

10 | С т р а н и ц а

Метод простой итерации (МПИ).

x2 ex 0

Табличный способ:

y

f x x 2 e x

f 1 1 e 1 0

f 0 1 0

f 1 1 e 0

Графический способ:

f x 0 g1 x g 2 x

x

0

x2 ex

a, b 1,0

f x 0 x x

x – итерационная функция.

xn1 xn

x0 a, b – произвольная точка отрезка локализации.

x0 1

x2 ex x ex

x 0 1

x1 e 1 0.6065

x2 e 0.6065 0.7384

x3 e 0.7384 0.7078

x4 e 0.7078 0.7020

x5 e 0.7020 0.7040

x6 e 0.7040 0.7034

x7 e 0.7034 0.7034

x 0.7034 0.0001

Теорема 1.

О достаточном условии сходимости метода простой итерации.

Пусть f x 0 x x – исходное уравнение, a, b – отрезок локализации x ,

x C 1 a, b и q max x .

a ,b

Тогда, если q 1 , то МПИ сходится при любом начальном приближении x0 a, b

и справедливы оценки:

11 | С т р а н и ц а

xn x q n x0 x

xn x

q

xn1 xn

1 q

x x

xn xn1 – расчётная формула МПИ.

xn x xn x xn1 x q xn1 x q 2 xn2 x ... q n x0 x , xn1 , x

xn x q xn1 x q xn1 xn xn x q xn1 xn q xn x 1 q xn x q xn1 xn

xn x

q

xn 1 xn

1 q

Замечание.

Оценка

xn x q n x0 x

q 1 q n 0 lim xn x .

называется

априорной

и

показывает,

что

n0

Оценка xn x

q

xn1 xn

1 q

называется апостериорной оценкой и показывает

связь абсолютной погрешности вычислений xn с разностью xn1 xn .

Критерий окончания МПИ.

q

1 q

xn xn1 xn xn1

1 q

q

Пример.

x 2 e x x x e x

a, b 1,0

1

1 x

x

ex

e

2

2 ex

1

q max x 1 метод сошёлся.

1, 0

2

xn xn1

Универсальный алгоритм приведения уравнения к виду,

удобному для итерации.

f x 0 x x f x , параметр.

x x f x

x 1 f x

x 1 f x 1 условие сходимости.

0 f x 2

f x на отрезке локализации должна быть знакопостоянна.

Знак должен совпадать со знаком производной f x на a, b.

12 | С т р а н и ц а

Оптимальное значение параметра .

f x 0

M 1 max f x

y

a ,b

1

m1 min f x

~

q~

q~

a ,b

q 1 f x

q~ q , m 1 m

1

x

1

1

M1

m1

Рис. 2. Оптимальное значение параметра.

0

1

~

q~ q , M 1 1 M 1

~

q max q~, q~

1 m1 1 M 1

2

– минимальное значение функции q .

m1 M 1

m

m1 M 1 2 1

m

2

M 1 M 1 m1 1

q 1

1

m1 M 1 M 1

m1 M 1

M 1 m1

Метод простой итерации с оптимальным выбором параметра.

f x 0

M 1 max f x

a ,b

m1 min f x

a ,b

2

m1 M 1

xn1 xn f xn

q

M 1 m1

1

M 1 m1

Критерий окончания xn1 xn

1 q

q

Пример.

x2 ex 0

f x 2 x e x

f 1 2 e 1 2.37

f 0 1

2

0.6

2.37 1

xn1 xn f xn xn 0.6 xn2 e xn

1.37

q

0.4 метод сходится.

3.37

xn1 xn

13 | С т р а н и ц а

Метод Ньютона (метод касательных).

f x 0

M 0 x0 , f x0

y x f xn f xn x xn

0 f xn f xn xn1 xn

Расчётная формула метода Ньютона:

xn 1 xn

f xn

f xn

y

x

a

x1

x0 b

Рис. 3. Метод Ньютона.

14 | С т р а н и ц а

Лекция № 4.

РЕШЕНИЕ НЕЛИНЕЙНЫХ УРАВНЕНИЙ.

Метод секущих.

Основывается также на замене произведения разностью отношений, z является

точкой итерационной последовательности.

xn1 xn

f xn xn1 xn

f xn1 f xn

Точки x0 и x1 называются стартовыми точками и выбираются любыми из области

локализации.

y

x

x2

x1

x3 x0

Рис. 1. Метод секущих.

Пусть x – простой корень уравнения, функция f x дважды непрерывно

дифференцируема и вторая производная в точке корня равна 0, тогда при

произвольном выборе начальных приближений x0 и x1 из окрестности корня

метод секущих с порядком p

1 5

1 5

1.68, xn1 x C xn x 2 .

2

Трудоёмкость метода секущих меньше трудоёмкости метода Ньютона.

Метод Стеффенсона.

z n z xn f xn является методом второго порядка точности p = 2.

Обусловленность задачи вычисления корня уравнения.

f x 0

x f

, – коэффициенты возрастания начальной погрешности.

Точность достигнута, если xn1 xn .

Определение 1.

Из-за вычислительной погрешности существует такой интервал, называемый

интервалом неопределённости корня, внутри которого невозможно определить,

15 | С т р а н и ц а

какое число является

неопределённости корня.

f x f x

f x x x

главный член погрешности

корнем.

Длина

интервала

называется

радиусом

f

x x 2

2!

f xn f x f x xn x f x f xn f x f xn M , f x 0

f xn

– радиус неопределённости корня.

r xn x

f x

Вывод:

1. Если x – простой корень, т. е. f x 0 , то задача хорошо обусловлена.

2. Если корень кратный, т. е. f x 0 , то задача становится плохо

обусловленной.

x – корень кратности m f x 0, f x 0, f x 0,..., f m1 x 0, f m x 0

f x

f m x x x

m 1

o x x

m!

m

Задача. Найти радиус неопределённости для кратного корня.

Алгоритм для нахождения кратного корня:

m 1, k1 число итераций

m 2, k 2

...

m кратность, min k

16 | С т р а н и ц а

Лекция № 5.

РЕШЕНИЕ СИСТЕМ ЛИНЕЙНЫХ

АЛГЕБРАИЧЕСКИХ УРАВНЕНИЙ (СЛАУ).

Вспомогательные сведения.

Основные задачи вычислительной математики:

1. Решение СЛАУ.

2. Нахождение собственных чисел и собственных векторов.

3. Обратная матрица.

4. Вычисление определителя.

Ax B

x корень

Amxm , det A 0

Постановка задачи о приближенном решении уравнения.

Ax b

x R m – точное решение (неизвестно).

Требуется найти вектор x * R m – приближенное решение с точностью

x1*

x1

*

x

x2

*

x

x 2

x

x*

m

m

.

x * , x * ?

x *

Определение 1.

Будем говорить, что в R m введена норма вектора, если x R m сопоставляется

число x , удовлетворяющее аксиомам:

x 0

1.

x 0 x 0

2. x x

3. x y x y

Наиболее употребительные нормы:

m

x 1 xi

i 1

xe

x

m

x

i 1

2

i

max xi

1i m

17 | С т р а н и ц а

Пример.

x 3,1,2

x1 6

x e 14

x

3

Определение 2.

Под погрешностями вектора будем понимать:

x * x * x

x

*

x* x

x

Справедливо следующее соотношение для норм векторов:

x x 1 x e m x , m – размерность пространства.

Пусть рассматривается последовательность приближений x 1 , x 2 , ... , x n , ... .

Будем говорить, что эта последовательность сходится к x по норме, если

x n x n x n

0 .

Всюду далее конкретизация нормы не существенна, т. к. сходимость одной влечёт

сходимость по остальным.

Определение 3.

Подчинённой нормой матрицы А называется число, определяемое A max

x0

Ax

x

.

m

A 1 max ai j

1 j m

i 1

m m

A e ai2 j

j 1 i 1

1/ 2

m

A max ai j

1i m

j 1

Пример.

10 0 5

A 3 1 0

0 2 7

A 1 max 13, 3, 12 13

A e 100 25 9 1 4 49 188

A max 15, 3, 9 15

Введённая таким образом норма удовлетворяет следующим аксиомам нормы

матрицы:

18 | С т р а н и ц а

A 0

1.

A 0 A 0

2. A A

3. A B A B

4. AB A B

A* A A*

A*

A*

A

Имеем систему Ax b, x ? Найти не сможем, т. к. искажена и A и b. Будем решать

A* x * b * .

Рассмотрим задачу о нахождении приближенного решения x * , выбрав евклидову

y

норму вектора x * .

x * x * x

x*

R2

x1*

x *

x2

x

x 1

x2

*

x

*

1

2

x1 x x2

*

2

2

x

x

0

Рис. 1.

x

*

1

2

x1 x2* x2

2

Обусловленность задачи решения СЛАУ.

Ax b

x1 10 x2 11

100 x1 1001x2 1101

1

x

1

11

b

1101

Ax* b*

x1 10 x2 11.1

100 x1 1001x2 1101

101.1

x*

9

11.1

b*

1101

Погрешность входного данного:

0.1

b*

bb

b

*

0

0.1

9 10 5 10 4 0.01%

11

1101

1101

100.1

x*

xx

x

*

10

1

1

100.1 10 4 %

19 | С т р а н и ц а

Теорема 1.

Пусть x – точное решение системы Ax b , x* – решение системы Ax* b* . Тогда

справедливы следующие оценки:

x* A1 b*

x* A A1 b*

Ax* Ax b* b x* x A1 b* b

x* x A1 b* b A1 b* b

b Ax b A x

b x* A1 b* A x

:b x

Определение 4.

Числом обусловленности матрицы А будем называть число cond A A A1 .

Если cond A 10 , то матрица называется плохо обусловленной.

Пример.

10

1

A

100 1001

1 1001 10

A1

1 100 1

cond i A A A1

1101 1011 106 10

Утверждение 1.

Пусть x – точное решение системы Ax b , x* – решение системы A* x* b . Тогда

справедлива оценка x* cond A A* .

Пусть x – точное решение системы Ax b , x* – решение системы A* x* b* . Тогда

справедлива оценка x* cond A A* b* .

Пример.

Решение системы методом Гаусса.

2 x1 2 x2 x3 6

4 x1 3x2 x3 11

6 x 3x x 9

2

3

1

a ведущий элемент

11

2 2 1 6 a / a

2 2 1 6 2 2

1

21

21

11

A 4 3

1 11 31 a31 / a11

0 1 3 1 0 1 3

0 9 2 9 0 0 25

6 3 1 9 a21j a2 j 21 a1 j

a 1 a a

3j

31

1j

3j

6

1

0

Обратный ход метода Гаусса:

x1 2

x2 1

x3 0

20 | С т р а н и ц а

Подсчитаем трудоёмкость метода Гаусса в общем случае.

a11 x1 a12 x2 ... a1m xm b1

a21 x1 a2 2 x2 ... a2 m xm b2

...

am x1 am x2 ... am xm bm

2

m

1

1 шаг метода Гаусса.

i1

ai1

, i 2,3,..., m

ai i

m 1

Число алгоритмический действий:

Делений

Умножений

m 1

m 22

m 1

m2

1

Вычитаний

m 12

m 22

2

1

Qm 1 2 ... m 1 2 1 2 2 32 ... m 1

mm 1 22m 1mm 1

2

m

m3

2

6

3

2

1

m1

1 m 1

m 1 2 k 2

2

k 1

21 | С т р а н и ц а

Лекция № 6.

РЕШЕНИЕ СЛАУ ПРЯМЫМИ МЕТОДАМИ.

Метод Гаусса и его модификации.

Схема единственного деления.

a11 x1 a12 x2 ... a1m xm b1

a21 x1 a2 2 x2 ... a2 m xm b2

...

am x1 am x2 ... am xm bm

2

m

1

1 шаг. Предполагаем, что a11 0 – ведущий элемент 1-ого шага.

i1

ai 1

a11

aij1 ai j i1ai j

bi1 bi i1b1

i 2,3...m, j 1,2...m

a11 x1 a12 x2 ... a1m xm b1

1

a22

x2 ... a21m xm b21

...

1

am12 x2 ... amm

xm bm1

k шаг. ak k 0 – ведущий элемент k-ого шага.

i k

aikk 1

akkk 1

aijk aijk 1 i k akjk 1

bik bik 1 i k bkk 1

i k 1...m, j k ...m

Выписываем (m-1) шаг метода Гаусса.

a11 x1 a12 x2 ... a1m xm b1

1

a22

x2 ... a21m xm b21

...

k 1

akkk 1 xk ... akm

xm bkk 1

...

m1

amm

xm bmm1

2 3

m арифметических действий.

3

Обратный ход.

bmm1

xm m1

amm

xk bkk 1

m

a

j k 1

k 1

kj

x j , k m 1...1

22 | С т р а н и ц а

Модификации метода Гаусса.

1. Схема частичного выбора метода Гаусса

(выбор максимального по модулю элемента по столбцу):

1 шаг. ai 1 – максимальный по модулю элемент 1-ого столбца.

1

Меняем местами строки i1 1.

k шаг. ai k – максимальный по модулю элемент k-ого столбца.

Меняем местами строки ik k .

Преимущества схемы:

1) Нет деления на ноль.

2) i k 1 – вычислительная устойчивость.

2. Метод полного выбора:

1 шаг. ai j – максимальный по модулю элемент всей матрицы.

k

1 1

Меняем местами строки и столбцы i1 1, j1 1, index j1 .

k шаг. ai j – максимальный по модулю элемент в подматрице порядка (m-k).

k

k

Меняем местами строки и столбцы ik k , jk k , index j1 , j2 ,..., jk .

LU-разложение или матричная форма метода Гаусса.

Обычно стоит такая задача:

Ax d 1 d 2 ... d N

Выбираем правые части.

Рассмотрим элементарные матрицы:

1

21

M 1 31

m1

0

1

0

0

0

0

1

0

0

0

0

1

1

0

Mk 0

0

0

0

1

0

0

0

0

0

0

0

0

0

0

1

k 1k

m k

0

0

0

0

1

Свойства элементарной матрицы:

1) det M i 1 i 1,2,..., m 1

m 1

2)

M

i

M нижняя треугольная.

i 1

3) Обратная матрица M i является той же матрицей, но с коэффициентами i k .

Найдём M 11 .

23 | С т р а н и ц а

1

21

31

m1

0

1

0

0

0

0

1

0

0

0

0

1

1

0

0

0

1

0

0 1

0 0

1 0

0

1

0

0

0

1

1

21

m1

0

1

0

0

0

1

Пояснение.

0 0 a11

1

21 1 0 a21

31 0 1 a31

a12

a2 2

a3 2

a13

a11

a12

a2 3 a21 21a11 a2 2 21a12

a33 a31 31a11 a3 2 31a12

a2 3 21a13

a33 31a13

a13

Матричная схема метода Гаусса:

M m1...M 2 M 1 A x M m1...M 2 M 1b

U upper

b m 1

M m1...M 2 M 1 A U A M m1...M 2 M 1 U M 11M 21...M m11U

1

L low

A LU

LUx b m

Ly b m

Ux y

0

1

1

21

L

m m

2

1

a11 a12

1

0 a22

U

0

0

0

0

0

0

m m1 1

a1m

a21m

m 1

amm

Пример.

9 x1 5 x2 3x3 8

81x1 50 x2 25 x3 56

45 x 55 x 7 x 44

2

3

1

5

3 9

5

3 9

5 3

9

A 81 50 25 9 5 2 9 5 2

45

55

7 5 30 8 5 6 4

0 0

5

3

1

9 5 3

9

L 9 1 0

U 0 5 2

LU 81 50 25

5 6 1

0 0 4

45

55

7

24 | С т р а н и ц а

Ly b

y1 8

y1 8

y2 16

9 y1 y2 56

5 y 6 y y 44 y 12

2

3

1

3

Ux y

9 x1 5 x2 3 x3 8 x1 1

5 x2 2 x3 16 x2 2

4 x 12

x 3

3

3

1

x 2

3

Метод Холецкого (метод квадратных корней).

Определение 1.

Матрица A называется положительно определённой, если Ax, x 0 x 0 .

Критерий Сильвестра 1 0, 2 0,..., m 0 .

Определение 2.

Матрица A называется симметричной, если A AT .

Достаточное условие положительной определённости в случае A AT : если

ai i ai j строковое диагональное преобладание, ai i 0 .

i j

Пусть A AT 0 .

a11

a2

A 1

a

m1

a1m

a2 2 a2 m

am 2 am m

l11 0 0 l11 l21

l

l

0

0 l2 2

2

22

L LT 1

l

m1 lm 2 lm m 0 0

a12

l m1

lm 2

lm m

l112 a11 l11 a11

l11l21 a21 l21

l11li1 ai1 li1

a21

l11

ai1

l11

25 | С т р а н и ц а

2

2

2

l21

l22

a2 2 l2 2 a2 2 l21

l21li1 l2 2li 2 ai 2 li 2

ai 2 l2 i li1

l2 2

k 1

lk k ak k lkj2

j 1

k 1

li k

ai k li j l j k

j 1

lk k

Число арифметических действий

1 3

m .

3

Пример.

l11 0

l21 l2 2

l

31 l3 2

0 l11 l21

0 0 l2 2

l33 0 0

l112 9 l11 3

l31 9 6 0

l3 2 6 20 28

l33 0 28 65

2

2

l21

l22

20 l2 2 4

l21l11 6 l21 2 l21l31 l2 2l3 2 28 l3 2 7

l31l11 0 l31 0 l312 l322 l332 65 l33 4

3 0 0

L 2 4 0

0 7 4

26 | С т р а н и ц а

Лекция № 7.

РЕШЕНИЕ СЛАУ.

Метод прогонки.

Определение 1.

Матрица разрежена, если содержит достаточное количество нулевых элементов.

I верхняя над диагональная

a11

a21

A a31

a

m1

a12

a2 2

a3 2

am 2

a13

a2 3

a33

am m1

a1m

a2 m

am1m

am m

I нижняя под диагональная

Трёх диагональная система уравнений.

b1 x1 c1 x2 0 ... 0 d1

a x b x c x ... d

2

2 1 2 2 2 3

...

ai xi 1 bi xi ci xi 1 d i

...

am xm1 bm xm d m

1 шаг.

x1

c1

d

x2 1

b1

b1

x1 1 x2 1

c1

1

коэффициен ты прогонки

d1

1

1

1 b1

1

2 шаг.

a2 1 x2 1 b2 x2 c2 x3 d 2

x2

c2

d 1 a 2

x3 2

b2 1a2

b2 1a2

x2 2 x3 2

3 шаг.

27 | С т р а н и ц а

xi i xi 1 i

i

i

ci

i

d i i 1ai

i

i bi i 1ai

Пример.

x1 2 x2 7

2 x 3 x x 9

1

2

3

4 x2 2 x3 3 x4 10

2 x3 4 x4 12

3

1 2 2 1 3 2

1 7 2 5 3 5

1 1

2 1 3 2

1 2 2 5

2

3

2 4

1

2

3

3

x

2

x3 2 5 2

2

2

x2 1 2 5 3

x4

x1 2 3 7 1

Теорема 1.

Достаточное условие применимости метода прогонки.

Пусть коэффициенты системы удовлетворяют следующим условиям:

bk ak ck

bk ak

Тогда k 0 , т. е. прогонка может быть доведена до конца и k 1 , т. е. прогонка

устойчива.

По индукции.

1) k 1

1 b1

2) k n 1

3) k n

n bn n1an bn n1 an bn an 0

Существуют различные способы прогонок:

1. Правая прогонка (классический способ).

xi i xi 1 i

2. Левая прогонка.

xi i xi 1 i

28 | С т р а н и ц а

3. Более сложные формулы.

Применение прямых методов для решения СЛАУ.

Am m x b

1. Метод частичного выбора (однократное вычисление системы).

2. Ax d 1 d 2 ... d N система с разными правыми частями.

A LU

3. Если нашли A1 , то решаем фактически LUx j e j .

m

4. det A, A LU , det L det U det U ui i

i 1

5. A A 0, A LL метод Холецкого.

6. A разреженная. Метод прогонки.

T

T

Метод простой итерации.

f x 0

x x , если x 1, иначе может не сойтись.

Ax b

x Bx C

a11 x1 a12 x2 ... a1m xm b1

a21 x1 a2 2 x2 ... a2 m xm b2

...

am x1 am x2 ... am xm bm

2

m

1

ai i 0

x1

a

a12

b

x2 ... 1m xm 1

a11

a11

a11

x2

a

a21

b

x1 ... 2 m xm 2

a2 2

a2 2

a2 2

...

xm

a

am1

b

x1 ... m m1 xm1 m

am m

am m

am m

x Bx C

0 b12

0

b2

B 1

b

m1 bm 2

bik j

ci

ai j

ai i

b1m

b2 m

0

, i 1,2,..., m, j 1,2,..., m, i j

bi

ai i

29 | С т р а н и ц а

Расчётные формулы:

x n 1 Bx n C

x 0 C

x 0 , x 1 , x 2 ,... x

Пример.

20 x1 5 x2 10 x3 20 x1 0.25 x2 0.5 x3 1

x2 0.25 x1 0.5 x3 2

2 x1 8 x2 4 x3 16

x x 5x 5

x 0.2 x 0.2 x 1

3

1

2

1 2

3

0.25 0.5

0

B 0.25

0

0.5

0.2 0.2

0

B

0.75 1

Покоординатная форма записи для МПИ:

x1n 1 0.25 x2n 0.5 x3n 1

n 1

n

n

x2 0.25 x2 0.5 x3 2

n 1

n

n

x3 0.2 x1 0.2 x2 1

x

x11 0.25 2 0.5 1 1

1

x2 0.25 1 0.5 1 2

1

x3 0.2 1 0.2 2 1

...

x

2

1.8375

2.1

1.05

x

3

0

1

2

1

2

x 1.75

0.8

1

2.05

1.9344

0.9475

x

4

2.02125

1.9777

0.9837

Теорема 2.

О достаточном условии сходимости МПИ.

Пусть рассматривается МПИ x n Bx n 1 C и пусть выполняется условие

q B 1 . Тогда МПИ сходится при любом начальном приближении и

справедливы оценки:

x n x q n x 0 x

x n x

Априорная

q

x n x n 1

1 q

Апостериорная

x – решение системы Ax b .

x Bx C

x n Bx n 1 C

x n x B x n 1 x B x n 1 x ... B x 0 x

n

q B 1, q n n

0 x n x n

0

30 | С т р а н и ц а

x n x B x n 1 x n x n x B x n x n 1 B x n x

1 B x x

n

B x n x n 1

Следствие.

Критерий окончания МПИ:

x n x n 1

1 q

q

, где – заданная точность.

Существуют две формы записи МПИ:

1. Матричная форма.

x n 1 Bx n C

2. Покоординатная форма.

m

xin 1 Bi j xjn Ci i 1,2,..., m

j 1

Если матрица B обладает свойством диагонального преобладания Bi i Bi j , то

i j

можно доказать, что B 1 .

Иногда диагональное преобладание можно получить, переставляя строки в

исходной системе уравнений.

31 | С т р а н и ц а

Лекция № 8.

РЕАЛИЗАЦИЯ МПИ НА MathCAD.

Ax b

x n1 Bx n C

a11 x1 a12 x2 ... a1m xm b1

a21 x1 a2 2 x2 ... a2 m xm b2

...

am x1 am x2 ... am xm bm

2

m

1

Алгоритм:

1. A, b

2. Bi j

Ai j

Ai i

, i j; Bi j 0, i j; Ci

3. x 0 C, y Bx C

yx

1 B

bi

i, j 1,2,..., m

Ai i

B

Вычисление по МПИ с заданной точностью .

ORIGIN : 1

20 5 10

A : 2 8 4

1 1 5

x : lsolve A, b

2

x 2

1

20

b : 16

5

m rows A

for i 1..m

for j 1..m

PS A, b :

RBi , j

Ai , j

Ai ,i

RBi , j 0 if i j

RC i

bi

Ai ,i

RB

RC

32 | С т р а н и ц а

3,3

PS A, b

3

,

1

B : PS A, b 1

C : PS A, b 2

0.25 0.5

0

B 0.25

0

0 .5

0.2 0.2

0

1

C 2

1

norm1B 1

normeB 0.84

normiB 0.75

C 2.45

m rows C

q normeB

y x0

x y 10

k 0

MSI B, C , x0, : while x y

1 q

q

x y

y Bx C

k k 1

y

k

3,1

MSI B, C , C ,10 2

13

2.0000396

MSI B, C , C ,10 2 1 1.9999603

0.99997

33 | С т р а н и ц а

Методы Зейделя и релаксации.

Ax b x Bx C

Покоординатная форма записи метода Зейделя.

x1n1 b12 x2n b13 x3n ... b1m xmn c1

n1

n1

n

n

x2 b21 x1 b2 3 x3 ... b2 m xm c2

...

x n1 b x n1 b x n1 ... b x n1 c

m1 1

m2 2

mm m

m

m

Матричная форма записи метода Зейделя.

B B1 B2

0

0

0

b2

B1 1

b

m1 bm 2

0

0

0

0 b12

0 0

B1

0 0

b1m

b2 m

0

x n1 B1 x n1 B2 x n C

Достаточное условие сходимости МПИ B 1 .

Достаточное условие сходимости МЗ B1 B2 1 .

Теорема 1.

Пусть рассматривается метод Зейделя x n1 B1 x n1 B2 x n C . Тогда если

B1 B2 1 , то метод Зейделя сходится при любом начальном приближении и

справедливы следующие оценки:

x n x q n x 0 x , q

x n x

B2

1 B1

Априорная

B2

x n x n1

1 B

Апостериорная

Ax b x Bx C

x B1 x B2 x C

x n B1 x n B2 x n1 C

x n x B1 x n x B2 x n1 x B1 x n x B2 x n1 x n x n x B x n x B2 x n1 x n

x n x B x n x B2 x n1 x n x n x

x n x B1 x n x B2 x n1 x x n x

B2

x n1 x n

1 B

B2

B2

x n1 x , q

1 B1

1 B1

x n x q n x 0 x , q 1

B2

1 B1

1 B1 B2 1

34 | С т р а н и ц а

Следствие 1.

Метод Зейделя сходится со скоростью геометрической прогрессии.

Следствие 2.

Критерий окончания x n x n1

1 B

B2

.

Геометрическая интерпретация метода Зейделя.

a11 x1 a12 x2 b1

a21 x1 a2 2 x2 b2

x1n B12 x2n1 C1

y

l1

l2

x

x2n B21 x1n C2

l1

x

Замечание.

Метод Зейделя может зациклиться.

0

l2

Рис. 1. Геометрическая интерпретация

метода Зейделя.

SOR метод (верхней релаксации).

y

~

x n1 B1 x n1 B2 x n C

x n1 ~

x n1 1 ~

x n1 x n , 0,2

i 0 i

x

{

x

0

Рис. 2. Геометрическая интерпретация

метода верхней релаксации.

Каноническая форма записи итерационных методов.

Определение 1.

Канонической формой итерационного метода общего вида называется:

Bn1

x n1 x n

n1

Ax n b

Если Bn1 E , то метод называется неявным, иначе – явным.

Если Bn1 , n1 зависят от номера итерации, то метод называется итерационным,

иначе – стационарным.

B – итерационная матрица.

35 | С т р а н и ц а

– итерационный параметр.

x n1 x n

Ax b

Axn b

Вектор погрешности z n x n x

x n x n1

xx

Ax n1 b

Ax b

x n x x n1 x

Ax n1 x 0

Вектор ошибки удовлетворяет уравнению

z

n

z

n1

Az

n1

E Az

n1

z n z n1

Az n1 0

Определение 2.

S E A называется матрицей перехода от вектора погрешности от z n1 к z n для

МПИ z n Sz n1 .

Теорема 2.

Если все собственные числа i матрицы S i 1 i , то метод итерационно

сходится при любом начальном приближении.

1) Необходимость

S 1

x 0 x y S , y S собственный вектор отвечающий S

z1 Sz 0

z 0 x 0 x y S

z 1 Sy S S y S

z n S n z 0 nS y S

z n nS y S S

n

y S

S 1

2) Достаточность

Предположим дополнительно, что S имеет собственные векторы, образующие

собственный базис.

z

0

m

ck y k

k 1

m

z n S n z 0 ck nk yk

k 1

z

n

max S z 0

nk S 0

n

k

z n 0

36 | С т р а н и ц а

Лекция № 9.

ИТЕРАЦИОННЫЕ МЕТОДЫ

ДЛЯ ПОЛОЖИТЕЛЬНО ОПРЕДЕЛЁННЫХ МАТРИЦ.

Итерационные методы в канонической форме.

Ax b

B

z

n

B

z

x n1 x n

Ax n b

x n x вектор погрешности n ой итерации.

z n1 z n

n 1

Az n 0

E B 1 A z n

S E B 1 A матрица перехода от z n к z n1.

i S 1

A AT 0 A 0 x 0 Ax, x 0

Критерий Сильвестра:

1 0, 2 0,..., m 0

ai i ai j

i j

Запишем наиболее распространённые методы в канонической форме:

1. Метод Якоби.

D x n1 x n Ax n b

B D итерационная матрица

D diag A

A A1 D A2

Ax b

Dx A1 A2 x b

x D 1 A1 A2 x D 1b

x n1 Bx n C

B D 1 A1 A2

C D 1b

1

1

1

D 1 diag ,

,...,

am m

a11 a2 2

2. Метод релаксации.

D A1

x n1 x n

Axn b

– параметр, берётся всегда положительным.

3. Метод Зейделя 1 .

B D A1

37 | С т р а н и ц а

Условия сходимости итерационных методов

для симметричных, положительно определённых матриц.

Теорема 1.

Пусть A AT 0, B

x n1 x n

Ax n b и B 0.5A 0 . Тогда итерационный метод

5

сходится при любом начальном приближении.

0 .

Докажем, что z n

n

z n1 Sz n

B

xx

Ax 1

n1

n

x

Ax n b

5

n1

z

z n

B

Az n 0

B

z

x

n1

B

x

n 1

x x n x

Ax x 0

n

E B 1 A z n

S

Рассмотрим числовую последовательность J n Az n , z n 0 z n 0 . Докажем,

что J n убывает.

J n1 J n J lim J n

n

n 1

AE B Az , E B Az

Az , z AB Az , z Az , B Az AB

n

n

J n1 Az

,z

n 1

1

1

n

1

n

n

обозн.

Az n , B 1 Az n y B 1 Az n

J n 2 Az n Ay n , y n J n 2 B A y n , y n

2

A

n

J n 2 Az n , y n 2 Ay n , y n

n

1

n

2

1

0

J n1 J n

min S z Sz , z max S z , S 0

2

2

J n1 2 Sz n , z n J n

lim Sz n , z n 0 z n x n x

0

n

n

Следствие 1.

Пусть матрица A обладает свойством диагонального преобладания, т. е.

ai i ai j . Тогда метод Якоби сходится при любом начальном приближении.

i j

2ai i ai j ai i

i j

BD

1

38 | С т р а н и ц а

D 0.5 A 0 Ax, x 2Dx , x x 0

Ax, x ai j xi x j ab 1 a 2 b 2 1 ai j xi2 x 2j ai j xi2 Dx, x ai i xi2

m

m

m

i 1 j 1

2

2

m

m

i 1 j 1

m

i 1 j 1

m

i 1

m

m

ai i ai j xi2 2ai i xi2 2Dx , x

i 1

j 1

i 1

i j

Ax, x 2Dx, x метод сходится .

m

Следствие 2.

Если A AT 0 , то метод релаксации 0,2 и, в частности метод Зейделя 1 ,

сходится при любом начальном приближении.

B D A1 ,

0 0 a12

0 0 0

0

0 am m 0 0

am 2

B 0.5A D A1 0.5 A1 D A2 1 0.5 D 0.5A1 0.5A2

0

a2

A A1 D A2 1

a

m1

0

0 a11

0 0

0 0

0

a2 2

a1m

a2 m T

, A1 A2

0

Ax, x A1 D A2 x, x A1 x, x Dx , x A2 x, x x, A2 x Dx , x A2 x, x Dx , x 2 A2 x, x 0

B 0.5Ax, x 1 0.5 Dx, x 0.5 Ax, x 0.5 A2x,

x 1 0.5 Dx , x 0

x , A2 x

x , A1x

D0

1 0.5 0

0,2

Утверждение 1.

Пусть A AT 0 и A min , max – спектр матрицы. Тогда метод простой

итерации

x n1 x n

Ax n b

сходится при

min

2

max

и любом начальном

приближении.

Пусть i S 1, тогда метод сходится при любом начальном приближении.

S E A

обозн.

Если i S – собственные числа A, то i S 1 i A i .

Если i A, xi – собственный вектор.

Sxi i xi

Sxi 1 i Axi

S E Axi xi i Axi

1 A 1

39 | С т р а н и ц а

1 , min , max

max g

min ,max

1 min max 1

min

g

1

2

опт

max

0

1 / max

1 / min

1. опт минимальная погрешность метода;

2. опт метод сходится.

Замечание.

В МПИ необходимым и достаточным условием выбора параметра является

1 0 min , max .

40 | С т р а н и ц а

Лекция № 10.

ИТЕРАЦИОННЫЙ ПРОЦЕСС

С ЧЕБЫШЕВСКИМ НАБОРОМ ПАРАМЕТРОВ.

Многочлены Чебышёва.

Имели дело больше со стационарными процессами:

x n1 x n

n1

Ax n b

Многочлены Чебышёва определяются:

0 x 1

1 x x

2 x 2 x 2 1

3 x 4 x 3 3x

n1 x 2 x n x n1 x

Свойство 1.

2 n x – чётная функция.

2 n1 x – нечётная функция.

Свойство 2.

n x cosn arccos x

cosm 1 cosm 1 2 cos m cos , arccos x

Свойство 3.

n x an x n ...

an 2 n1

Свойство 4.

Нули многочленов на 1;1 :

cosn arccos x 0

k

2

0 arccos x k 0,1,..., n 1

n arccos x

arccos x

1 2k

2n

, k 0,1,..., n 1

Свойство 5.

Экстремумы многочлена Чебышева.

n x sin n arccos x

n

1 x2

0

41 | С т р а н и ц а

n arccos x k , k Z

k

x cos , k 0,1,..., n

n

Графики монотонны:

y

1

y

3 x

x

x

-1

3

2

1

1

-1

0

1

2 x

-1

Рассмотрим нормировку:

Tn x 21n Tn x : Tn x an 1

Теорема 1.

Среди всех многочленов степени n со старшим коэффициентом an 1 наименее

уклоняющимся от нуля является многочлен Tn x , т. е.

max Pn x max Tn x 21n

1,1

1,1

Pn x произвольный, an 1.

an1 x Tn x Pn x

Предположим, что Tn x не удовлетворяет условиям теоремы.

Рассмотрим точки экстремума Tn x .

Tn xk Pn xk будет совпадать с максимальным значением Tn xk .

sign Tn x Pn xk sign Tn xk

Точек экстремума Qn1 x n 1 Qn1 x должно быть n корней.

Это противоречит основной теореме Гаусса.

Утверждение 1.

Пусть A AT 0 , тогда в качестве A 2 max A .

опр.

A max

xe

Ax

x

n

x, x xi2

i 1

42 | С т р а н и ц а

n

x xi ei

i 1

n

n

Ax Axi ei xi i ei

i 1

i 1

n

x

max

x0

2

i i

max

1/ 2

2

xi

i 1

Равенство достигается, если x eS max .

A

i 1

n

Утверждение 2.

cond 2 A

max

min

cond2 A A 2 A1 2

A Q T Q

QT Q 1

1

1

A1 QT Q Q 11 QT QT 1Q

1

A1

– максимальное собственное число.

2

min

Вспомогательная задача.

f 1 1 1 2 ...1 n многочлен степени n.

f 0 1

Корни k

1

0

max f Tn x, x min , max , Tn 0 1

Далее будем обозначать Tn t cosn arccos t , t 1,1.

1,1 a, b x a b b a t ,

2

t

2

t 1,1

2

ab

x

ba

2

2

a b

Tn x cos n arccos

x

2

ba

22 n 1

2

b a n

ba

n

an 2

n 1

max Tn x

a , b

22 n 1

b a n

43 | С т р а н и ц а

2

x a b 2

cos n arccos

ba

1n q cos n arccos 2 x a b

Tn x

n

ba

2

a b

cos n arccos

b a

2 1n

b a

qn

, 1

2n

1 1

b a

2

a b

n

Tn x 1 qn cos n arccos

x

ba

2

ab ba

xk

tk

2

2

2k 1

tk cos

, k 0,1,..., n 1

2n

Чебышёвский процесс для вычисления решения системы.

x n 1 x n

Axn b

n 1

z

n 1

z n

n 1

z

Az n 0

E n 1 AE n Az n 1 ... E n 1 AE n Az n 1...E 1 Az 0

n 1

S n : z n S n z 0 , S n E n AE n 1 A...E 1 A

k A k k S E nk E n 1k ...E 1k

z n S n

2

2

z 0 , min S n

2

min max k

Для решения задачи минимакса примем в качестве параметра k множество нулей

многочлена Чебышева на отрезке min , max . Воспользуемся многочленом Tn x ,

обладающим свойством Tn 0 1 и построим этот многочлен.

2

max

n

Tn x qn 1 cos n arccos

x min

max min

2

qn

max min

2 1n

, 1

2n

1 1

max min

Теорема 2.

Пусть A AT 0 , тогда рассматривая итерационный процесс следует выбрать

итерационный параметр следующим образом:

0

2

max

min

0

k

1 tk

tk cos

2k 1 ,

2n

k 1,2,..., n

При этом если число итераций n фиксировано, то достигается минимум:

44 | С т р а н и ц а

min x n x qn x 0 x

q n – определено выше.

Замечание.

Особенность многочлена Чебышева в том, что фиксируется число итераций

заранее и k : 0 ,1,..., k .

Замечание.

Так как при построении итерационных процессов x n x , то выбор числа

итераций

2 1n

.

2 1n , n ln

2n

1 1

2 1

Замечание.

x n x n 1

x n – решение с заданной точностью. Число n удваивают (в этом случае)

не

производят вычисление ещё раз.

Замечание.

Существуют такие наборы, как, например, J k 1,3,5,7,2,4,... , которые обеспечивают

устойчивость итерационных процессов.

45 | С т р а н и ц а

Лекция № 11.

ИССЛЕДОВАНИЕ СКОРОСТИ СХОДИМОСТИ

ИТЕРАЦИОННЫХ МЕТОДОВ.

Основные определения.

A AT 0

A 2 max

cond 2 A

max

min

Ax b

– малое число, а 1 – достаточно большое число.

1 – число раз, в которое требуется уменьшить исходную погрешность.

x 0 x

1 x n x x 0 x

n

x x

Итерационные метод сходятся с геометрической скоростью сходимости.

x n x q n x 0 x , q n , q 0;1

1

n

ln

1

1

n – оценка числа итераций.

1

q

ln

q

Определение 1.

1

q

Скоростью сходимости итерационного метода называется величина ln , q S ,

S – матрица перехода.

Пример.

1) q 0.1 10 1 , 10 3 , q

ln 103

3

ln 10

ln 10 3

65

2) q 0.9, n

1

ln

0.9

Метод простой итерации с оптимальным выбором параметра.

A AT 0

min , max

x k 1 x k

Ax k b

S E A

S

2

1

46 | С т р а н и ц а

опт

max

1

cond 2 A 1

2

min

1

max

cond 2 A 1

1 cond 2 A 1

min

max min

max min

q

ln

n

ln

ln

min

2

max

1

Рис. 1. МПИ, оптимальный выбор

параметра.

1

q

1

2

2

ln q ln 1

q

cond 2 A 1 cond 2 A

1 1

ln cond 2 A

2

n

Чебышевский процесс.

x k 1 x k

Axk b

k 1

0

k

0

1 q0tk

max

2

min

q0

max min

max min

2k 1

tk cos

, k 1,2,..., n

2n

x n x

2

2

1 2n

n

min

max

x 0 x ,

2

min

1

max

1

Так как 1 , то 1 2 n при достаточно больших n стремится к 1. Для оценки

числа итераций будем использовать:

2 n n

n

ln

ln

2

2

2

ln ln 1

cond 2 A 1

cond 2 A 1

1

2

1 cond 2 A

2

2

ln ln 1

cond 2 A

1 cond 2 A

1 2

n ln

cond 2 A

2

ln

1

47 | С т р а н и ц а

Пример.

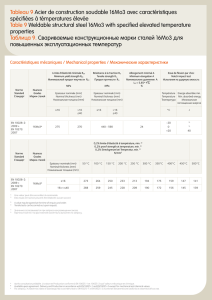

20 9 8 7 6

1

9 21 2 19 18

2

A 8 2 20 9 8

x 5

7 19 9 25 14

1

6 18 8 14 50

2

Метод Якоби.

37

40

Ax 97 b

11

76

x Bx C , B 1

Метод разойдётся, так как матрица не обладает свойством диагонального

преобладания.

МПИ с оптимальным выбором параметра.

74.68

1.04

eigenvals A 27.31

13.48

19.49

min 1.04

max 74.68

Если спектр (разброс) большой, то матрица плохо обусловлена.

2

0.026411

74.68 1.04

BP : identity 5 A

norm 2BP 0.97

y BP x

x k 1 E Ax k b

BP

n 247 для 10 3

Метод Зейделя.

y B1 y B2 x C создаётся за 66 итераций.

Метод с Чебышёвский набором параметров.

Оценим сначала число итераций.

48 | С т р а н и ц а

min

max

n ,

0.79

1

min

ln

1

max

1

2

ln

n 32.055, N 33

Недостатком данного метода является то, что необходимо знать собственные

числа матрицы.

Другие итерационные методы.

Неявный итерационный процесс.

B

x k 1 x k

Bx

Axk b, опт

k 1

Bx k Axk b

Bx k 1 C k

В неявных методах матрица B называется предобусловливателем.

Метод минимальных невязок.

x k 1 x k

Axk b

k 1

Определение 1.

0 .

Невязкой называется вектор r k Axk b, r k k

Метод минимальных невязок состоит в том, что параметр k 1 выбирается из

условия min r k 1 при фиксированной норме невязки r k .

r k 1 Ax k 1 b

Ax k 1 b Ax k k 1 Ar k b

x k 1 x k Ax k b k 1

rk

Ax

k 1

b Ax k k 1 Ar k b

r k 1 r k k 1 Ar k

r k 1 r k 1 , r k 1 r k k 1 Ar k , r k rk 1 Ar k r k , r k 2 k 1 Ar k , r k k21 Ar k , Ar k g k 1

2

Условие экстремума g 0 .

2 k 1 Ar k

k 1

2

2 Ar k , r k 0

Ar , r

k

k

Ar k

2

49 | С т р а н и ц а

Теорема 1.

A AT 0

A x n x

2

p0n A x 0 x , p0

1

A

, min

1

max A

Метод минимальных поправок.

k 1 k

B

A k b

k 1

k 1

A ,

, A

k

k

k

k

k : B k A k

x k B 1 k – поправка.

50 | С т р а н и ц а

Лекция № 12.

ЧАСТИЧНАЯ ПРОБЛЕМА СОБСТВЕННЫХ ЗНАЧЕНИЙ.

Вспомогательные сведения.

x0

: Ax x, A AT

P 1 AP D

P – матрица перехода от исходного базиса к базису из собственных векторов.

Утверждение 1.

Пусть 1 и 2 – различные собственные числа, e1 и e2 – собственные вектора и

матрица A самосопряженная A AT . Тогда e1 e2 .

Ae1, e2 1 e1, e2

Ae1, e2 e1 , AT e2 e1 , Ae2 2 e1, e2

1 e1 , e2 2 e1 , e2

e1 e2

1 2

Пример.

6 2 2

A 2 5 0

2 0 7

6

det A E

2

2

2

2

5

0 6 5 7 45 47 6 27 12 2 0

0

7

1 9 2 3 3 6

A E x 0

3x1 2 x2 2 x3 0

2 x1 4 x2 0

2 x 2 x 0

3

1

1

x2 x1

2

x3 x1

3x1 x1 2 x1 0

c1

2 / 3

1

e1 c1 e1 1 / 3

2

2 / 3

c

1`

51 | С т р а н и ц а

20 20 0 0

0 19 20 0

A 0 0 18 0

0 0 0 1

1 20, 2 19, ..., 20 1

P20 20 21019 ...

210

* 210 2 23

*

1* 1, *2 2, *3 8.9,..., 10

,11 6 18%

Собственные числа растут и, вообще говоря, задача поиска собственных чисел

большая проблема.

P 0

Исчерпывание корней.

Находим хотя бы один корень, делим P / 1 и опять применяем этот метод.

A U T Y

QR-алгоритм.

Рассмотрим матрицу:

a11

a2

A 1

a

m1

a12

a2 2

am 2

a1m

a2 m

am m

ri ai j

j i

Обозначим через Si круг на комплексной плоскости с центром в точке ai i .

Определение 1.

Кругом Гержгорина называется множество комплексной плоскости z ai i r1 .

6 2 2

A 2 5 0

2 0 7

r1 4 r2 2 r3 2

Теорема 1.

Любые собственные значения матрицы A находятся в объединении кругов

Гержгорина.

xi – максимальная координата собственного вектора.

52 | С т р а н и ц а

Ax x

ai i xi ai j x j

i j

xj

xi

1

ai i ai j

i j

xj

xi i

ri

Следствие 1.

Если круг Гержгорина изолирован, то в нём находится одно собственное

значение.

Следствие 2.

Если k кругов образуют замкнутую область, то там ровно k собственных значений

матрицы A.

A AT 0

Ax, x

x

x, x

min max

Для простоты пусть A – матрица простой структуры и пусть все собственные

значения различны.

A AT 0

i – максимальное собственное значение.

Степенным методом называется метод (итерационный):

x k Ax k 1

k

x , x

x

k

k

k 1

, x k 1

k 1

Теорема 2.

Пусть A – матрица простой структуры и пусть x 0 c1e1 c2e2 ... cn en , c1 0. e –

базис из собственных векторов. Тогда k k

1 и справедлива оценка:

1

k

1k 1

1

C

2

1

Докажем только сходимость.

x k Axk 1

x k Ak x 0

Ak ei k ei

x k Ak c1e1 ... cn en c11k e1 ... cn kn en

53 | С т р а н и ц а

z k

1k

x k

1k

c1e1 c2

z ,

kn

k2

e

...

c

n k en

1k 2

1

k k

k 1 k 1

1

1

k 1 k 1

k 1 k 1

1

1

z

z

, z

1

z , z

z , z

k

k 1

k 1

k 1

Модификация:

y k Axk 1

k y k , x k 1

x k

y k

y k

Пример.

6 2 2

2/3

A 2 5 0 C 1 / 3 max 9

2

1/ 3

0 7

0

0

x 1

0

x 0 1

1

y Ax

0

2

5

0

1 y 0 , x 0 5

2

y 1

1

x

5

29

29

0

y 2 Ax 1 ...

2 6.57

1

3 7.55

...

10 8.992

54 | С т р а н и ц а

Лекция № 13.

РЕШЕНИЕ НЕЛИНЕЙНЫХ СИСТЕМ УРАВНЕНИЙ.

Постановка задачи.

f1 x1 , x2 ,..., xn 0

f x , x ,..., x 0

2 1 2

n

...

f m x1 , x2 ,..., xn 0

Введём x x1, x2 ,..., xn T

f1 x

f 2 x

F

f x

m

F x 0, x R m

Найти x n приближение к x – точное решение, такое что x n x .

Выделяют два этапа:

1. Локализация корней.

2. Нахождение корня с заданной точностью.

Метод простой итерации (метод Якоби).

F x 0 x x

x n 1 x n

x 0 , x 1 , x 2 ,..., x k

Пример.

x 2 y 0.5

2

x

1

0

.

5

y

x

x 2 2 x y 0.5 0

2

2

x

2

2

2

x 4 y 4 0

y 1

y 4 x

2

2

Система для итераций.

n 1 x n 2 y n 0.5

x

2

2

n 1

4 x n

y

2

0

x 0 x 0.222 0.001

0

y 1

y 0.993 0.001

x 0 2

0 Процесс разойдётся

y 0

55 | С т р а н и ц а

Теорема 1.

Пусть в некоторой окрестности корня x выполнены условия x q 1 . Тогда

МПИ сходится при любом начальном приближении и справедлива оценка:

x n x q n x 0 x

Следствие 1.

Критерий окончания x n x n 1

1 q

q

.

Для рассматриваемого примера.

x 2 y 0.5

2

x, y

2

4 x

2

1

x

x, y

2

x

1

x

y

2 x

y 2 4 x 2

1

2 Матрица Якоби

0

1) M 1 1

2) M 2 2.5 1

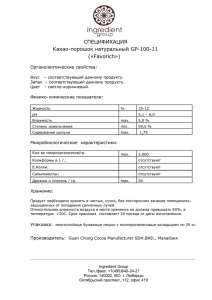

Реализация решения на MathCAD.

f 1 x1, x 2 : x12 2 x1 x 2 0.5

f 2 x1, x 2 : x12 4 x 22 4

g1 x1 : x12 2 x 2 0.5

g 2 x1 :

4 x12

2

x1 : 0

x 2 : 1

TOL : 10 6

Given

f 1 x1, x 2 0

f 2 x1, x 2 0

0.222215

xr1

0

.

993808

xr1 : Find x1, x 2

x1 : 2 x 2 : 0.5

1.900677

xr2

0.311219

56 | С т р а н и ц а

Итерационные методы для решения систем нелинейных уравнений.

Метод Ньютона.

f x 0

xn 1 xn

f xn

f xn

f Ai xi

i

f x dx f x0 df x0 ...

x n x1n , x2n ,..., xmn

m

f1 x n

n

f

x

f

x

x j x jn 0

1

1

x

j 1

j

m

f 2 x n

n

x j x jn 0

f 2 x f 2 x

x j

j 1

...

m

f m x n

n

x j x jn 0

f m x f m x

x j

j 1

f1

f1

xm

x1

f

f m

f m

x x

m

1

n

f x F x f x f x n x x n 0

x n 1

x f x f x

n

n

1

n

Пример.

x1 x22 0.5 0

x2 x12 0.5 0

x x 2 0. 5

f x 1 22

x2 x1 0.5

2 x2

1

f x

1

2 x1

1 2 x2

f x 1 1

1 4 x1 x2 2 x1 1

2

x1n 1 x1n

1

2 x2n x1n x2n 0.5

1

n 1 n

2

n n

n

x

1 x2n x1n 0.5

2 x2 1 4 x1 x2 2 x1

x n x n 1

57 | С т р а н и ц а

В силу громоздкости вычислений чаще используется упрощенный метод

Ньютона.

Ax x f x

A f x 0

n

n

x n 1 x n 1 x n

Ax n 1 f x n

A LU

LUx n 1 f x n

n 1

x

x n x n 1

Нелинейный метод Якоби.

Решаем уравнение как скалярное относительно x1 .

f x , x

0

f1 x1n 1 , x2n ,..., xmn 0

n

2

...

1

n 1

2

n

,..., xm

f m x1n , x2n ,..., xmn 1 0

Метод Зейделя (нелинейный).

Модификация нелинейного метода Якоби.

Метод простой итерации в канонической форме.

xn 1 xn

f xn 0 x n 1 x n f x n

xn 1 x n

Метод Ньютона-Зейделя.

f x x x f x

СЛАУ : f x x f x x f x

f xn xn 1 xn f xn

n

n

n

n

n

n

n

b

Ax b

xn 1 xn

f xn xn b

58 | С т р а н и ц а

Метод Пикара.

Пример.

2 x 4 y x3 sin xy 3 0

x 8 y cos x e xy 2 0

f x Ax G x

x3 sin xy 3

2 4

G x

A

xy

1 8

cos x e 2

Axn 1 G x n

Получили СЛАУ с одной и той же матрицей A и разными правыми частями на

каждой n-ой итерации.

59 | С т р а н и ц а

Лекция № 14.

РЕШЕНИЕ ПЕРЕОПРЕДЕЛЁННЫХ СИСТЕМ.

Линейная задача.

Переопределённая система – число уравнений больше числа неизвестных.

A x b, n m

n m

i kxi b f i

1 n 2

i min

n i 1

a11 x1 a12 x2 ... a1m xm b1

a21 x1 a2 2 x2 ... a2 m xm b2

...

an x1 an x2 ... an xm bn

2

m

1

rankA min m, n

nm

Определение 1.

Будем называть A матрицей полного столбцевого ранга, если rankA m .

Ax 0 A – матрица полного столбцевого ранга, x 0 – единственное решение.

Определение 2.

Будем называть вектором невязки r Ax b .

x – решение системы, в общем случае не существует.

Понимаем под решением задачи вектор x : min Ax b e .

x 0

Теорема 1.

Решением задачи является вектор x , удовлетворяющий системе уравнений

AT Ax AT b .

Ax b Ax b, Ax b

2

Ax b Ax Ax Ax b Ax b Ax x

Ax b Ax b Ax x , Ax b Ax x Ax b, Ax b Ax x , Ax b Ax x , Ax x

2

Ax b Ax x 2 AT Ax b , x x

2

2

Если x – решение системы AT Ax AT b , то x – точка min r e .

2

60 | С т р а н и ц а

Пример.

2 x1 x2 x3 1

4 x x x 5

1 2 3

3 x1 x2 x3 3

x1 5 x2 x3 1

2 1 1

4 1 1

A

3 1 1

1 5 1

rang A 3

2 1 1

30 8 2

2 4 3 1

4

1

1

AT A 1 1 1 5

8 28 4

1 1 1 1 3 1 1 2 4 4

1 5 1

T

AT A AT A 0

32

A b 8

0

T

AT Ax AT b

1.636

0.636

5.030

0.03

Ax

r Ax b

2.606

0.394

0.788

0.212

Ax b e 0.778

1.091

x 0.061

0.606

Докажем, что AT A – симметричная и положительно определена.

AT A AT AT AT A

T

A

T

T

Ax, x Ax, Ax Ax 0

2

Утверждение 1.

AT Ax AT b для матриц полного столбцевого ранга имеет единственное решение.

AT A 0 AT A

1

61 | С т р а н и ц а

Нелинейная задача метода наименьших квадратов.

f1 x1 , x2 ,..., xm 0

f x , x ,..., x 0

2 1 2

m

f x 0

...

f n x1 , x2 ,..., xm 0

f1

f

f 2

f

m

Сведём к линейной задаче, выполнив линеаризацию по Ньютону:

f x f x k f x k x x k

f1

x1

f x

f n

x

1

k 1

x

: f x k

f1

xm

f n

xm

k 1

k

x

x f x k

k 1

Критерий окончания x x k

Вводится вектор поправки:

k 1 xk 1 xk

f xk k 1 f xk

Алгоритм решения:

Найдена xk . Вычисляем f xk .

f x f x

f xk f xk

Получаем k 1 xk 1 k 1 xk .

k 1 xk 1 решение системы.

T

k

T

k 1

k

Упрощённый метод Ньютона.

A f x 0

A A A 0

k 1

A A

T

B AT

Af x k

T

T

Пример.

f1 x, y x 2 y 2 2 0

f 2 x, y xy 1 0

f 3 x, y x y 0

M 1 1,1 M 2 1,1

x2 y2 2

f xy 1

x y

f 0

2x 2 y

f y

x

1 1

f x k k 1 f x k

62 | С т р а н и ц а

0 .5

x 0

0 .5

1

1

A f x 0 . 5 0 .5

1 1

1 .5

0

0

b f x 0.75

0

0

0

A

0 T

A0 1 A0 b0

T

0.75

1

0.75

1.25

x 1 1 x 0

1.25

...

1.025

x 2

1.025

1

x 3

1

Постановка задачи минимизации функций.

f x , x R

Необходимое условие экстремума f x 0 .

Определение 3.

Методы, использующие производные, называются градиентными.

Определение 4.

f x называется унимодальной на a, b , если существует x , для которого

выполняются условия:

1. x1 x f x1 f x

2. x2 x f x2 f x

Определение 5.

Точка x – точка локального минимума, если в определении точки выполняется

условие f x f x .

Метод биекции поиска точки минимума.

с

ab

, параметр бисекции .

2

63 | С т р а н и ц а

a

с

с

с

b

Утверждение 2.

Пусть внутри a, b и : a b . Если f a f b, то берём отрезок , b,

иначе a, .

Алгоритм метода биекции аналогичен методу половинного деления с выбором

параметра итерационного процесса .

2

64 | С т р а н и ц а

Лекция № 15.

МЕТОДЫ МИНИМИЗАЦИИ.

Методы поиска.

Утверждение 1.

Сужение отрезка унимодальных функций.

Если f f , a b , то x a, , в противном случае x , b .

Пассивный поиск.

xi a hi i

Если hi h const , то оптимальный поиск x k x h .

Метод биекции.

k ый шаг a k , b k

a k b k

2

a k bk

k

2

k

Применяем утверждение о сужении отрезка.

ak 1, bk 1 ak , k ,

Если

то

f k f k ,

ak 1, bk 1 k , bk .

в

противном

случае

Теорема 1.

Пусть f x – унимодальная на a, b и b a . Тогда справедлива оценка

k

2

2 .

2k

Доказывается методом индукции.

k k

2

Метод золотого сечения.

Определение 1.

Золотым сечением отрезка называется деление отрезка в отношении

1

.

1 2

Алгоритм метода золотого сечения:

Пусть на k-ом шаге выбран отрезок ak , bk . Тогда либо k a k

k a k

2

k , либо

3 5

2

k . Сужение отрезка в соответствии с утверждением.

1 5

65 | С т р а н и ц а

x k

Критерий окончания , но при этом x берётся равным

.

k

x

k

Оценка погрешности метода x

k

k

2

2

x

k

.

1 5

1 5

Метод Фибоначчи.

Fn Fn 1 Fn 2 , F0 1, F1 1

В методе Фибоначчи число шагов вычисляют заранее, основываясь на следующей

оценке: x N 1 x

1

.

FN 1

Пример.

1, 102

FN 1 100

F2 2, F3 3, F4 5, F5 8, F6 13, F7 21, F8 34, F9 55, F10 89, F11 100

N 10

Вычисляем точки:

k a k

FN k k

FN k 1

k a k

FN k k

FN k 1

FN 1 1 2 3 5

233

, , , ,...,

1.61806,...

FN

144

1 1 2 3

Градиентные методы.

f x – задана.

Необходимое условие экстремума f x 0 .

Метод Ньютона xn 1 xn

f xn

.

f xn

Лучше использовать метод секущих, так как он быстро сходится.

66 | С т р а н и ц а