Мятлев В.Д., Панченко Л.А., Терехин А. Т.

реклама

Глава 2. Основы математической статистики

Задача математической статистики, в строгом понимании этого

термина, состоит в разработке и применении методов описания реальных

явлений вероятностными моделями, исходя из данных, полученных в

результате наблюдений за этими явлениями.

В более широком смысле математическая статистика понимается как

совокупность методов планирования экспериментов и обработки данных,

полученных в результате экспериментов или наблюдений, причем эти

методы могут не основываться на вероятностных моделях. При таком

широком понимании вместо термина «математическая статистика» часто

используют термин «анализ данных».

Исторически вначале сформировались методы обработки данных, не

связанные тесно с теорией вероятности, так называемая дескриптивная, или

описательная статистика. С начала этого века начали интенсивно

развиваться методы анализа данных, основанные на вероятностных моделях,

- это, прежде всего, методы статистического оценивания и статистической

проверки гипотез, о которых, в основном, и будет идти речь в данной главе.

Бурное развитие вычислительной техники вызвало к жизни ряд новых

методов анализа. Некоторые из этих методов разработаны на основе

подходов,

отличных

от

теоретико-вероятностного

(геометрические,

оптимизационные и др.). Вероятностное обоснование этих методов либо

отсутствует, либо недостаточно развито, что затрудняет количественную

оценку степени достоверности получаемых выводов аналитическими

средствами классической математической статистики. Однако в последние

годы, в связи с быстрым ростом производительности вычислительных

машин, начали также получать распространение процедуры так называемого

67

случайного моделирования (пермутационные методы, бут-стрэп и др.),

позволяющие оценить статистические свойства получаемых решений без

использования аналитических методов.

Начнем рассмотрение методов математической статистики с ее исходного

понятия - понятия случайной выборки.

2.1 Случайная выборка и ее описание

Понятие случайной выборки тесно связано с понятием случайного

испытания и случайной величины, о которых шла речь в предыдущей главе.

Случайная

выборка

представляет

собой

совокупность

наблюдений

x1 , x2 , ..., xn случайной величины , полученных в n независимых

случайных испытаниях. Число полученных наблюдений n называется

объемом выборки. Образно можно представить процесс получения случайной

выборки как извлечение наудачу значений из гипотетической бесконечной

генеральной совокупности, где разные значения содержатся в пропорциях,

соответствующих

распределению

случайной

величины,

и

тщательно

перемешаны между собой. Случайная величина может быть не только

одномерной, но и многомерной, например, когда у случайно выбранного

животного измеряется несколько характеристик: размер, вес и т.д. В этом

случае каждая из компонент выборки будет вектором.

Конкретная случайная выборка - это просто набор значений случайной

величины

(во избежание чрезмерного усложнения обозначений будем

считать ее одномерной). Однако при оценке информации, которую несет эта

выборка, мы должны рассматривать ее как одну из бесконечного числа

потенциально возможных выборок объема n , т. е. как векторную n -мерную

случайную величину

(1, 2 ,..., n )

компонентами которой являются n элементов выборки. Из условий

68

получения выборки следует, что случайные величины 1,

одинаковые

функции

распределения

совпадающие с функцией распределения

величины

2 , ..., n имеют

F1 ( x1 ), F2 ( x2 ), ..., Fn ( xn ) ,

F ( x) исходной случайной

. Кроме того, случайные величины 1, 2 , ..., n по

определению случайной выборки независимы, поэтому их совместная

функция

распределения

равна

произведению

одномерных

функций

распределения

G( x1, x2 , ..., xn ) F1 ( x1 ) F2 ( x2 )... Fn ( xn )

Как правило, информация, содержащаяся в выборке, интересует нас не

столько сама по себе, сколько как информация обо всей генеральной

совокупности. Однако чтобы отвечать этой цели, выборка должна быть

правильно организованной и представительной. Существует специальный

раздел математической статистики - планирование выборочных обследований.

Мы будем рассматривать только один способ получения выборки - простой

случайный выбор. В принципе схема его проста: из тщательно перемешанной

генеральной совокупности извлекается наудачу n значений. На практике,

однако, дело обстоит сложнее. Предположим, что мы отловили n взрослых

животных определенного вида и измерили их массу. Какую генеральную

совокупность представляет эта выборка? Всех животных данного вида, т. е.

живущих в разных местах, прошлых и будущих? Или популяцию,

обитающую в данной местности? Или популяцию, обитающую в данной

местности в данный год? Конечно, чем уже мы будем понимать генеральную

совокупность, описываемую данной выборкой, тем ближе мы будем к

истине, но, возможно, тем меньший интерес для нас она будет представлять.

Итак, мы имеем случайную выборку x1 , x2 , ..., xn значений случайной

величины

с неизвестным распределением F ( x) . Как нам разумно

распорядиться

этими

значениями, чтобы получить представление о

распределении F ( x) , т.е. о генеральной совокупности, из которой извлечена

69

эта выборка?

Можно использовать следующий эвристический принцип - будем считать,

что исследуемая нами генеральная совокупность близка к гипотетической

генеральной совокупности, состоящей только из значений x1 , x2 , ..., xn ,

содержащихся в ней в равной пропорции, т.е. случайная величина

случайной величине

близка к

ˆ , принимающей n значений x1 , x2 , ..., xn с

вероятностями 1/ n (это, действительно, максимум информации о значениях

случайной величины и их вероятностях, которую можно извлечь из

выборки). Распределение случайной величины ˆ называется эмпирическим

распределением случайной величины

, а ее функция распределения Fˆ ( x ) -

эмпирической функцией распределения. Очевидно, что каждой выборке

соответствует своя эмпирическая функция распределения, т.е. можно сказать,

что Fˆ ( x ) - случайная функция. Fˆ ( x ) представляет собой ступенчатую

функцию, возрастающую от 0 до 1 со скачками высотой 1/ n в точках

x1 , x2 ,..., xn (очевидно, если некоторое значение повторяется k раз, то ему

будет соответствовать один скачок величиной k / n ). Можно определить

эмпирическую функцию формулой Fˆ ( x ) n x / n , где nx - число значений

выборки, не превосходящих x .

Пример. Пусть случайная величина

- это длина лепестка случайно

выбранного цветка ириса разноцветного (Iris versicolor). Следующий ряд

чисел содержит значения длин (в см) пятидесяти случайно выбранных

лепестков:

4.6

4.5

4.8

4.6

5.1

3.9

4.5

4.7

4.7

4.5

4

3.8

4.5

4

4.4

4.4

4.5

4.1

4.5

3.5

4.2

3.3

4.2

4.2

4.6

3.9

4.5

3.5

3.7

3.9

4.3

4.2

4

4.7

4.4

4.1

4.9

4.7

4.3

3

70

4.1

4.7

3.6

4.9

4

4

4.4

4.8

5

3.3

Упорядочим эти значения по величине, т.е. представим их в виде так

называемого вариационного ряда:

3

3.3

3.3

3.5

3.5

3.6

3.7

3.8

3.9

3.9

3.9

4

4

4

4

4

4.1

4.1

4.1

4.2

4.2

4.2

4.2

4.3

4.3

4.4

4.4

4.4

4.4

4.5

4.5

4.5

4.5

4.5

4.5

4.5

4.6

4.6

4.6

4.7

4.7

4.7

4.7

4.7

4.8

4.8

4.9

4.9

5

5.1

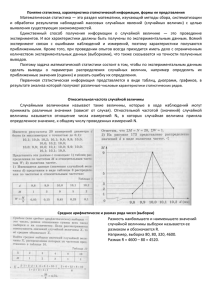

На рис. 2.1 представлено построенное на основе этого вариационного ряда

эмпирическое распределение случайной величины

, для этой выборки, т.е.

распределение случайной величины ˆ , а на рис. 2.2 - соответствующая

8

.16

7

.14

6

.12

5

.10

4

.08

3

.06

2

.04

1

.02

Частоты

Численности наблюдений

эмпирическая функция распределения Fˆ ( x ) .

0

.00

2.9 3.0 3.1 3.2 3.3 3.4 3.5 3.6 3.7 3.8 3.9 4.0 4.1 4.2 4.3 4.4 4.5 4.6 4.7 4.8 4.9 5.0 5.1 5.2

x

Рис.2.1. Пример эмпирического распределения

71

F*(x)

1.00

0.95

0.90

0.85

0.80

0.75

0.70

0.65

0.60

0.55

0.50

0.45

0.40

0.35

0.30

0.25

0.20

0.15

0.10

0.05

0.00

2.8 2.9 3.0 3.1 3.2 3.3 3.4 3.5 3.6 3.7 3.8 3.9 4.0 4.1 4.2 4.3 4.4 4.5 4.6 4.7 4.8 4.9 5.0 5.1 5.2 5.3 5.4 5.5

x

Рис.2.2. Пример эмпирической функции распределения

Поскольку эмпирическая функция распределения Fˆ ( x ) является оценкой

для F ( x) (можно доказать, что при n вероятность того, что

максимальное расхождение между Fˆ ( x ) и F ( x) не превзойдет заданного

малого числа , стремится к единице), можно взять характеристики Fˆ ( x ) в

качестве оценок характеристик генерального распределения.

Ниже мы приводим полученные таким образом формулы для некоторых

выборочных характеристик.

Название характеристики

Выборочный момент порядка k

Выборочный центральный момент

порядка k

Выборочное среднее - первый

нецентральный момент

Формула

1 n k

̂ k xi

n i 1

1 n

n i 1

ˆ k ,0 ( xi x ) k

1 n

x ̂1 xi

n i 1

72

Выборочная дисперсия – второй

s 02

центральный момент

1 n

( xi x ) 2

n i 1

ˆ1

Выборочный коэффициент асимметрии

ˆ 2

Выборочный коэффициент эксцесса

ˆ 3,0

ˆ 23,/02

ˆ 4,0

ˆ 22,0

Зная эмпирическую функцию распределения, можно также найти

эмпирические квантили, квартили и итерквартильную широту точно так же,

как в случае обычной (теоретической) функции распределения. А именно,

выборочная квантиль Ĉ p порядка

p получается как абсцисса точки

пересечения горизонтальной прямой, пересекающей ось ординат в точке p , с

эмпирической функцией распределения Fˆ ( x ) (если пересечение не точка, а

отрезок, то в качестве квантили можно взять абсциссу середины этого

отрезка). Выборочные квантили Cˆ 0.25 , Cˆ 0.50 , Cˆ 0.75 дают соответственно

выборочную нижнюю квартиль Q̂1 , выборочную медиану Q̂2 и выборочную

верхнюю

квартиль

Q̂3 ,

а

разность

Cˆ 0.75 Cˆ 0.25

-

выборочную

интерквартильную широту. Еще одна характеристика разброса значений

случайной величины - размах

R определяется как разность между

максимальным и минимальным значением в выборке.

Если наблюдается не одномерная, а двумерная случайная величина ( , ) ,

т. е. выборка состоит из n пар значений ( x1 , y1 ), ( x2 , y2 ), ..., ( xn , yn ) , то

можно вычислить выборочный коэффициент ковариации для и

1 n

côv( ,) ( xi x )( yi y )

n i 1

73

где

1 n

x xi

n i 1

1 n

y yi

n i 1

и

Выборочный коэффициент корреляции определяется формулой

r

côv( , )

s s

0 0

где

1 n

n i 1

s20 ( xi x ) 2

и

1 n

n i 1

s20 ( y i y ) 2

Выборочную моду xmod целесообразно оценивать для дискретного и

непрерывного генерального распределения различными способами. В

дискретном случае оценкой моды будет значение, встретившееся в выборке

наибольшее число раз. В непрерывном случае повторяющиеся значения

редки или вообще отсутствуют, поэтому следует разбить диапазон изменения

наблюденных значений точками a0 , a1 , ..., ak на k равных промежутков

[a0 , a1 ], (a1 , a2 ], ..., [ak 1 , ak ] длиной h (ak a0 ) / k

и в качестве

выборочной моды взять середину интервала, в который попало наибольшее

число значений.

Ниже даны значения характеристик, вычисленные для приведенного выше

примера данных о длинах лепестков ириса.

Название характеристики

Значение характеристики

x 4.26

Выборочное среднее

Выборочная дисперсия (несмещенная

оценка - см. п. 2.2.1)

s2

n 2

s 0 0.2164

n 1

74

Выборочный коэффициент асимметрии

ˆ1 0.61

Выборочный коэффициент эксцесса

ˆ 2 0.05

Минимум

xmin 3,0

Максимум

xmax 5,1

R 2,1

Размах

Нижняя квартиль

Qˆ1 4,00

Верхняя квартиль

Qˆ 3 4,60

Qˆ 3 Qˆ1 0,60

Интерквартильный размах

Медиана

Qˆ 2 4,35

Мода

xmod 4,50

Результаты разбиения диапазона изменения значений выборки на

интервалы и последующего подсчета числа значений ni , попавших в

интервалы i 1, 2, ..., k , можно представить графически. Построив над

каждым интервалом i столбик высотой ni , мы получим так называемую

гистограмму. Если при построении гистограммы оперировать не числом

значений, попавших в интервалы, а их относительной частотой в выборке

i ni / n и откладывать столбики высотой i , то полученная гистограмма

будет выборочным аналогом плотности непрерывного распределения. В

частности, сумма площадей всех столбиков гистограммы будет равна

единице, как и для плотности распределения. Очевидно, что поскольку

частоты

i

пропорциональны

численностям

ni ,

гистограммы

для

75

численностей и частот различаются только масштабом шкалы по оси

ординат. На рис. 2.3 приведен пример гистограммы для рассмотренной выше

выборки, содержащей 50 значений длин лепестков ириса (заметим, что рис.

2.3 можно рассматривать как результат преобразования рис. 2.1 путем

11

.22

10

.20

9

.18

8

.16

7

.14

6

.12

5

.10

4

.08

3

.06

2

.04

1

.02

0

Частоты

Численности

группировки значений на оси абсцисс).

.00

<= 3

(3.2,3.4]

(3,3.2]

(3.6,3.8]

(3.4,3.6]

(4,4.2]

(3.8,4]

(4.4,4.6]

(4.2,4.4]

(4.8,5]

(4.6,4.8]

>5

x

Рис.2.3. Пример гистограммы.

При построении гистограммы возникает трудно формализуемая проблема

выбора оптимальных длин интервалов разбиения

h . Обычно число

интервалов разбиения выбирают из расчета, чтобы в каждый интервал

попало в среднем не менее десяти наблюдений (при очень малых объемах

выборки это число уменьшают). Таким образом, при увеличении объема

выборки n можно уменьшать длины интервалов разбиения и более детально

характеризовать выборку, а следовательно, и порождающее ее генеральное

распределение. По сравнению с эмпирической функцией распределения

гистограмма более наглядна, однако при ее построении привносится элемент

субъективизма. В принципе, можно построить гистограмму и на основе

интервалов разбиения разной длины, но тогда процедура ее построения

несколько усложняется и поэтому такие гистограммы используются

довольно редко.

76

2.2. Статистическое оценивание

Допустим, что у нас имеется случайная выборка x1 , x2 , ..., xn значений

некоторой случайной величины

. Распределение этой случайной величины

может быть либо полностью неизвестным, либо частично известным,

например, может быть известна его функциональная форма (вид функции

распределения

или

плотности

в

непрерывном

случае

и

формулы,

определяющей вероятности отдельных значений, - в дискретном). Если вид

распределения неизвестен, то нас могут интересовать различные его

характеристики - математическое ожидание, мода, медиана, дисперсия,

интерквартильная широта, моменты, асимметрия, эксцесс и т.д. Если же вид

распределения известен, а неизвестны лишь значения определяющих его

параметров, нас могут интересовать также (или даже прежде всего) значения

этих параметров, например, параметров и

распределения, параметра

2

в случае нормального

- в случае пуассоновского, параметра p - в

случае биномиального. Задача оценивания неизвестного параметра или

распределения случайной величины состоит в

характеристики

вычислении

на

основе

значений

выборки

x1 , x2 , ..., xn

величины

ˆ( x1 , x2 , ..., xn ) , в каком-то смысле близкой к оцениваемому параметру или

характеристике и называемой точечной оценкой

неизвестного параметра

, поскольку за оценку

принимается конкретное значение (точка),

вычисляемое по выборке (см., напр., Кендалл, Стьюарт, 1973). Точечные

оценки рассматриваются в п. 2.2.1. В п. 2.2.2 будут рассмотрены так

называемые интервальные оценки.

2.2.1. Точечное статистическое оценивание

Фактически

мы

решали

задачу оценивания,

когда рассматривали

77

выборочные математическое ожидание, дисперсию и т.д. как оценки

неизвестных генеральных характеристик. Однако этот подход к оцениванию

был скорее интуитивным, и сейчас мы попробуем его формализовать. Эта

формализация касается уточнения смысла близости выборочной оценки

ˆ ˆ( x1 , x2 , ..., xn ) к оцениваемому параметру . Заметим, прежде всего,

что ˆ является случайной величиной, значения которой меняются от

выборки к выборке. Для некоторых выборок значение ˆ может оказаться

очень близким к оцениваемому параметру , для других - довольно далеким.

Можно, однако, потребовать, что хотя бы в среднем оценки для разных

выборок группировались вокруг оцениваемого параметра, т.е. чтобы

выполнялось условие Mˆ . Оценки, удовлетворяющие этому условию

называются несмещенными. Отметим, что в зависимости от контекста мы

рассматриваем ˆ( x1 , x2 , ..., xn ) либо как случайную величину (и только в

этом случае мы имеем право говорить о математическом ожидании ˆ - как

это

было

в

приведенном

определении

несмещенности),

либо

как

алгебраическую формулу для вычисления значения оценки по выборке, либо

просто как конкретное значение, полученное для конкретной выборки.

Можно доказать, пользуясь свойствами математического ожидания и

определением выборки, что выборочное математическое ожидание (чаще

используется термин выборочное среднее) x является несмещенной оценкой

истинного

математического

ожидания

(генерального

среднего)

M .

Действительно, имеем

M x M{

1 n

1 n

1 n

x } M xi n M ξ M

n i 1 i n i 1

i 1

(мы воспользовались также тем очевидным фактом, что распределение

любой компоненты выборки xi , совпадает с распределением анализируемой

случайной величины ).

78

Однако, вопреки нашей интуиции, математическое ожидание выборочного

второго центрального момента

1 n

ˆ 2,0 ( xi x ) 2

n i 1

не равно генеральной дисперсии. Для получения несмещенной оценки

дисперсии s

2

Действительно,

надо разделить сумму квадратов на n 1 , а не на n .

пользуясь

свойствами

математического

ожидания,

в

частности тем, что математическое ожидание произведения независимых

случайных величин равно произведению их математических ожиданий,

получаем

M{ s

2

1 n

1 n

2

} M{ ( xi - x ) } M{

[( xi - M ξ ) (M ξ - x )] 2}

n 1 i 1

n 1 i 1

n

1 n

2

M{

[ ( xi - M ξ ) 2(M ξ - x ) ( xi - M ξ ) n(M ξ - x ) 2 ]}

n 1 i 1

i 1

M{

1 n

[ ( xi - M ξ ) 2 2 n(M ξ - x ) 2 n(M ξ - x ) 2 ]}

n 1 i 1

M{

1 n

[ ( xi - M ξ ) 2 n( x M ξ ) 2 ]}

n 1 i 1

1 n

1

n

[ M { ( xi - M ξ ) 2 } nM{ ( x M ξ ) 2 }] [nD ξ D ξ ] D ξ

n 1 i 1

n 1

n

Таким образом, несмещенной оценкой для D будет s

2

- сумма

квадратов отклонений от среднего, деленная на n 1

1 n

s

( xi x ) 2

n 1 i 1

2

Следует, однако, отметить, что хотя выборочный центральный момент

второго порядка не является несмещенной оценкой для дисперсии D , его

смещение (отклонение математического ожидания оценки от D ), равное

79

D

n

, стремится к нулю при n . Оценки, удовлетворяющие этому

свойству, называются асимптотически несмещенными, и часто, когда не

удается

найти

несмещенной

оценки

для

оцениваемого

параметра,

довольствуются асимптотически несмещенными оценками. Конечно, нас не

очень интересует, что происходит со смещением при n , когда мы

имеем дело с конкретной выборкой фиксированного объема n . Скорее, мы

предпочитаем асимптотически несмещенные оценки из-за того, что, как

правило, их смещение относительно невелико при не очень малых объемах

выборки. Например, смещение

̂2,0 при n 50 равно 2% .

Конечно, коль скоро s есть несмещенная оценка для D , то ей и следует

2

пользоваться. Однако нас чаще интересует не столько оценка дисперсии D

случайной величины , сколько оценка ее среднеквадратичного отклонения

D . Естественно взять в качестве оценки среднеквадратичного

отклонения квадратный корень несмещенной оценки, т.е. s , однако следует

помнить, что s не будет несмещенной оценкой для

D , а будет лишь

асимптотически несмещенной.

Итак, на примере с получением несмещенной оценки дисперсии мы

убедились, что "естественный" способ получения оценок, состоящий в

использовании характеристик выборочного распределения в качестве оценок

характеристик генерального распределения не всегда приводит к наилучшим

результатам. Существует ряд регулярных приемов получения оценок, такие

как метод моментов или метод максимального правдоподобия (см. ниже), но

они не всегда приводят к наилучшим оценкам (например, с точки зрения

несмещенности). Поэтому общий подход к задаче оценивания состоит в том,

что в качестве претендента на оценку характеристики или параметра (для

краткости мы иногда будем использовать только термин «параметр»)

80

генерального распределения по случайной выборке x1 , x2 , ..., xn в принципе

может взята любая функция ˆ( x1 , x2 , ..., xn ) от компонент выборки (вместо

словосочетания «функция от выборки» обычно используют более краткий

термин «статистика»), среди которых должна быть выбрана наилучшая.

У нас уже есть один критерий для сравнения оценок - это наличие или

отсутствие несмещенности (хотя бы асимптотической). Однако этого

недостаточно. Действительно, было показано, что выборочное среднее x несмещенная оценка для математического ожидания M . Но можно

предложить другие несмещенные оценки для математического ожидания.

Например, полусумма первого и второго значений выборки ( x1 x2 ) / 2 , как

легко показать, будет также несмещенной оценкой для M . Конечно,

интуитивно мы чувствуем, что x

- более предпочтительная оценка,

поскольку она более полно учитывает информацию, содержащуюся в

выборке. Однако необходим какой-то критерий, позволяющий чисто

формально показать, что

x лучше оценок типа ( x1 x2 ) / 2 . Таким

критерием, может служить состоятельность оценки. Оценка ˆ( x1 , x2 , ..., xn )

называется состоятельной, если при n она сходится по вероятности к

оцениваемому параметру

, т.е. если для любого положительного

выполняется условие

lim P (| ˆ | ) 0

n

Достаточным условием состоятельности

оценки ˆ

является ее

несмещенность и стремление дисперсии оценки ˆ к нулю при увеличении

объема выборки, т.е. оценка будет состоятельной, если Mˆ

и

lim Dˆ 0 . Справедливость этого утверждения непосредственно следует

n

из неравенства Чебышева, которое в данном случае имеет следующий вид

81

Dˆ

P (| ˆ M ˆ | ) 2

Пользуясь этим достаточным условием, покажем, что выборочное среднее

x является состоятельной оценкой математического ожидания. Поскольку

несмещенность x уже была доказана, осталось показать, что Dx при

n . Действительно, имеем

D x D(

1 n

1 n

1

x

)

D xi n D

i

n i 1

n 2 i 1

n2

1 D 0

n

n

Таким образом x - состоятельная оценка для математического ожидания

M случайной величины . И, наоборот, как легко видеть, полусумма

( x1 x2 ) / 2 первого и второго значений выборки, будучи несмещенной, не

является состоятельной, поскольку ее дисперсия не стремится к 0 при

неограниченном увеличении n

x x

1

1

D ( 1 n ) ( D x1 D xn ) D

2

4

2

Аналогично можно доказать, что несмещенная оценка дисперсии s

2

является состоятельной оценкой для генеральной дисперсии D .

Еще одним желательным свойством оценки является ее эффективность.

Несмещенная

оценка

ˆ( x1 , x2 , ..., xn )

эффективной оценкой, если Dˆ D

оценки

*

параметра

называется

для любой другой несмещенной

* ( x1 , x2 , ..., xn ) . Дело в том, что две оценки, будучи обе

несмещенными и состоятельными, могут различаться своими дисперсиями.

Например, следующая оценка для математического ожидания

~x 1

n 1

x

n 1 i 1 i

82

будет, как легко проверить, несмещенной и состоятельной. Однако она не

будет эффективной, т.к. ее дисперсия

равна

D

n

Выше

D

n 1

больше дисперсии x , которая

.

было

сказано,

что

любая

функция

от

выборки

может

рассматриваться как потенциальая оценка параметра или характеристики

наблюдения. Тем не менее, по крайней мере, для получения начальных

выражений

для

оценок,

полезно

использовать

регулярные

методы.

Полученные таким методом оценки следует проверить на несмещеннось,

состоятельность

и

эффективность

и

затем,

если

необходимо,

подкорректировать (подобно тому, как это было сделано с первоначально

смещенной оценкой дисперсии). Наиболее часто для получения оценок

применяется метод моментов и метод максимума правдоподобия.

Метод моментов, предложенный К. Пирсоном в 1894 г., а еще ранее в

частных случаях применявшийся Гауссом, состоит в приравнивании

некоторого числа выборочных моментов соответствующим моментам

неизвестного теоретического распределения. Полученная система уравнений

будет содержить в качестве неизвестных параметры теоретического

распределения (через которые выражаются теоретические моменты) и

известные выборочные значения, поэтому решая эту систему относительно

неизвестных параметров, мы получим для них выражения в виде функций от

выборочных

значений.

Можно

сказать,

что

выше,

приравнивая

математическое ожидание первому выборочному моменту, а дисперсию –

второму центральному выборочному моменту, мы применили этот метод (во

всяком случае, это так для нормального распределения, у которого

параметры и 2 совпадают, соответственно, с первым моментом 1 и

вторым центральным моментом 2,0 ).

Метод максимума правдоподобия был впервые предложен Р. Фишером в

83

1912 г. Он состоит в том, что в качестве оценок параметров распределения

берутся такие значения неизвестных параметров 1 , 2 ,..., k , которым

соответствует максимальное «правдоподобие»

L

(от англ. likelihood)

появления полученной выборки x1 , x2 ,..., xn , т.е. максимальная вероятность

(в дискретном случае)

L( x1 , x2 ,..., xn ;1 , 2 ,..., k ) P( x1 , x2 ,..., xn ;1 , 2 ,..., k )

P( x1 ;1 , 2 ,..., k ) P( x2 ;1 , 2 ,..., k )...P( xn ;1 , 2 ,..., k )

или максимальная плотность вероятности (в непрерывном случае)

L( x1 , x2 ,..., xn ;1 , 2 ,..., k ) f ( x1 , x2 ,..., xn ;1 , 2 ,..., k )

f ( x1 ;1 , 2 ,..., k ) f ( x2 ;1 , 2 ,..., k )... f ( xn ;1 , 2 ,..., k )

Поскольку функция правдоподобия L( x1 , x2 ,..., xn ;1 , 2 ,..., k ) зависит как от

неизвестных параметров теоретического распределения, так и от выборочных

значений, то, решая задачу ее максимизации по 1 , 2 ,..., k , мы найдем

выражения

неизвестных

параметров

1 , 2 ,..., k

через

известные

выборочные значения x1 , x2 ,..., xn (см., напр., Крамер, 1975). Пример

применения

метода

максимального

правдоподобия

для

оценивания

неизвестных параметров можно найти далее в п. 3.3.5, посвященном

логистической регрессии.

2.2.2 Интервальное статистическое оценивание

В предыдущем параграфе мы рассматривали точечные оценки. Однако

часто нас интересует не только конкретное значение оценки, но и такие

свойства оценки, которые ассоциируются с ее точностью и надежностью.

Этим требованиям отвечают так называемые интервальные оценки.

Интервальная

оценка

-

это

некоторый

интервал

( нижн , верхн )

называемый доверительным интервалом, концы которого (доверительные

пределы) зависят от выборочных значений и заданной доверительной

84

вероятности

теоретическое

и который с заданной

(«истинное»)

значение

вероятностью , содержит

оцениваемого

неизвестного

параметра, т.е.

P(нижн верхн )

(дополнение до 1 будем обозначать , т.е. 1 ). Наиболее часто

используются значения доверительной вероятности равные 0,95 или 0,99

(95%-ный и 99%-ный доверительные интервалы).

2.2.2.1 Доверительный интервал для математического ожидания

нормально распределенной случайной величины с известной дисперсией

Проще всего понять логику интервального оценивания на примере

построения доверительного интервала для математического ожидания

нормально распределенной случайной величины с известной дисперсией.

Пусть

- нормально распределенная случайная величина с неизвестным

математическим ожиданием M и дисперсией D , т.е. в наших

2

обозначениях ~ N ( , ) , и имеется выборка значений этой случайной

2

величины x1 , x2 , ..., xn объема n . Требуется найти доверительный интервал

для с доверительной вероятностью .

Выше было показано, что выборочное среднее (для любого распределения,

в том числе и нормального) имеет математическое ожидание, равное

математическому ожиданию исходной случайной величины, т.е. , а

дисперсия - дисперсии исходной случайной величины, деленной на n , т.е.

2 / n . Следовательно, статистика

u

x

/ n

(2.1)

полученная путем стандартизации выборочного среднего x , будет иметь

85

нулевое математическое ожидание и единичную дисперсию. Поскольку, как

мы знаем, линейные комбинации нормально распределенных случайных

величин имеют также нормальное распределение, а случайная величина u

фактически является линейной комбинацией нормально распределенных

случайных величин x1 , x2 , ..., xn то u будет стандартно распределенной

случайной

величиной,

т.е.

u ~ N (0, 1) .

Стандартное

нормальное

распределение - это конкретное, полностью заданное распределение,

квантили которого можно найти в соответствующих таблицах (или

вычислить путем численного интегрирования). В частности, можно найти

симметричные относительно центра распределения границы, внутрь которых

u попадает с заданной вероятностью

P(u / 2 u u1 / 2 )

или, с учетом симметрии,

P( u1 / 2 u u1 / 2 )

(через u

/2

и u

1 / 2

распределения порядка

(2.2)

обозначены квантили стандартного нормального

/ 2 и 1 / 2 ). В частности, справедливы

следующие неравенства

P(1,96 u 1,96) 0,95 и P ( 2,58 u 2,58) 0,99

Подставляя в (2.2) выражение для u из (2.1), получаем

P( u1 / 2

x

u1 / 2 )

/ n

(2.3)

или, после преобразований,

P (x u1 / 2

n

x u1 / 2

n

)

86

Это означает, что интервал (x u

, x u

) будет

1 / 2 n

1 / 2 n

100 % -ным доверительным интервалом для неизвестного математического

ожидания нормального распределения с известной дисперсией . В

2

частности,

(x 1,96

95%-ным

,

n

x 1,96

доверительным

n

интервалом

) , а 99%-ным - (x 2,58

n

будет

, x 2,58

интервал

n

) . Мы

видим, что ширина доверительного интервала уменьшается при уменьшении

, увеличении объема выборки и снижении доверительной вероятности.

2.2.2.2 Доверительный интервал для математического ожидания

нормально распределенной случайной величины с неизвестной

дисперсией

В случае неизвестной дисперсии постановка задачи и ход рассуждений при

построении доверительного интервала аналогичны случаю известной

дисперсии, рассмотренному в предыдущем параграфе. Разница состоит в

том, что в выражении (2.1) неизвестное среднеквадратичное отклонение

заменяется на его выборочную оценку s

t

x

s/ n

(2.4)

Полученная таким путем статистика t , будучи довольно сложной

функцией от нормально распределенных случайных величин x1 , x2 , ..., xn ,

уже не будет нормально распределенной. Можно, однако, доказать, что

статистика t имеет t -распределение с n 1 степенями свободы. Отсюда

следует, что справедливо равенство

P( tn1,1 / 2

x

tn1,1 / 2 )

s/ n

87

аналогичное уравнению (2.3) и отличающееся от него заменой на s и

квантилей нормального распределения на соответствующие квантили t распределения с n 1 степенями свободы. Соответственно 100 % -ный

доверительный интервал для неизвестного математического ожидания

нормального распределения с неизвестной дисперсией

2

будет иметь

следующий вид

(x tn1,1 / 2

s

s

s

, x tn1,1 / 2

) или (x tn1,1 / 2

)

n

n

n

Известно, что этот доверительный интервал и доверительный интервал из

предыдущего раздела являются робастными, т.е. они нечувствительны к

умеренным отклонениям от предположения о нормальности распределения.

Во всяком случае, как отмечается в пособиях по математической статистике,

при объеме выборки не менее 15 становится целесообразно использовать

приведенные доверительные интервалы для математического ожидания и в

случае умеренного отклонения от предположения о нормальности.

Заметим, что при n t -распределение приближается к нормальному

распределению, а его квантили - к квантилям нормального распределения.

Например, при n 1 =60 квантиль t 60,0.975 равна 2,00, что не очень сильно

отличается от аналогичного значения

u0,975 1,96 для нормального

распределения (особенно на фоне выборочных флуктуаций x и s ). Поэтому

при числе наблюдений порядка нескольких десятков можно пользоваться

нормальным приближением для t-распределения. Однако при небольшом

числе степеней свободы различие между квантилями t -распределения и

нормального распределения довольно значительно. Например, для n 1 =1

имеем

t1,0,975 12,71, для n 1=2 - t2,0,975 4,30 , для n 1=5 -

t5,0,975 2,57 . Но уже при n 1=9 (т.е. для выборки из 10 наблюдений)

получаем значение t9,0,975 2,26 , что, в принципе, не очень сильно

88

отличается от 1,96.

Возвращаясь к примеру с длинами лепестков ириса и учитывая, что

x 4,26 , s 0,47 , t49;0,975 2,01 (при числе степеней свободы n 1=49), а

также предполагая, что распределение длин лепестков нормально (в

следующем

разделе

мы

рассмотрим

процедуру

проверки

этого

предположения), получаем, что 95%-ным доверительным интервалом для

математического ожидания длины лепестка будет интервал (4,13; 4,39). Т.е.

мы можем утверждать, что с вероятностью 0,95 неизвестное находится

между 4,13 и 4,39 (точнее следовало бы сказать, что найденный

доверительный интервал с вероятностью 0,95 накрывает неизвестное

значение ).

2.2.2.3 Доверительный интервал для неизвестной дисперсии нормально

распределенной случайной величины (при неизвестном математическом

ожидании)

Для нахождения доверительного интервала для неизвестной дисперсии

нормально распределенной случайной величины рассмотрим статистику

(n 1) s 2

2

2

Можно показать, что эта статистика имеет

2 - распределение с n 1

степенями свободы. Следовательно, справедливо равенство

P (

2

n 1, / 2

(n 1) s 2

2

n 1,1 / 2

)

которое можно переписать в виде

89

(n 1) s 2

P( 2

)

2

n 1,1 / 2

n 1, / 2

(n 1) s 2

2

Таким образом, 100%-ный доверительный интервал для неизвестной

дисперсии

2

нормального распределения с неизвестным математическим

ожиданием будет иметь следующий вид

(

где

2

и

n 1, / 2

2

(n 1) s 2

,

(n 1) s 2

n2 1,1 / 2 n2 1, / 2

n 1,1 / 2

)

- квантили распределения

2 с n 1 степенями

2

свободы. В частности, для длины лепестков ириса, учитывая, что s =0,22,

n 1=49, 2

49,0,025

70,24 и 2

49,0,975

31,55 , получаем, что 95%-ным

доверительным интервалом для дисперсии (в предположении нормальности

распределения) будет интервал (0,15; 0,34).

Заметим, что полученный доверительный интервал для дисперсии, в

отличие от доверительного интервала для математического ожидания,

чувствителен к отклонениям от исходного предположения о нормальности

распределения.

2.2.2.4 Доверительный интервал для неизвестного параметра p

биномиального распределения

Пусть произведено n независимых испытаний, в которых некоторое

событие A произошло k раз. Требуется найти точечную и интервальную

оценку неизвестной вероятности p появления этого события.

90

Эту задачу можно рассматривать в двух эквивалентных формулировках. В

первой формулировке считается, что получено n наблюдений случайной

величины

1 , принимающей с вероятностью p значение 1 в случае

появления события A и с вероятностью 1 p значение 0 - в случае

непоявления события A (распределение Бернулли). Во второй формулировке

считается, что имеется только одно наблюдение случайной величины

-

числа появлений события A в одном сложном испытании (биномиальное

распределение).

Поскольку математическое ожидание

получение

оценки

для

p

1 , как мы знаем, равно p , то

равносильно

получению

оценки

для

математического ожидания 1 . Несмещенной, состоятельной и эффективной

оценкой для математического ожидания является выборочное среднее,

которое в данном случае совпадает с частотой k / n появления события A

в выборке. Таким образом, выборочная частота является несмещенной,

состоятельной и эффективной оценкой для неизвестной вероятности. Во

второй формулировке математическое ожидание

равно np , а выборочное

среднее для одного наблюдения равно самому наблюдению, т.е. k . И

поскольку оценкой для np служит k (среднее по одному наблюдению), то

оценкой для p снова будет k / n .

Построение доверительных интервалов несколько проще обсуждать в

терминах биномиального распределения. Можно построить как точные

доверительные интервалы для p , так и приближенные. Математическая

техника нахождения точных доверительных интервалов довольно громоздка

и мы приведем здесь лишь окончательные формулы для доверительных

пределов. Напротив, выражения для приближенных доверительных пределов

легко получаются на основе применения центральной предельной теоремы,

91

однако они применимы лишь при достаточно большом n - ориентировочно

при n

25

.

( 1)

Точный

доверительный

интервал

для

параметра

биномиального

распределения имеет вид

(

(k 1) F2 ( k 1),2 ( nk ),1 / 2

k

,

)

k (n k 1) F2 ( nk 1),2 k ,1 / 2 n k (k 1) F2 ( k 1),2 ( nk ),1 / 2

где n - число испытаний, k - число появлений события A, а F f ,g ,

обозначает квантиль порядка распределения F с

f , g степенями

свободы.

Рассмотрим в качестве примера приведенные в п. 1.2 данные о длине

лепестков ириса с точки зрения оценки вероятности появления в случайной

выборке "длинных" лепестков, а именно, лепестков длиной 4,5 см и более. В

данном случае n =50 и k =21. Следовательно, точечной оценкой для p

будет значение

k / n =0,42, а 95%-ным доверительным интервалом -

интервал

(

Учитывая,

что

22 F42,58,0.975

21

,

)

2130 F60,42,0.975 29 22 F42,58,0.975

F60,42,0,975 1,78

и

F42,58,0,975 1,74 ,

получаем

окончательно интервал (0,28; 0,57).

Приближенный доверительный интервал для параметра биномиального

распределения. Поскольку число появлений события A в n испытаниях равно

сумме чисел появлений этого события в отдельных испытаниях (0 или 1), то

в соответствии с центральной предельной теоремой при больших n

распределение

биномиальной

случайной

величины

будет

близко

к

нормальному. Учитывая, что дисперсия биномиальной случайной величины

92

равна np(1 p) , получаем для ее математического ожидания приближенные

доверительные пределы k u

соответственно u

1 / 2

np(1 p ) , а для параметра p -

p(1 p )

. Заменяя параметр p его выборочной

n

1 / 2

оценкой , получаем окончательно для приближенного доверительного

интервала параметра p следующее выражение

u

(1 )

1 / 2

n

.

В частности, для предыдущего примера, подставляя =0,42, u0,975 1,96

и n =50, получаем приближенный доверительный интервал (0,28; 0,56), не

слишком отличающийся от точного доверительного интервала.

2.2.2.5 Доверительный интервал для неизвестного параметра

пуассоновского распределения

Пусть число появлений некоторого события A является случайной

величиной, имеющей пуассоновское распределение, и пусть в результате

наблюдения событие A произошло k раз. Требуется найти точечную и

интервальную

оценку

неизвестного

распределения.

Поскольку

параметра

является

пуассоновского

математическим

ожиданием

пуассоновской случайной величины, то несмещенной, состоятельной и

эффективной оценкой для

будет выборочное среднее, которое для

рассматриваемой ситуации единственного наблюдения совпадает с k . Что

касается доверительных пределов для параметра

, то, как и в случае

биномиального распределения, можно предложить точное и приближенное

решения. Выражения для приближенных доверительных пределов также

основаны на применении центральной предельной теоремы и применимы

лишь при достаточно большом k - ориентировочно при k 25 .

93

Точный доверительный интервал для параметра

пуассоновского

распределения имеет вид

1

1

2

( 22k , / 2 , 22k 2,1 / 2 )

2

где k - число появлений события A, а f , обозначает квантиль порядка

2

распределения с f степенями свободы.

2

Рассмотрим следующий пример. Пусть после фильтрования 1 мл воды на

фильтровальной

бумаге

обнаружено

клеток

100

фитопланктона.

Предполагая, что число клеток в заданном объеме воды имеет пуассоновское

распределение, найти 95%-ные доверительные пределы для параметра

этого

распределения.

k 100 ,

Подставляя

2

200,0,025

162,7

и

2

202,0,975

243, 4 в приведенные выше выражения, получаем 95%-ный

доверительный интервал: (81,3; 121,7).

Приближенный доверительный интервал для параметра пуассоновского

распределения. Поскольку число появлений события A при наблюдении

пуассоновской

случайной

величины

можно

аппроксимировать

биномиальным распределением, а последнее - нормальным, то при не

слишком малых k в соответствии с центральной предельной теоремой

распределение случайной величины

будет близко к нормальному.

Учитывая, что дисперсия пуассоновской случайной величины равна

получаем

для

доверительные

ее

математического

пределы

выборочной оценкой

k u

1 / 2

ожидания

,

приближенные

. Заменяя параметр

его

k , получаем окончательно для приближенного

доверительного интервала параметра

k u

следующее выражение

1 / 2

k.

94

В

частности,

для

предыдущего

примера,

подставляя

k 100 и

u0,975 1,96 , получаем приближенный доверительный интервал (80,4;

119,6), не слишком отличающийся от точного доверительного интервала.

2.2.2.6 Приближенный доверительный интервал для неизвестного

коэффициента корреляции двумерного нормального распределения

Рассмотрим теперь вопрос построения доверительного интервала для

коэффициента корреляции. Пусть ( x1 , y1 ), ( x2 , y2 ), ..., ( xn , yn ) - случайная

выборка объема n из двумерного нормального распределения. Пусть коэффициент корреляции случайных величин

и , а r - выборочный

коэффициент корреляции. Распределение коэффициента корреляции r ,

особенно при значениях близких к 0 или 1 может сильно отличаться от

нормального. Однако распределение следующей функции от r , называемой

преобразованием Фишера, довольно хорошо аппроксимируется нормальным

распределением

1 1 r

z ln

2 1 r

со средним Mz

1

1 1

ln

и дисперсией Dz

. Соответственно,

n3

2 1

стандартизованная случайная величина будет иметь стандартное нормальное

распределение

u n 3( z 12 ln

1

) ~ N (0, 1)

1

и с вероятностью будет заключена в пределах

u1 / 2 , т.е.

95

1

P( u

n 3( z 1 ln

)u

)

1 / 2

1 / 2

2 1

Решая неравенство под знаком вероятности относительно неизвестного

коэффициента корреляции , получаем окончательно

1

1

2( z

u

)

2( z

u

)

n 3 1 / 2 1

n 3 1 / 2 1

e

e

P

1

1

2( z

u

)

2( z

u

)

1

/

2

1

/

2

e

n3

n3

1

e

1

Заметим, что полученный доверительный интервал для коэффициента

корреляции чувствителен к отклонениям от исходного предположения о

двумерной нормальности случайных величин и .

Пример. Пусть объем выборки n 10 , а вычисленное по выборке

значение

r 0,6 , тогда 95%-ным доверительным интервалом для

неизвестного коэффициента корреляции будет интервал (0,05; 0,88).

2.3. Статистическая проверка гипотез

Пусть x1 , x2 ,..., xn - случайная выборка значений случайной величины

,

имеющей некоторое полностью или частично неизвестное распределение

F ( x) . В предыдущем разделе рассматривались методы получения оценок

параметров или характеристик этого неизвестного распределения. Однако

часто нас интересуют не столько конкретные количественные оценки,

сколько

правильность

относящихся

к

или

ошибочность

распределению

некоторых

наблюдаемой

утверждений,

случайной

величины.

Например, является ли это распределение нормальным или нет? Или, равно

математическое ожидание заданному значению или нет? Если кроме выборки

x1 , x2 , ..., xn имеется выборка y1 , y2 , ..., yn значений другой случайной

96

величины , то можно поставить вопрос о том, равны или нет

математические ожидания случайных величин

и ? Если имеется выборка

( x1 , y1 ), ( x2 , y2 ), ..., ( xn , yn ) двумерной случайной величины ( , ) , то

может возникнуть вопрос о том, равен нулю или нет коэффициент

корреляции между и ?

2.3.1. Логика проверки статистических гипотез

Решению задач проверки гипотез о генеральном распределении по

выборке

из

этого

распределения

посвящен

специальный

раздел

математической статистики - проверка статистических гипотез. Логика

проверки гипотез в математической статистике (она напоминает логику

доказательства

от

противного)

состоит

в

следующем.

Вначале

предполагается, что проверяемая гипотеза (ее принято называть нулевой

гипотезой и обозначать H 0 ) верна. В предположении, что H 0 верна, ищется

распределение вероятностей некоторой функции g ( x1 , x2 ,..., xn ) от значений

выборки, называемой статистикой критерия (правило проверки гипотезы

принято называть критерием), и в области значений этой статистики

выделяется некоторая область W , называемая критической областью, такая,

что вероятность P( g W ) попадания выборочного значения статистики g в

эту область не превосходит заданного малого значения , называемого

уровнем значимости критерия (обычно полагают равным 0,05 или 0,01).

Если для данной конкретной выборки g попадает в критическую область

W , то гипотеза H 0 отвергается (говорят – «отвергается на уровне

значимости

»),

поскольку

вероятность

этого

события,

если

в

действительности верна H 0 , мала. Если же g не попадает в критическую

область W , то говорят, что «гипотеза H 0 не отвергается на уровне

97

значимости » (или – «полученные данные не дают оснований отвергнуть

гипотезу H 0 на уровне значимости »).

Очевидно, однако, что можно разными способами задать статистику

критерия g ( x1 , x2 ,..., xn ) , а для заданной статистики можно разными

способами выбрать критическую область W , удовлетворяющую условию

P( g W ) . Поэтому следует выбирать g и W в некотором смысле

наилучшими из возможных, а именно такими, чтобы полученный критерий

был наиболее мощным.

Для

определения

понятия

мощности

критерия

введем

понятие

альтернативной гипотезы H 1 , т.е. гипотезы, которая выполняется, если не

выполняется нулевая гипотеза H 0 . Тогда в терминах правильности или

ошибочности принятия H 0 и H 1 можно указать четыре потенциально

возможных результата применения критерия к выборке, как следующие

Принята гипотеза

H0

H0

H1

1 P( H 0 | H 0 ) -

P ( H1 | H 0 )

вероятность

Верна

гипотеза

правильно

- вероятность ошибочно

принять H 0 , когда верна принять H 1 , когда верна

H0

H 0 (ошибка 1-го рода,

уровень значимости)

98

H1

P ( H 0 | H1 )

-

вероятность

1 P ( H1 | H1 )

- вероятность правильно

ошибочно принять H 0 , принять H 1 , когда верна

когда верна H 1 (ошибка H 1 (мощность критерия)

2-го рода)

Как мы видим, мощность критерия - это вероятность принятия при

применении данного критерия альтернативной гипотезы H 1 при условии,

что она верна. Очевидно, что при фиксированной ошибке 1-го рода (ее мы

задаем сами, и она не зависит от свойств критерия) критерий будет тем

лучше, чем больше его мощность (т.е. чем меньше ошибка 2-го рода).

Проиллюстрируем основные понятия рассмотренной методологии на

простом примере проверки гипотезы о равенстве математического ожидания

нормально распределенной случайной величины с известной дисперсией

заданному числу (с точки зрения практического применения этот пример

несколько искусственен, поскольку дисперсия наблюдаемой случайной

величины обычно неизвестна).

2.3.2. Проверка гипотез о математических ожиданиях

2.3.2.1 Проверка гипотезы о равенстве заданному числу

математического ожидания нормально распределенной случайной

величины с известной дисперсией

Итак, пусть

выборка

~N ( , 2 ) , H 0 : 0 и H1 : 1 , и пусть имеется

x1 , x2 , ..., xn значений случайной величины

объема

n.

99

Предположим, что H 0 верна и мы выбераем в качестве статистики критерия

стандартизованное выборочное среднее

u

При

верной

H0

статистика

x 0

/ n

имеет

u

стандартное

нормальное

распределение, u ~ N (0, 1) , представленное на рис. 2.4. На этом рисунке

также указана критическая область уровня

бесконечных полуинтервалов

0,05 , состоящая из двух

(, 1,96] и [1,96, ) , вероятность

попадания в каждый из которых статистики u равна / 2 0,025 .

0.4

H0

0.3

0.2

Критическая область

0.1

Некритическая область

(Н0 не отв ергается)

(Н0 отв ергается)

Критическая область

(Н0 отв ергается)

0.025

0.025

0.0

-4

-3

-2

-1

0

1

2

3

4

Рис. 2.4. Пример критической области.

Имеются формализованные подходы к выбору статистик критериев и

построению критических областей, приводящие к наиболее мощным

критериям, но мы их здесь не рассматриваем. Неформальное же правило

состоит в том, чтобы

выбирать в качестве статистики

величину,

характеризующую степень отклонения от нулевой гипотезы. Очевидно,

разность x 0 удовлетворяет этому условию, а деление на константу

/ n , сохраняя это качество, приводит к величине u с полностью

100

заданным распределением, что позволяет выбрать критическую область с

требуемым уровнем значимости. Неформальное же правило выбора

критической области состоит в том, чтобы она включала значения

статистики, соответствующие наибольшим отклонениям от нулевой гипотезы

- на рис. 2.4 эта рекомендация соблюдена.

До сих пор мы говорили о свойствах критерия в предположении, что верна

гипотеза H 0 . А что происходит, когда верна альтернативная гипотеза H 1 ? В

этом случае распределение статистики критерия u изменится. Чтобы его

найти, произведем преобразование

u

x 0 x 0 1 1 x 1 1 0

,

/ n

/ n

/ n / n

из которого следует, что при гипотезе H 1 распределение статистики u

0

отличается от стандартного нормального сдвигом на величину 1

,

/ n

т.е. u ~ N (, 1) при выполнении H 1 .

На рис. 2.5 взаимное расположение плотностей распределения статистики

u

при

гипотезах

H0

и

H1

показано

для

случая

0 0, 1 2, 2 1, 0,05 и n 1 . Вероятности ошибки 2-го рода

соответствует площадь под кривой функции плотности при H 1 на

промежутке от –1,96 до 1,96, где не отвергается гипотеза H 0 , а

следовательно, ошибочно не принимается гипотеза H 1 . В данном случае

ошибка 2-го рода, 0.48 , довольно велика. Это произошло, главным

образом, потому, что мал объем выборки - имеется всего одно наблюдение,

n 1 . При увеличении n распределение, соответствующее альтернативной

0

гипотезе H 1 , будет сдвигаться вправо, поскольку величина 1

/ n

будет увеличиваться, что приведет, как легко понять по рис. 2.5, к

101

уменьшению ошибки

. Очевидно также, что большей величине разности

1 0 соответствует большая величина , и следовательно, меньшая

ошибка 2-го рода. Ошибка 2-го рода уменьшается также при уменьшении

дисперсии

2

наблюдаемой случайной величины. Кроме того,

уменьшается при увеличении , однако не принято брать больше 0,05.

При уменьшении ошибка

, напротив, растет, поэтому не следует брать

слишком малым, если число наблюдений n мало, разность между 1 и 0

невелика, а дисперсия

2

- большая.

0.4

H0

H1

0.3

0.2

0.48

0.1

0.025

0.025

0.0

-4

-3

-2

-1

0

1

2

3

4

5

6

Рис. 2.5. Взаимосвязь между ошибками 1-го и 2-го рода при двусторонней

альтернативе.

Содержательно, ошибка 1-го рода - это ошибка ложного обнаружения

несуществующего отклонения от нулевой гипотезы (ложного обнаружения

несуществующего эффекта). Ошибка же 2-го рода - это ошибка ложного

необнаружения существующего отклонения от нулевой гипотезы (ложного

необнаружения существующего эффекта). Мощность критерия - это его

способность обнаружить имеющееся отклонение от нулевой гипотезы.

102

В приведенном примере мы предполагали, что альтернативной гипотезе

H 1 соответствует вполне определенное распределение ~ N (2, 1) , что

позволило нам найти конкретное значение ошибки 2-го рода. Такого рода

альтернативные гипотезы называются простыми альтернативами. Однако

на практике чаще встречается ситуация, когда конкретной нулевой гипотезе

противопоставляется целый спектр альтернатив. Например, H1 : M 0

или H1 : M 0 . Такого рода альтернативные гипотезы называются

сложными альтернативами. В случае сложной альтернативной гипотезы мы

не можем определить величину ошибки второго рода. Например, в

рассматриваемой ситуации она может быть значительной даже при очень

большом числе наблюдений, если различие между

1 и 0 мало. Поэтому в

ситуации, когда статистика критерия не попадает в критическую область, не

утверждают

категорично,

что

«нулевая

гипотеза

принимается»,

а

формулируют вывод более осторожно: «нулевая гипотеза не отвергается».

Тем самым подчеркивается, что хотя мы и не обнаружили отклонения от

нулевой гипотезы, мы могли его при верной H 1 ошибочно не обнаружить с

вероятностью

, которую мы не знаем и которая, возможно, довольно

значительна. Если же ошибка

действительно велика, то утверждение

«нулевая гипотеза принимается» не представляет большой ценности.

Например, положив равной нулю ошибку 1-го рода, мы, независимо от

результатов наблюдений, всегда будем принимать гипотезу H 0 , поскольку

критическая область будет включать всю область определения статистики

критерия. Однако при этом ошибка 2-го рода будет равна единице, т.е. если

даже отклонение от нулевой гипотезы имеется, то мы его с вероятностью

единица не обнаружим.

Сложные альтернативы могут быть двусторонними ( H1 : M 0 ) и

односторонними ( H1 : M 0

или

H1 : M 0 ). Если имеется

103

достоверная информация о направлении отклонения от нулевой гипотезы, то

использование

односторонней

альтернативы

предпочтительнее

двусторонней, поскольку это повышает мощность критерия. Если, например,

известно, что отклонение математического ожидания от гипотетического

значения 0 может произойти только в большую сторону, то в качестве

альтернативы следует взять гипотезу H1 : M 0 . Критическая область

уровня

в этом случае будет состоять не из двух бесконечных

полуинтервалов ( , u / 2 ] и [u1 / 2 , ) , а из одного - [u1 , ) .

0.4

H0

H1

0.3

0.2

0.36

0.1

0.05

0.0

-4

-3

-2

-1

0

1

2

3

4

5

6

Рис. 2.6. Взаимосвязь между ошибками 1-го и 2-го рода при

односторонней альтернативе.

На рис. 2.6 ситуация с односторонней альтернативой представлена для

случая

0 0, 1 2, 2 1, 0,05 и n 1 . Вероятности ошибки 2-

го рода

соответствует площадь под кривой плотности статистики

критерия g при условии, что верна гипотеза H 1 , на промежутке от до

1,64, равная 0,36 , что меньше величины 0.48 для аналогичной

двусторонней альтернативы, представленной на рис. 2.5.

104

Пример. Известно, что датчик генерирует случайные числа, нормально

распределенные с дисперсией 1, но есть сомнения в том, что математическое

ожидание

равно

0.

Требуется

проверить

гипотезу

о

равенстве

математического ожидания нулю при двусторонней альтернативе по

следующей случайной выборке объема n 25 :

0,830 0,177 -0,294 0,471 -0,044 0,635 2,209 -0,394 -0,404

1,257 1,137 -0,839 1,668 0,751 0,416 -0,922 1,473 -0,317

0,220 0,414 0,428 1,088 -1,130 -0,015 0,142

Выборочное среднее равно x 0.358 , следовательно, для статистики

критерия получаем

x 0 0.358 0

1.79

/ n

1 / 25

Значение 1,79 не выходит за двусторонние 5%-ные критические пределы

u

u0,975 1,96 , поэтому гипотеза не отвергается.

На самом деле математическое ожидание датчика было равным 0,25, т.е.

отклонение ошибочно не было обнаружено - при проверке гипотезы была

сделана ошибка 2-го рода. Очевидно, мощность критерия при данном числе

наблюдений n 25 , данной разности между гипотетическим и истинным

математическими ожиданиями 1 0 0,25 и данной дисперсии

2

1

недостаточна. (В другом эксперименте с этим же датчиком была получена

выборка значений объема n 100 . Выборочное среднее оказалось равным

x 0,218 , а выборочное значение статистики – равным 2,18 , что дало

основание отвергнуть нулевую гипотезу.)

Примечание. В современных пакетах статистических программ кроме

вычисленного значения статистики критерия uнабл (в данном случае

uнабл 1,79 ) выдается также так называемое p-значение (англ.: p-value, или,

105

просто, p), равное в случае двусторонней альтернативы вероятности выхода

за пределы uнабл

p P( u uнабл )

(в случае односторонних альтернатив определение p-значения изменяется

очевидным

образом).

Вместо

сравнения

uнабл 1,79

с

границами

критической области u0,975 1,96 проще сравнить соответствующее pзначение, равное p 0,073 , с уровнем значимости

p

означает, что

0,05 . Неравенство

uнабл не попало в критическую область и,

следовательно, H 0 не должна быть отвергнута, и, наоборот, если p , то

H 0 должна быть отвергнута. В рассмотренном примере 0,073 0,05 ,

следовательно, H 0 не должна быть отвергнута.

2.3.2.2 Проверка гипотезы о равенстве заданному числу

математического ожидания нормально распределенной случайной

величины с неизвестной дисперсией (одновыборочный t-критерий)

Аналогично

неизвестного

случаю

построения

математического

доверительного

ожидания

нормально

интервала

для

распределенной

случайной величины, в случае неизвестной дисперсии мы возьмем в качестве

статистики критерия проверки гипотезы о равенстве математического

ожидания заданному числу ту же статистику, что и в случае с известной

дисперсией, но с заменой неизвестного среднеквадратичного отклонения

на его выборочную оценку s

t

x 0

s/ n

При верной H 0 статистика t имеет t -распределение с n 1 степенями

свободы. Соответственно, критическая область для проверки гипотезы

106

H 0 : 0

против двусторонней альтернативы

состоять

двух

из

бесконечных

полуинтервалов

H1 : 0 будет

(, tn 1, / 2 ]

и

[tn 1,1 / 2 , ) , против односторонней альтернативы H1 : 0 - из

одного полуинтервала [tn 1,1 , ) и против односторонней альтернативы

H1 : 0

-

также

t / 2 , t1 / 2 , t1 , t

степенями

свободы

из

одного

полуинтервала

обозначают квантили

соответствующего

( , tn 1, ] , где

t -распределения с n 1

уровня

значимости

(в

силу

симметричности t -распределения справедливы равенства t / 2 - t1 / 2 и

t - t1 ).

Пример. Рассмотрим пример предыдущего параграфа с 25 случайными

числами в предположении, что дисперсия неизвестна. В этом случае

необходимо вычислить оценку среднеквадратичного отклонения, которая

оказывается равной s 0,830 . Выборочное значение статистики критерия,

соответственно, равно

u

x 0

/ n

0,358 0

2,15

0,830 / 25

Это значение должно быть сравнено с 5%-ными двусторонними

критическими пределами, равными t24;0,025 2,06 . Выборочное значение

статистики выходит за эти пределы, следовательно, гипотеза о равенстве

математического ожидания нулю должна быть отвергнута на уровне

значимости 5%.

Заметим, что хотя применение t -критерия требует нормальности исходной

случайной величины, он может применяться и при умеренных отклонениях

от нормальности и не слишком малых n (n 15) .

107

2.3.2.3 Проверка гипотезы о равенстве математических ожиданий двух

нормально распределенных случайных величин (двухвыборочный tкритерий)

1. Независимые выборки. Предположим, что имеются случайные

выборки

x1 , x2 , ..., xn и

нормально

y1 , y2 , ..., ym значений двух независимых

распределенных

случайных

величин

~ N ( M , D ) и

~ N ( M, D ) и требуется проверить гипотезу H 0 : M M о

равенстве математических ожиданий этих случайных величин.

(а) Если известно, что дисперсии случайных величин и равны,

D D 2 (значение 2 неизвестно), то можно получить следующую

объединенную несмещенную оценку для

2

n

m

i 1

j 1

( xi x )2 ( y j y )2

s2

nm2

В этом случае s2/n и s2/m будут несмещенными оценками для дисперсии

выборочных средних x и y , а сумма s2/n+s2/m - несмещенной оценкой для

дисперсии разности средних x y . Соответственно, статистика

t

xy

s2

n

s2

m

как можно показать, будет иметь t-распределение с n+m-2 степенями

свободы.

Критическая

область

уровня

для

проверки

гипотезы

H 0 : M M против двусторонней альтернативы H1 : M M будет

состоять из

двух

бесконечных

полуинтервалов

(, tn m 2, / 2 ] и

[tn m2,1 / 2 , ) , против односторонней альтернативы H1 : M M - из

полуинтервала [tn m 2,1 , ) и против альтернативы H1 : M M - из

108

полуинтервала ( , tn m 2, ] , где t n m 2, / 2 , t n m 2,1 / 2 , t n m 2,1 ,

t n m 2, обозначают соответствующие квантили

t -распределения с

n m 2 степенями свободы.

(б) Если нет оснований считать, что дисперсии случайных величин и

равны, то для каждой из дисперсий D и D вычисляется своя оценка

n

( xi x )

s x2 i 1

m

( y j y)2

2

s 2y

и

n 1

j 1

m 1

и соответственно модифицируется статистика критерия

xy

t

s 2x

n

s 2y

m

которая, как можно показать, имеет t -распределение с числом степеней

свободы, равным целой части от 1/ k , где k выражается следующей

формулой

2

s x2 / n

s x2 / n

1

2

2

2

2

sx / n s y / m sx / n s y / m

k

n 1

2

m 1

2. Связанные выборки. Пусть теперь x1 , x2 , ..., xn и y1 , y2 , ..., ym связанные

случайные

выборки

из

нормальных

распределений

~ N ( M , D ) и ~ N ( M, D ) . Например, xi и yi - результаты

измерения давления до и после приема лекарства, соответственно, или длина

и

ширина

цветка

H 0 : M M

ириса

при

Iris

versicolor.

двусторонней

Для

проверки

альтернативе

гипотезы

H 1 : M M

используется статистика

109

(x y) n

1 n

, где sxy

t

( xi x )( yi y ) .

2

2

n

1

i 1

sx s y 2sxy

При условии, что верна гипотеза H0, статистика критерия имеет tраспределение с n-1 степенями свободы. Критическая область уровня α

состоит из двух интервалов (, -tn1,1 / 2 ) и (tn1,1 / 2 , ) , где tn1,1 / 2 квантиль t-распределения порядка 1 / 2 с числом степени свободы n-1.

Так построенный критерий называется парным t-критерием или t-критерием

для связанных выборок.

Заметим, что t-критерий для связанных выборок

x1 , x2 , ..., xn и

y1 , y2 , ..., ym совпадает с одновыборочным t-критерием для выборки

z1 , z2 , ..., zn , где zi xi yi , i 1,..., n , для проверки нулевой гипотезы

H 0 : Mz 0 против двусторонней альтернативы H1 : Mz 0 .

2.3.3 Проверка гипотез о дисперсиях

2.3.3.1 Проверка гипотезы о равенстве заданному числу дисперсии

нормально распределенной случайной величины (одновыборочный 2критерий)

Для проверки гипотезы H 0 :

2 02

о равенстве дисперсии

нормально распределенной случайной величины

2

заданному числу 02

рекомендуется использовать статистику

(n 1)

2

s2

02

Можно показать, что эта статистика, при условии, что верна гипотеза H 0 ,

распределена по закону 2 с n 1 степенями свободы. Критическая область

110

уровня при двусторонней альтернативе H1 :

2 02 состоит из двух

промежутков: [0, n 1, / 2 ] и [ n-1,1 / 2 , ) , где

2

квантили порядка

2

2

2

n1, / 2 и n-1,1 / 2 -

/ 2 и 1 / 2 распределения 2 с n 1 степенями

свободы. Для односторонней альтернативы H1 :

2 02

критическая

область имеет вид [ n-1,1 , ) , а для альтернативы H1 :

2

2 02 -

соответственно, [0, n-1, ] .

2

2.3.3.2 Проверка гипотезы о равенстве дисперсий двух независимых

нормально распределенных случайных величин (двухвыборочный Fкритерий)

Выше мы видели, что процедура проверки гипотезы о равенстве двух

математических ожиданий двух нормально распределенных случайных

величин упрощается, если их дисперсии одинаковы. Следующий критерий

позволяет проверить нулевую гипотезу

H 0 : D D

о равенстве

дисперсий двух нормально распределенных случайных величин. В качестве

статистики

критерия

используется

отношение

несмещенных

оценок

дисперсий этих случайных величин

F

s x2

s 2y

При условии, что верна гипотеза H 0 , можно доказать, что статистика

критерия имеет F -распределение с n 1 и m 1 степенями свободы.

Соответственно, критическая область уровня для проверки гипотезы

H 0 : D D

против двусторонней альтернативы H1 : D D будет

состоять из двух интервалов: (0, Fn 1,m 1, / 2 ] и [ Fn 1,m 1,1 / 2 , ) , где

Fn 1,m1, / 2 , Fn 1,m1,1 / 2 - квантили порядка / 2 и 1 / 2 F 111

распределения с n 1 и m 1 степенями свободы. Для односторонней

альтернативы

H1 : D D

критическая

область

[ Fn 1,m1,1 , ) , а для альтернативы H1 : D D

имеет

вид

- соответственно

[0, Fn 1,m 1, ] . Если в качестве статистики использовать отношение

большей оценки дисперсии к меньшей, то в качестве критической области

при двусторонней альтернативе следует использовать одностороннюю

критическая область

таблицами

[ Fn 1, m 1,1 , ) - это позволяет ограничиться

F -распределения,

содержащими

значения

функции

распределения только для аргументов больших единицы.

Заметим, что в отличие от t -критерия F -критерий чувствителен к

отклонениям

исходных

случайных

величин

от

нормальности.

При

значительных отклонениях от нормальности, особенно при небольшом числе

наблюдений, его не следует применять.

2.3.4 Сравнение параметров двух биномиальных распределений

Пусть

величины

две

независимые

биномиально

распределенные

случайные

и с параметрами n , p и m , p , соответственно, при

проведении независимых испытаний приняли значения k и l . Требуется

проверить гипотезу

H 0 : p p о равенстве параметров p и p . Для

этого можно использовать статистику

1

2( n m )

u

1 1

(1 )

n m

где

, и - выборочные частоты, вычисленные по первой, второй и

объединенной выборкам: k / n , l / m и

(k l ) /(n m) . Если

112

верна гипотеза H 0 , то для

, , не очень близких к 0 или 1, и при

достаточно больших n , m эта статистика имеет приближенно стандартное

нормальное распределение. Практически приближение применимо, если

каждая из четырех численностей k , l , n - k и m l больше пяти.

Критическая область уровня значимости

для проверки гипотезы

H 0 : p p против двусторонней альтернативы H1 : p p будет

состоять из двух бесконечных полуинтервалов ( , u / 2 ] и [u1 / 2 , ) ,

против

односторонней

полуинтервала

альтернативы

[u1 , )

и

H1 : p p

против

из

-

односторонней

одного

альтернативы

H1 : p p - также из одного полуинтервала ( , u ] , где u / 2 , u1 / 2 ,

u1 , и u обозначают квантили соответствующего порядка стандартного

нормального распределения.

Имеется также точный критерий Фишера для проверки этой гипотезы (см.,

напр., (Глотов, Животовский, Хованов, Хромов-Борисов,1982)).

2.3.5 Сравнение параметров двух пуассоновских распределений

Пусть

две

независимые

случайные

величины

пуассоновское распределение с параметрами

и

, имеющие

и , соответственно, при

проведении испытаний приняли значения k и l. Требуется проверить

гипотезу H 0 : о равенстве параметров и распределений этих

случайных величин. Для этого можно использовать статистику

u

k l

,

k l

распределение которой при выполнении H 0 и при k l 5 довольно точно

приближается стандартным нормальным распределением. Соответственно,

113

как и в предыдущем параграфе, критическая область уровня значимости

для проверки гипотезы H 0 : p p против двусторонней альтернативы

H1 : p p

( , u / 2 ]

будет

и

состоять из двух

[u1 / 2 , ) ,

против

бесконечных

односторонней

полуинтервалов

альтернативы

H1 : p p - из одного полуинтервала [u1 , ) и против односторонней

альтернативы H1 : p p - также из одного полуинтервала ( , u ] .

2.3.6 Проверка гипотезы о равенстве нулю коэффициента корреляции

Пусть ( x1 , y1 ), ( x2 , y2 ), ..., ( xn , yn ) - случайная выборка пар значений

двумерной случайной величины ( , ) , имеющей двумерное нормальное

распределение. Требуется проверить гипотезу H 0 : 0 о равенстве

коэффициента корреляции этого двумерного распределения заданному

числу 0 . Для проверки этой гипотезы можно использовать статистику

u

n 3 1 r

1 0

ln

,

ln

2 1- r

1 0

распределение которой при выполнении H 0 и при достаточно большом n

довольно точно приближается стандартным нормальным распределением.

Соответственно, как и в предыдущих двух параграфах, критическая область

уровня значимости

для проверки гипотезы

двусторонней

альтернативы

бесконечных

полуинтервалов

H1 : 0

( , u / 2 ]

H 0 : 0 против

будет

состоять

и

[u1 / 2 , ) ,

из

двух

против

односторонней альтернативы H 1 : 0 - из одного полуинтервала

[u1 , ) и против односторонней альтернативы H 1 : 0 - также из

одного полуинтервала ( , u ] .

114

Обычно проверяется гипотеза о равенстве коэффициента корреляции

нулю, что в случае двумерного нормального распределения, как ранее

отмечалось, эквивалентно проверке гипотезы о независимости

и . В этом

случае приведенное выше выражение для статистики критерия упрощается

u

n 3 1 r

ln

2 1-r

(2.5)

Пример. Пусть объем выборки n 10 , вычисленное по выборке значение

r 0,6 и требуется проверить гипотезу H 0 : 0 против альтернативы

H1 : 0 .

Выборочное значение статистики u , вычисленное по формуле (2.5), равно

1,83. Поскольку оно не выходит за двусторонние 5%-ные критические