Сравнительный анализ выборок

реклама

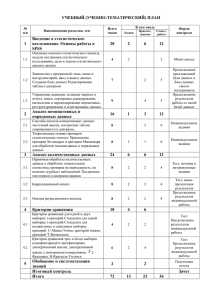

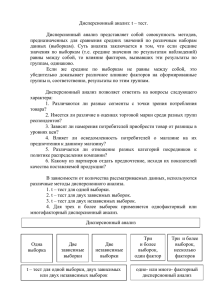

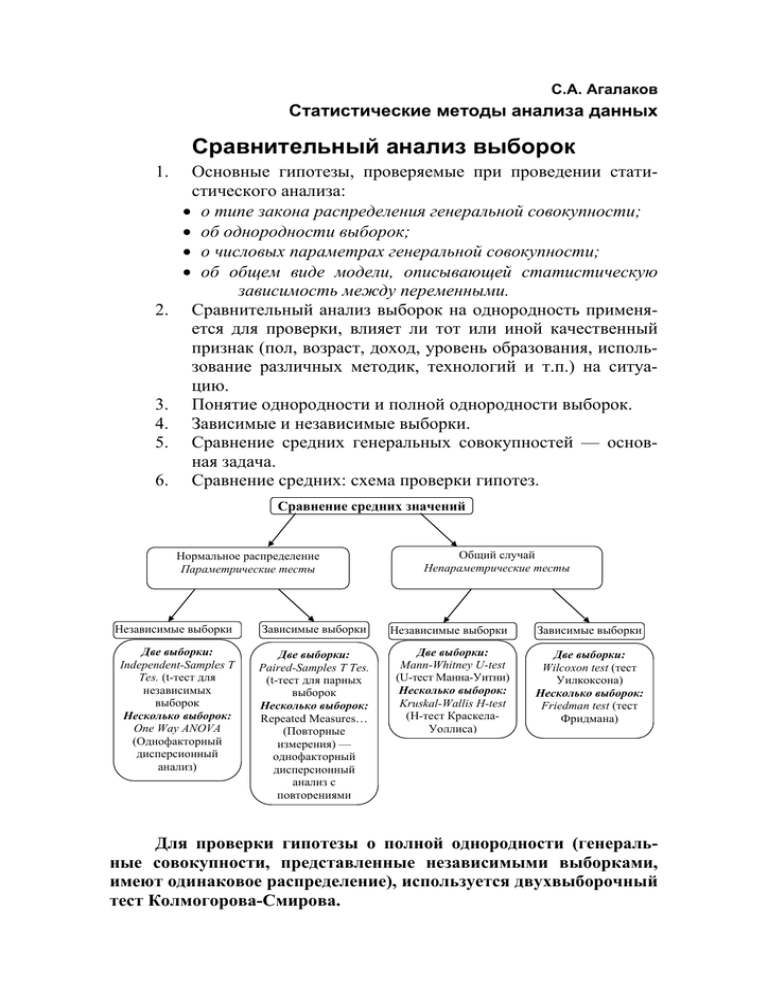

С.А. Агалаков Статистические методы анализа данных Сравнительный анализ выборок 1. 2. 3. 4. 5. 6. Основные гипотезы, проверяемые при проведении статистического анализа: • о типе закона распределения генеральной совокупности; • об однородности выборок; • о числовых параметрах генеральной совокупности; • об общем виде модели, описывающей статистическую зависимость между переменными. Сравнительный анализ выборок на однородность применяется для проверки, влияет ли тот или иной качественный признак (пол, возраст, доход, уровень образования, использование различных методик, технологий и т.п.) на ситуацию. Понятие однородности и полной однородности выборок. Зависимые и независимые выборки. Сравнение средних генеральных совокупностей — основная задача. Сравнение средних: схема проверки гипотез. Сравнение средних значений Нормальное распределение Параметрические тесты Общий случай Непараметрические тесты Независимые выборки Зависимые выборки Независимые выборки Зависимые выборки Две выборки: Independent-Samples T Tes. (t-тест для независимых выборок Несколько выборок: One Way ANOVA (Однофакторный дисперсионный анализ) Две выборки: Paired-Samples T Tes. (t-тест для парных выборок Несколько выборок: Repeated Measures… (Повторные измерения) — однофакторный дисперсионный анализ с повторениями Две выборки: Mann-Whitney U-test (U-тест Манна-Уитни) Несколько выборок: Kruskal-Wallis H-test (H-тест КраскелаУоллиса) Две выборки: Wilcoxon test (тест Уилкоксона) Несколько выборок: Friedman test (тест Фридмана) Для проверки гипотезы о полной однородности (генеральные совокупности, представленные независимыми выборками, имеют одинаковое распределение), используется двухвыборочный тест Колмогорова-Смирова. Параметрические тесты Параметрические методы предполагают нормальность распределения анализируемых переменных или остатков в моделях дисперсионного анализа, сравнения групп и т.д. Это условие при анализе анкетной информации выполняется весьма редко. Вероятно, наиболее удобны для такого анализа переменные, полученные усреднением множества независимых случайных величин: по центральной предельной теореме такие переменные должны иметь распределение, близкое к нормальному. На практике нередко для больших совокупностей эти методы все же используются и для другого рода распределений, если распределение "не слишком сильно" отклоняется от нормального. "Не слишком сильно" — неопределенное понятие, обычно это определяется визуально при рассмотрении гистограммы распределения. Сравнительный анализ выборок с помощью параметрических тестов основан на использовании выборочного среднего. Далее приводится описание тестов для независимых выборок. Тесты для зависимых выборок являются модификациями соответствующих тестов для независимых выборок. Сравнение средних двух генеральных совокупностей 1. Предполагается нормальность распределения генеральных совокупностей. 2. Основная гипотеза: средние (математические ожидания) генеральных совокупностей равны. 3. Проверка гипотезы о равенстве средних в случае двух генеральных совокупностей начинается с применения теста Левена (Levene). С помощью этого теста проверяется гипотеза о равенстве дисперсий двух генеральных совокупностей. Наблюдаемое значение вы1 2 sm 1 m − числяется по формуле: X набл = . Если верна основная гипотеза, 1 2 sn n −1 то эта случайная величина имеет распределение Фишера с со степенями свободы m − 1 и n − 1. Поэтому при уровне значимости α в качестве критического значения используется квантиль уровня 1 − α этого распределения. 3. Далее применяется тест, основанный на распределении Стьюдента. Он проверяет основную гипотезу о равенстве средних генеральных совокупностей. В зависимости от предположения о равенстве дисперсий используются разные варианты t-статистик. Если гипотеза о равенстве дисперсий отвергается по тесту Левена, то наблюдаемое значение вычисляется по формуле: 2 X набл = x−y . Эта величина имеет распределение Стьюдента, 1 2 1 2 sm + sn т n число степеней которого оценивается на основе оценок дисперсий. Поэтому при уровне значимости α в качестве критического значения используется квантиль уровня 1 − α этого распределения. Если гипотеза о равенстве дисперсий не отвергается по тесту Левена, то наблюдаемое значение вычисляется по формуле: x−y msm2 + nsn2 . Эта величина имеет распределеX набл = , где s = m+n−2 1 1 s + т n ние Стьюдента с m + n − 2 степенями свободы. Поэтому при уровне значимости α в качестве критического значения используется квантиль уровня 1 − α этого распределения. Чтобы применить t-критерий для независимых выборок, требуется, по крайней мере, одна независимая (группирующая) переменная и одна зависимая переменная (содержащая обе выборки). Вначале с помощью значений группирующей переменной данные разбиваются на две группы. Далее в каждой группе вычисляется среднее значение зависимой переменной, например, артериальное давление или доход. Эти выборочные средние сравниваются между собой. 4. В случае зависимых (парных) выборок применяется модификация описанного выше теста. Т-критерий для зависимых выборок дает преимущество в том случае, когда важный источник внутригрупповой вариации (или ошибки) может быть легко определен и исключен из анализа. В частности, это относится к экспериментам, в которых две сравниваемые группы наблюдений основываются на одной и той же выборке наблюдений (субъектов), которые тестировались дважды. 5. Выводы по тестам и полная однородность генеральных совокупностей. Сравнение средних нескольких генеральных совокупностей Сравнение средних трех и более генеральных совокупностей проводится с помощью одномерного дисперсионного анализа (английское сокращение — ANOVA от Analysis Of Variances). В его основе лежит использование статистики, имеющей распределение Фишера. Дисперсионный анализ (от латинского Dispersio – рассеивание) – статистический метод, позволяющий анализировать влияние различных факторов на исследуемую переменную. Метод был разработан биологом Р. Фишером в 1925 году и применялся первоначально для 3 оценки экспериментов в растениеводстве. В дальнейшем выяснилась общенаучная значимость дисперсионного анализа для экспериментов в психологии, педагогике, медицине и др. Целью дисперсионного анализа является проверка значимости различия между средними с помощью сравнения дисперсий. Дисперсию измеряемого признака разлагают на независимые слагаемые, каждое из которых характеризует влияние того или иного фактора или их взаимодействия. Последующее сравнение таких слагаемых позволяет оценить значимость каждого изучаемого фактора, а также их комбинации. 1. Предполагается нормальность распределения генеральных совокупностей. 2. Основная гипотеза: средние (математические ожидания) генеральных совокупностей равны. 3. Теорема о сумме квадратов. Предположим, что имеется p уровней качественного признака (фактора), влияние которого мы оцениваем. Матрица исходных данных в этом случае имеет вид: x11 x12 … x1 p … x21 x22 x2 p … xq11 xq2 2 … xq p p . q p j 1 Пусть x = ∑∑ xij — среднее выборочное объедиq1 + q2 + … q p j =1 i =1 q 1 j ненной выборки, x j = ∑ xij — групповые средние по каждому q j i =1 столбцу. Вычислим сумму квадратов отклонений элементов объединенной выборки от общего среднего, двигаясь по столбцам. Для столбца с номером j имеем: (x ij − x ) = ( xij − x j + x j − x ) = ( xij − x j ) + ( x j − x ) + 2 ( xij − x j )( x j − x ) , 2 2 qj ∑( x i =1 ij 2 qj qj 2 qj − x ) = ∑ ( xij − x j ) + ∑ ( x j − x ) + 2∑ ( xij − x j )( x j − x ) . 2 2 i =1 2 i =1 i =1 Вычислим две последние суммы: qj ∑( x i =1 − x ) = qj ( xj − x ) , 2 j 2 ⎛ qj ⎞ 2∑ ( xi1 − x1 ) ( x1 − x ) = 2 ( x1 − x ) ∑ ( xij − x j ) = 2 ( x j − x ) ⎜ ∑ xij − q j x j ⎟ = 0 . i =1 i =1 ⎝ i =1 ⎠ qj qj 4 qj ∑( x Таким образом, ij i =1 qj − x ) = ∑ ( xij − x j ) + q j ( x j − x ) . 2 2 2 i =1 Складывая полученные равенства по всем j = 1,2,… p , имеем: p qj ∑∑ ( x j =1 i =1 ij p p qj − x ) = ∑ q j ( x j − x ) + ∑∑ ( xij − x j ) . 2 2 j =1 2 j =1 i =1 Введем обозначения и названия: p qj TSS = ∑∑ ( xij − x ) — полная сумма квадратов, 2 j =1 i =1 p FSS = ∑ q j ( x j − x ) — факторная сумма квадратов, 2 j =1 p qj ESS = ∑∑ ( xij − x j ) — сумма квадратов ошибок (остатков). 2 j =1 i =1 Полученное равенство в наших обозначениях выглядит следующим образом: TSS = FSS + ESS . Это равенство выражает сущность теоремы о сумме квадратов. 4. О содержательном смысле теоремы. 5. О названии метода. 6. Проверка основной гипотезы. В случае, когда дисперсии генеральных совокупностей одинаковы, в качестве наблюдаемого зна1 FSS p −1 чения используется статистика X набл = . 1 ESS q1 + q2 + … q p − p Если верна основная гипотеза то эта статистика имеет распределение Фишера с со степенями свободы p − 1 и q1 + q2 + … q p − p . Поэтому при уровне значимости α в качестве критического значения используется квантиль уровня 1 − α этого распределения. В случае, когда дисперсии генеральных совокупностей не все одинаковы, в качестве наблюдаемого значения используется модификация приведенной статистики. 7. В пакете SPSS для проверки гипотезы об однородности дисперсий используется тест Левена для нескольких выборок. 8. В пакете SPSS имеется несколько вариантов реализации дисперсионного анализа. Чаще всего применяется тест Дункана (Duncan). При значимом результате дисперсионного анализа этот тест показывает, какие именно совокупности значимо отличаются друг от друга. По умолчанию установлен уровень значимости 0,05; можно выбрать и другое значение. 5 9. Следует обратить внимание на контрасты. Контрастом называется линейная комбинация средних в группах k ∑a x , i =1 k ∑a i =1 i i i где = 0 . С помощью контрастов можно проверять гипотезы об опре- деленных соотношениях между математическими ожиданиями генеральных совокупностей. 10. Если имеется более двух «зависимых выборок», то можно использовать дисперсионный анализ с повторными измерениями. Повторные измерения в дисперсионном анализе можно рассматривать как обобщение F-критерия для зависимых выборок, позволяющее увеличить чувствительность анализа. 11. Выводы по тестам и полная однородность генеральных совокупностей. 12. Многофакторный дисперсионный анализ. При определении влияния на зависимую переменную нескольких факторов можно использовать многофакторный дисперсионный анализ. Главное преимущество этого метода в том, что он позволяет исследователю изучать взаимодействие факторов. Взаимодействия (interaction) имеют место, когда эффекты одного фактора на зависимую переменную зависят от уровня других факторов. Общая схема двухфакторного эксперимента, данные которого обрабатываются дисперсионным анализом имеет вид: Взаимодействие факторов A и B Фактор А Зависимая переменная Фактор B Прочие неучитываемые (случайные) факторы 13. Многомерный дисперсионный анализ (MANOVA — Multivariate analysis of variance) — аналогичен дисперсионному анализу (ANOVA), за исключением того, что вместо одной метрической зависимой переменной имеется две или больше переменных. В отличие от ANOVA, который проверяет групповые различия в отношении единственной зависимой переменной, MANOVA одновременно проверяет групповые различия в отношении нескольких зависимых переменных. При ANOVA нулевую гипотезу формулируют следующим образом: средние зависимой переменной равны во всех группах. Многомерный 6 дисперсионный анализ лучше использовать, если имеется две или больше зависимых переменных, которые коррелируют. Если же имеется много зависимых переменных, которые не коррелируют или являются ортогональными, то лучше для каждой зависимой переменной выполнить ANOVA, а не MANOVA. 7 Непараметрические тесты Непараметрические тесты предназначены преимущественно для проверки статистических гипотез методами, не связанными с видом распределения совокупности. В частности, применение этих методов не требует предположения о нормальности распределения, которое необходимо для правомерного использования одномерного дисперсионного анализа, t-теста, при определении значимости корреляций и т.д. Сравнительный анализ выборок с помощью непараметрических тестов основан на использовании среднего ранга. Статистика Уилкоксона Пусть имеются две независимые выборки x1 , x2 ,…, xm и y1 , y2 ,…, yn , причем m ≥ n . Объединим их в одну выборку и вычислим ранги каждого элемента. В 1965 году Уилкоксон (Wilcoxon) ввел в рассмотрение статистику W — сумму рангов элементов меньшей (второй) выборки. Что показывает данная статистика? Если выполняется гипотеза о том, что FX ( x) < FY ( x) при всех x , т.е. P ( xi < x ) < P ( y j < x ) , то элементы второй выборки имеют тенденцию располагаться левее элементов первой выборки. Значит, в этом случае статистика W склонна к меньшим значением, нежели в случае, когда FX ≡ FY . На этом и основано сипользование статистики Уилкоксона для проверки гипотезы о том, что FX ≡ FY . U-тест Манна-Уитни Критерий Манна—Уитни представляет непараметрическую альтернативу t-критерию для независимых выборок. Опция предполагает, что данные расположены таким же образом, что в и t-критерии для независимых выборок. В частности, файл должен содержать группирующую переменную, имеющую, по крайней мере, два разных кода для однозначной идентификации принадлежности каждого наблюдения к определенной группе. При использовании теста две выборки объединяют и наблюдения ранжируют в порядке возрастания. Статистикой критерия, по сути, является сумма рангов объектов в меньшей группе (статистика Уилкоксона), хотя существует пара эквивалентных формул, обозначаемых U и W. Можно также считать, что критерием является средний ранг в указанной группе. Если он значительно отклоняется от ожидаемой величины (или средние ранги в группах существенно различны) — обнаруживается отличие распределений. Но из незначимости критерия вовсе не следует, что распределения совпадают. 8 Авторам теста удалось показать асимптотическую нормальность статистики в условиях выборки групп из одной совокупности, на основе чего отыскивается наблюдаемая значимость критерия — вероятность случайно отклониться от среднего (ожидаемого) значения ранга больше, чем отклонилось выборочное значение статистики. В распечатке пакета SPSS приводятся значения статистик U и W, а также двусторонняя значимость критерия. H-тест Краскела-Уоллиса Данный тест является непараметрической альтернативой однофакторного дисперсионного анализа. В основе проверки лежит одномерный дисперсионный анализ, в котором вместо значений переменных используется ранг объекта по исследуемой переменной, производится сравнение средних произвольного числа групп. Нормированный межгрупповой разброс в условиях гипотезы равенства средних рангов в группах имеет распределение, близкое к распределению хи-квадрат. В распечатке пакета SPSS приводится значимость этой статистики. Тест Уилкоксона Для исследования связи пары измерений Х и Y, представленных зависимыми выборками, ранжируются абсолютные величины разностей di=Yi-Xi. Затем рассматривается сумма рангов положительных и сумма рангов отрицательных разностей. Если связь между X и Y отсутствует и распределение одинаково, то эти две суммы должны быть примерно равны. Статистика критерия - стандартизованная разность этих сумм. По сути, это проверка, не произошло ли между измерениями событие, существенно изменившее иерархию объектов? Тест Фридмана Тест Фридмана применяется для проверки гипотезы о совпадении средних значений нескольких генеральных совокупностей, представленных зависимыми выборками (k объектов). Для этого на каждом исследуемом объекте независимо производится их ранжировка (по строке матрицы данных), затем вычисляется средний ранг по каждой переменной (по столбцу). Если все измерения независимы и равноценны (одинаково распределены) то все эти средние должны быть приближенно равны (k+1)/2 — среднему рангу в строке. Статистикой критерия является нормированная сумма квадратов отклонений средних рангов по переменным от общего среднего (k+1)/2, которая имеет теоретическое распределение хи-квадрат. 9 Проверка полной однородности Двухвыборочный тест Колмогорова-Смирнова Двухвыборочный тест Колмогорова-Смирнова предназначен для проверки гипотезы о совпадении распределений в паре независимых выборок. Статистика критерия — абсолютная величина разности эмпирических функций распределения в указанных выборках: N1 + N 2 max F1 ( x) − F2 ( x) , где N1 и N2 - объемы выборок. ks = x N1 N 2 10 Сравнительный анализ в пакете SPSS 1. Проверка гипотезы о нормальном распределении. 2. Выбор тестов для анализа. 11