Документ 134646

реклама

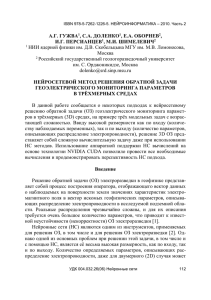

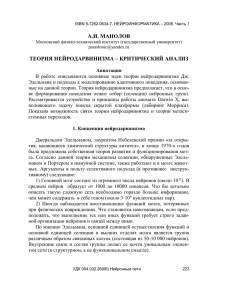

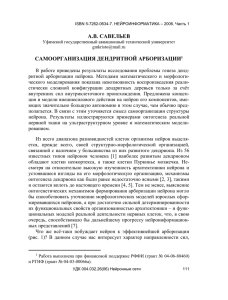

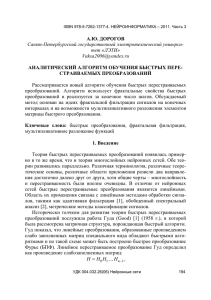

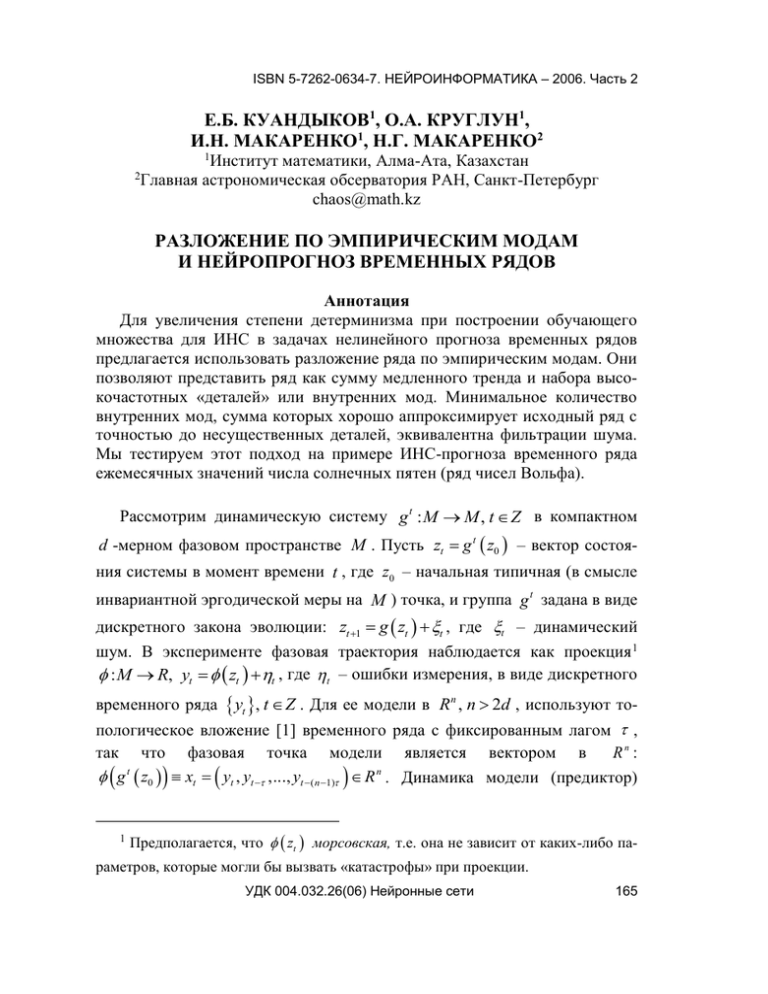

ISBN 5-7262-0634-7. НЕЙРОИНФОРМАТИКА – 2006. Часть 2 Е.Б. КУАНДЫКОВ1, О.А. КРУГЛУН1, И.Н. МАКАРЕНКО1, Н.Г. МАКАРЕНКО2 2 1 Институт математики, Алма-Ата, Казахстан Главная астрономическая обсерватория РАН, Санкт-Петербург chaos@math.kz РАЗЛОЖЕНИЕ ПО ЭМПИРИЧЕСКИМ МОДАМ И НЕЙРОПРОГНОЗ ВРЕМЕННЫХ РЯДОВ Аннотация Для увеличения степени детерминизма при построении обучающего множества для ИНС в задачах нелинейного прогноза временных рядов предлагается использовать разложение ряда по эмпирическим модам. Они позволяют представить ряд как сумму медленного тренда и набора высокочастотных «деталей» или внутренних мод. Минимальное количество внутренних мод, сумма которых хорошо аппроксимирует исходный ряд с точностью до несущественных деталей, эквивалентна фильтрации шума. Мы тестируем этот подход на примере ИНС-прогноза временного ряда ежемесячных значений числа солнечных пятен (ряд чисел Вольфа). Рассмотрим динамическую систему g t : M M , t Z в компактном d -мерном фазовом пространстве M . Пусть zt g t z0 – вектор состояния системы в момент времени t , где z0 – начальная типичная (в смысле инвариантной эргодической меры на M ) точка, и группа g t задана в виде дискретного закона эволюции: zt 1 g zt t , где t – динамический шум. В эксперименте фазовая траектория наблюдается как проекция 1 : M R, yt zt t , где t – ошибки измерения, в виде дискретного yt , t Z . Для ее модели в R n , n 2d , используют топологическое вложение [1] временного ряда с фиксированным лагом , Rn : так что фазовая точка модели является вектором в g t z0 xt yt , yt ,..., yt ( n 1) R n . Динамика модели (предиктор) временного ряда 1 Предполагается, что zt морсовская, т.е. она не зависит от каких-либо па- раметров, которые могли бы вызвать «катастрофы» при проекции. УДК 004.032.26(06) Нейронные сети 165 ISBN 5-7262-0634-7. НЕЙРОИНФОРМАТИКА – 2006. Часть 2 задается уравнением1 yt 1 f xt , t f xt t , где t – малая случайная величина, f : Rn R – непрерывная функция n переменных, известная лишь на конечном числе пар «обучающего» множества v , f v . При i i этих условиях, задача аппроксимации f , т.е. предсказания, не является корректной и решается лишь на уровне технической строгости [2]. Но даже на этом уровне возникают две проблемы. Первая из них – ошибка модели [3, 4], которая возникает из существования скрытых параметров, потому что процесс, гененерирующий наблюдательные данные, не описывается выбранным классом функций f . Для выбора оптимальной модели используются разные подходы [5], однако их аргументация основана лишь на petitio principii. Вторая проблема связана с шумами в данных. Использование цифровой фильтрации допустимо лишь в исключительных случаях, поскольку природа шума и его функциональная связь с сигналом обычно неизвестны [6]. Для реконструкции модели в этих случаях используются статистические (байесовы) подходы [7]. Существует и другой способ увеличения доли детерминизма в исходных данных. Он основан на представлении сложного сигнала с помощью линейной комбинации более простых компонент 2. Если способ разложения выбран удачно, можно попытаться использовать для прогноза сигнал, который синтезирован лишь из некоторых полученных компонент. Такой вариант часто реализуется в вейвлет анализе сигналов с помощью так называемого «банка фильтров» (filter bank) [8]. Существует множество способов получить такое разложение при разных предположениях о свойствах сигнала. Так, функцию f L2 можно представить в ортонормированном базисе g m mN , т.е. как f m0 f , gm gm , а затем аппроксимиро вать ее первыми M ортогональными проекциями f , gm m0,.. M , как это делается в методе Карунена-Лоэва. Такая аппроксимация оптимальна, если коэффициенты f , g m быстро разрушаются с ростом m , как это бу1 Точнее, предиктор задается векторным уравнением xt f xt t , в кото- ром нетривиальна лишь одна компонента yt f xt t [2]. В случае 1 мы получаем нелинейный одношаговый предиктор. 2 Вопрос о «реальности» таких компонент – это вопрос контекста, в котором они получены. УДК 004.032.26(06) Нейронные сети 166 ISBN 5-7262-0634-7. НЕЙРОИНФОРМАТИКА – 2006. Часть 2 дет, например, для однородной регулярной функции, представленной низкими частотами в базисе Фурье. Для нестационарных сигналов предпочтительнее использовать вейвлет-базис j ,n . В этом случае справедливо неравенство f , j , n A2 1 2 j , так что коэффициенты разложения быстро разрушаются в области больших значений показателей регулярности . Таким образом, можно использовать для прогноза «крупнозернистое» приближение f , пренебрегая высокочастотными «деталями», без нарушения глобальной структуры сигнала [8]. Основными трудностями на этом пути являются краевые эффекты и отсутствие адаптивности выбора универсального семейства базисных вейвлет-функций, пригодного для всех участков нестационарного ряда. В последнее время становится популярным метод разложения сигнала по эмпирическим модам [9, 10], который представляет его в виде совокупности функций, каждая из которых соответствует определенному режиму осцилляций в наблюдаемом сигнале. Эти функции внутренних мод (intrinsic mode function – IMF), вычисляются непосредственно из данных и, одновременно, составляют эмпирически ортогональный базис, по которому производится разложение так, что их полная сумма позволяет восстановить сигнал. Разложение обладает хорошими локальными свойствами и адаптивностью и основано на следующем представлении: сигнал=быстрая осцилляция+медленная осцилляция Авторская версия [11] emd опиралась на понятие комплексной огибающей аналитического «квазигармонического» представления сигнала: x t z t x t iu t A t exp i t , u t 1 x t d , где интеграл в преобразование Гильберта 1 берется в смысле главного зна t arctg u t x t чения; – мгновенная фаза и A t x 2 t u 2 t 12 1 u t . – огибающая сигнала. Преобразование Гильберта - лишь один из многих способов определения УДК 004.032.26(06) Нейронные сети 167 ISBN 5-7262-0634-7. НЕЙРОИНФОРМАТИКА – 2006. Часть 2 Рис. 1. Разложение сигнала по эмпирическим модам Алгоритм1 разложения включает несколько шагов (см. рис. 1): 1. идентифицировать все экстремумы emin , emax сигнала x t ; 2. провести огибающие emin t , emax t ; 3. вычислить среднее m t emin emax 2 ; 4. извлечь детали d t x t m t ; 5. применить шаги №1-4 к m t . Критерий остановки основан на максимальном «выпрямлении» m t . В результате сигнал выражается как сумма остаточного «тренда» mK t и суммы мод d k t , k 1,2....K : x t mK t k 1 dk , которые «локальK но ортогональны»: di di 1 0 . Мы использовали для экспериментов сглаженные ежемесячные числа Вольфа2 с 1749 года. Этот ряд, по-видимому, продуцируется низкоразмерной хаотической системой [12] солнечного динамо; его график демонстрирует «квазициклы» с продолжительностью 7-15 лет. Оказалось, что характерные особенности всех 23-х циклов, с точностью до максимальной амплитуды, можно представить двумя комбинациями внутренних мод: (3+4) и (3+5). На рис. 3 приведены эти аппроксимации. Сплошная линия представляет собой реальный ряд чисел Вольфа, кружками показана аппроксимация соответствующими модами. Возможная интерпретация этого результата – реальность модели 2-модового динамо [12]. 1 Программы для вычисления emd в среде MatLab доступны на web-странице http://perso.ens-lyon.fr/patrick.flandrin/emd.html. 2 База данных доступна на сайте http://sidc.oma.be/. УДК 004.032.26(06) Нейронные сети 168 ISBN 5-7262-0634-7. НЕЙРОИНФОРМАТИКА – 2006. Часть 2 Рис. 2. emd - разложение временного ряда чисел Вольфа Для прогноза 23-го текущего цикла была использована сумма внутренних мод с третьей по седьмую. Для экспериментов использовался пакет STATISTICA Neural Networks, Version 4.0. Таблица обучения составлялась согласно алгоритму Такенса [2] со следующими параметрами: размерность вложения 17, лаг 115. Результат обучения для циклов №14-22 вместе с прогнозом 23 цикла приведены на рис. 4. Прогноз цикла №23 вместе с реальными значениями приведен отдельно на рис. 5. Предсказание «сохранило» бимодальность цикла и ветвь спада. Поведение ошибки предсказания носит систематический характер и, следовательно, прогноз в принципе может быть улучшен с помощью второй сети, которая играет роль корректора. УДК 004.032.26(06) Нейронные сети 169 ISBN 5-7262-0634-7. НЕЙРОИНФОРМАТИКА – 2006. Часть 2 150 WN 3+4 3 100 21 22 18 23 2 50 WN 0 -50 -100 0 500 1000 1500 2000 X 150 2500 19 WN 3+5 100 8 11 9 50 5 1 WN 6 7 3000 10 12 13 14 15 20 16 0 -50 -100 0 500 1000 1500 2000 X 2500 3000 Рис. 3. Две комбинации внутренних мод: (3+4) – вверху и (3+5) – внизу 200 150 W 100 50 0 0 200 400 600 t 800 1000 1200 Рис. 4. Результат обучения эпигнозов для циклов №14-22, вместе с прогнозом 23 цикла УДК 004.032.26(06) Нейронные сети 170 ISBN 5-7262-0634-7. НЕЙРОИНФОРМАТИКА – 2006. Часть 2 140 120 100 80 W 60 test 40 20 0 0 10 20 30 40 50 60 t 70 80 90 100 110 120 130 Рис. 5. Прогноз 23 цикла. Сплошная линия – реальные значения ряда Вольфа, кружки – прогноз (с абсолютным отклонением). Внутренние моды 3-7, лаг 115, размерность 17 Полученные результаты показали: (а) рекуррентная последовательность солнечных циклов хорошо аппроксимируется композицией двух внутренних мод и (b) разложение по эмпирическим модам может быть использовано для получения нелинейного долгоcрочного прогноза временных рядов как эффективный способ уменьшения длины описания модели в рамках известного MDL принципа [13, 14]. Список литературы 1. Макаренко Н.Г. Реконструкция динамических систем по хаотическим временным рядам // Нелинейные Волны’2004. Нижний Новгород. 2005. С. 398-410. 2. Макаренко Н.Г. Эмбедология и нейропрогноз // Нейроинформатика-2003. Москва. Ч.1. С. 86-148. 3. McSharry P.E., Smith L.A. Consistent nonlinear prediction: identifying model error// Physica D. 2004. V.192. P. 1-22. 4. Smith L.A. The Maintenance of Uncertainty // Proc International School of Physics “Enrico Fermi”, Course CXXXIII, Bologna, Italy, 1997. P. 177-246. 5. Nakamura T., Kilminster D., Judd K. Mees A. A . A comparative study of model selection methods for nonlinear time series // Int.J. Bifurcation. and Chaos, 2004. V.14. P. 1129-1146. 6. Theiler, J., Eubank, S. Don't bleach chaotic data // Chaos, 1993. V.3. P. 335-341. 7. Лоскутов Е.М., Мольков Я.И., Мухин Д.Н., Фейгин А.М. Статистический подход к реконструкции динамических систем // Нелинейные Волны’2004. Нижний Новгород, 2005. С. 411-426. 8. Abry P., Flandrin P., Taqqu M., Veitch D. Wavelets for the analysis, estimamation, and synthesis of scaling data // 2000, http://perso.ens-lyon.fr/patrice.abry/ УДК 004.032.26(06) Нейронные сети 171 ISBN 5-7262-0634-7. НЕЙРОИНФОРМАТИКА – 2006. Часть 2 9. Flandrin P., Conçalves P., Rilling G. Empirical mode decomposition as filter bank// IEEE Sig. Proc. Lett., 2004. V. 11. No. 2. P. 112-114. 10. Rilling G., Flandrin P., Conçalves P. On empirical mode decomposition and its algorithms // http: // perso.ens-lyon.fr/patrick.flandrin/ publirecentes.html 11. Huang N.E., Shen Z. et al The empirical mode decomposition and Hilbert spectrum for nonlinear and non-stationary time series analysis// Proc. R. Soc. London. Ser.A. 1998, V. 454. P. 903. // http://www.fuentek.com/ technologies/hht.htm#papers_pubs 12. Беневоленская Е.Е. Структура и динамика магнитного Солнечного цикла: Автореф. дис. д-ра физ.-мат. наук. – С.-Петербург, 1999. – 34 с. 13. Hansen M.H., Yu B., Model selection and the principle of minimum description length // J. American Statistical Association, 2001. V. 96. P. 746-774. 14. Rissanen J. Modeling by shortest data description // Automatica, 1978. V. 14, P. 465-471. УДК 004.032.26(06) Нейронные сети 172